Trust Agent:AI 捕获 AI 使用信号并提交元数据(而不是源代码或提示),保护开发者的隐私,同时实现大规模治理。它使人工智能辅助开发可通过安全的 SDLC 进行审计和管理,在生产之前管理开发人员风险。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

Trust Agent: AIはコード作成の段階でAIサイバーセキュリティガバナンスを実現します。

人工智能编码助手、LLM API、CLI 代理和连接到 MCP 的工具现在每天都会影响生产代码。开发速度加快了——在整个软件生命周期中引入了新的治理复杂性。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

従来のアプリケーションセキュリティツールは、コード記述後に脆弱性を検出します。Trust Agentは、AIモデルの制限と安全なコーディングポリシーをコミット時に強制的に適用し、脆弱性が本番環境に到達する前に防御します。

捕获开发者工作流程中可观察到的 AI 工具和模型使用情况,将活动与存储库、贡献者和治理态势相关联。发现与情报

Surface 积极使用了 MCP 提供商、受影响的用户和存储库暴露情况,为 AI 工具供应链建立了治理基准。

关联 AI 使用信号、提交元数据、开发者信任分数® 和漏洞基准测试,以在代码投入生产之前识别风险增加的情况。

根据提交风险、AI 影响力和开发者信任分数® 触发有针对性的学习,从而减少反复出现的漏洞。

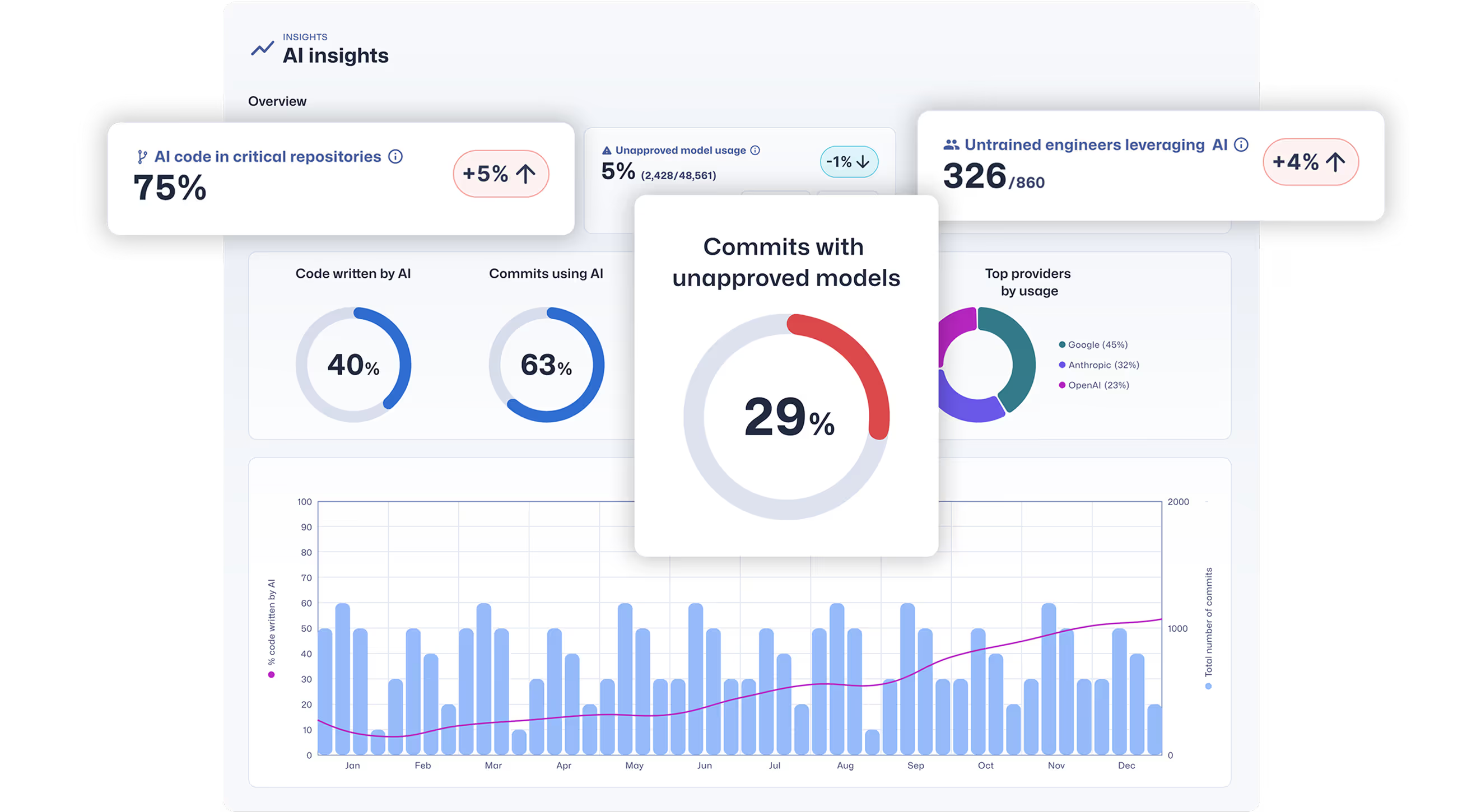

提供具有 AI 使用趋势、MCP 可见性和引入的漏洞指标的管理就绪仪表板,无需存储源代码或提示。

Trust Agent:人工智能集成到现代人工智能辅助开发工作流程中,为整个生态系统中的现有和新兴工具提供支持。

支持的环境包括:

信任代理:AI 支持主要的 LLM 提供商,包括:

信任代理:人工智能降低了人工智能引入的风险,加强了委员会层面的问责制,并在人工智能辅助开发中提供可执行的治理。它将人工智能治理从静态政策转变为可衡量的委员会级控制,将人工智能的采用转化为基于证据的安全结果。

了解 Trust Agent:AI 如何在 AI 辅助开发中提供可见性、关联性和策略控制。

了解 Trust Agent:AI 如何让人工智能辅助开发在您的安全 SDLC 中变得可见、可衡量和可执行。