Trust Agent: AI は AI の使用シグナルをキャプチャし、ソースコードやプロンプトではなくメタデータをコミットします。これにより、開発者のプライバシーを保護すると同時に、大規模なガバナンスを実現できます。AIを活用した開発を安全なSDLC全体で監査可能にし、ガバナンスが可能になり、本番稼働前に開発者のリスクを管理できるようになります。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

Trust Agent: AIはコード作成の段階でAIサイバーセキュリティガバナンスを実現します。

現在、AI コーディングアシスタント、LLM API、CLI エージェント、MCP 接続ツールがプロダクションコードに日々影響を与えています。開発速度は加速し、ソフトウェアライフサイクル全体にわたってガバナンスの複雑さが増しています。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

従来のアプリケーションセキュリティツールは、コードが記述された後に脆弱性を検出します。Trust Agent はコミット時に AI モデルの制限と安全なコーディングポリシーを適用し、導入された脆弱性が本番環境に入る前に防止します。

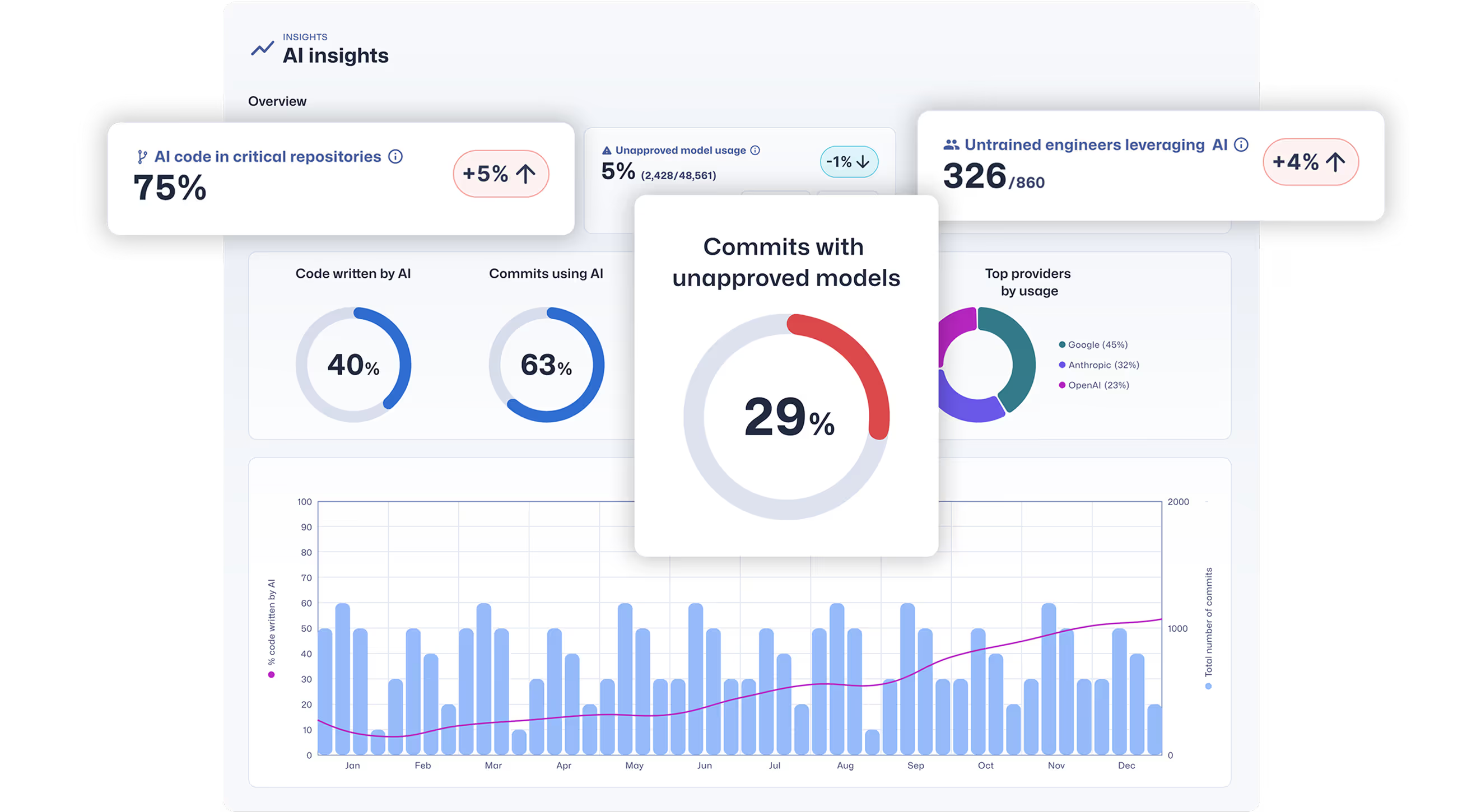

開発者のワークフロー全体で観察可能なAIツールとモデルの使用状況を把握し、アクティビティをリポジトリ、コントリビューター、ガバナンス体制と関連付けます。発見とインテリジェンス

積極的に利用しているMCPプロバイダー、影響を受けたユーザー、リポジトリにさらされるリスクを明らかにし、AIツールサプライチェーンのガバナンスベースラインを確立します。

AI の使用シグナル、コミットメタデータ、開発者の Trust Score®、脆弱性ベンチマークを相互に関連付け、コードが本番環境に移行する前にリスクが高まっていることを特定します。

コミットリスク、AI の影響、開発者の Trust Score® に基づいて対象を絞った学習を開始し、繰り返し発生する脆弱性を減らします。

ソースコードやプロンプトを保存しなくても、AI の使用傾向、MCP の可視性、導入された脆弱性メトリクスを経営陣がすぐに利用できるダッシュボードを提供できます。

Trust Agent: AI は最新の AI 支援開発ワークフローに統合され、エコシステム全体で既存のツールと新しいツールの両方をサポートします。

サポートされている環境には以下が含まれます。

トラストエージェント:AIは以下を含む主要なLLMプロバイダーをサポートします。

トラストエージェント:AI は AI がもたらすリスクを軽減し、コミットレベルのアカウンタビリティを強化し、AI 支援開発全体で強制力のあるガバナンスを実現します。AIガバナンスを静的なポリシーから測定可能なコミットレベルの制御に変え、AIの導入をエビデンスに基づくセキュリティ上の成果に変えます。

Trust Agent: AI が AI 支援開発全体でどのように可視化、相関関係、ポリシー制御を実現するかをご覧ください。

Trust Agent: AI が AI を活用した開発を、安全な SDLC 全体でどのように可視化し、測定可能にし、実施可能にするかをご覧ください。