Trust Agent: AIはソースコードやプロンプトではなく、 AIの使用状況シグナルとコミットメタデータを捕捉します。 これにより開発者のプライバシーを保護しつつ、 大規模なガバナンスを実現します。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

Trust Agent: AIはコード作成の段階でAIサイバーセキュリティガバナンスを実現します。

AIコーディングアシスタント、LLM API、CLIエージェント、MCP連携ツールが、今や日常的に本番コードに影響を与えている。開発速度は加速し、ソフトウェアライフサイクル全体に新たなガバナンスの複雑さが生じている。

Trust Agent: AIはAIソフトウェアガバナンスをソフトウェア開発ライフサイクルに組み込みます。AI支援開発の可視化を実現し、コミット時のリスクを相関分析し、組織が安全にAIコーディングを拡張することを可能にします。

AIツールとモデルの使用状況、MCP活動、コミットメタデータ、開発者Trust Score®、脆弱性ベンチマークを相互に関連付けることで、Trust Agent: AIは組織が以下を実現するのを支援します:

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

従来のアプリケーションセキュリティツールは、コードが記述された後に脆弱性を検出します。Trust Agentはコミット時にAIモデルの制限とセキュアコーディングポリシーを強制し、導入された脆弱性が本番環境に流入する前に防止します。

Capture observable AI tool and model usage across developer workflows, correlating activity to repositories, contributors, and governance posture.

表面的に使用されたMCPプロバイダー、影響を受けたユーザー、およびリポジトリの露出を特定し、AIツールのサプライチェーンにおけるガバナンスの基盤を確立する。

AI使用シグナル、コミットメタデータ、開発者信頼スコア®、脆弱性ベンチマークを相関分析し、コードが本番環境に到達する前に高リスクな露出を特定する。

コミットリスク、AIの影響度、開発者Trust Score®に基づき、対象を絞った学習をトリガーし、繰り返し発生する脆弱性を削減します。

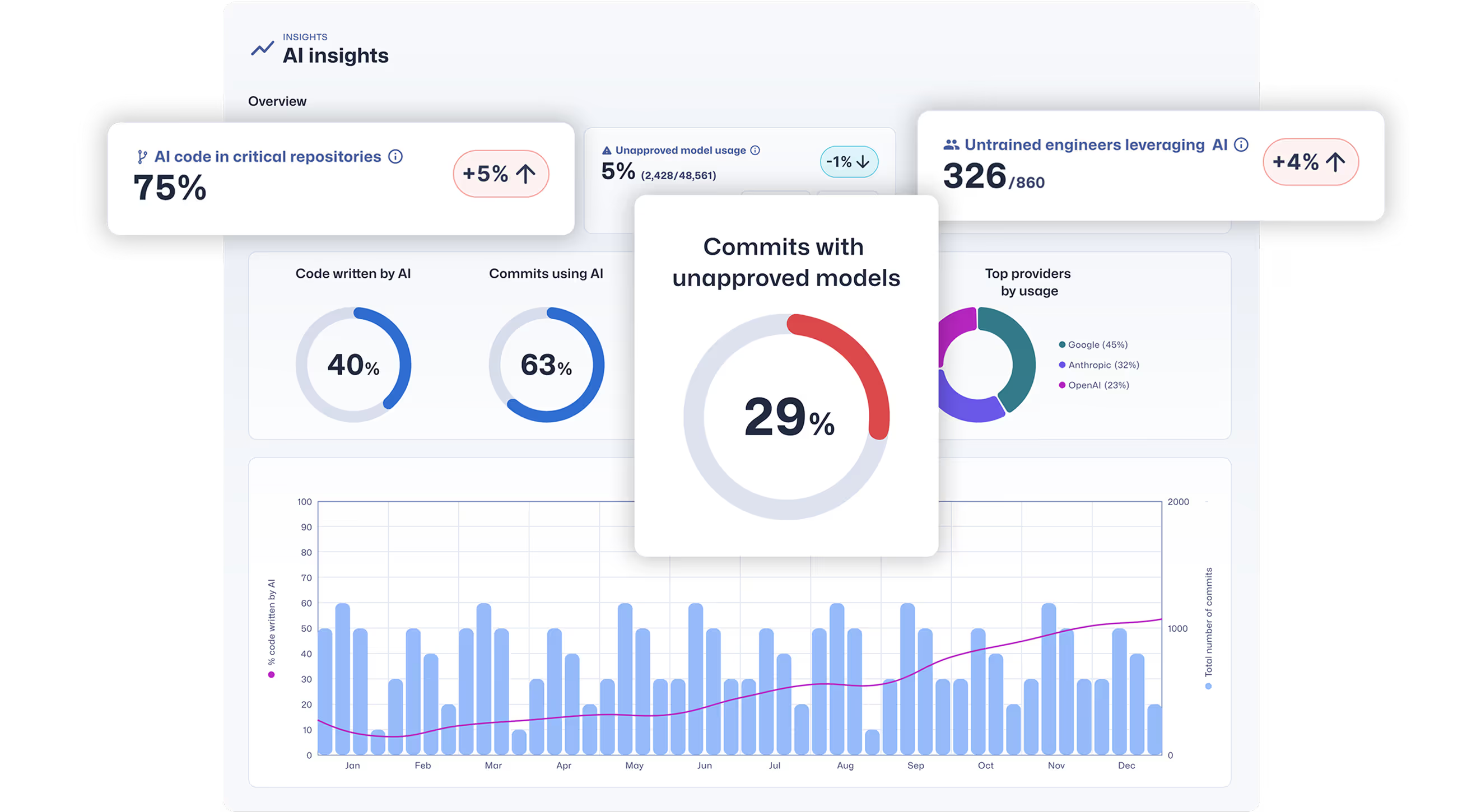

ソースコードやプロンプトを保存することなく、AI使用動向、MCP可視性、導入された脆弱性指標を備えた経営陣向けダッシュボードを提供します。

Trust Agent: AIは現代のAI支援開発ワークフローに統合され、エコシステム全体で確立されたツールと新興ツールの両方をサポートします。

サポート対象環境には以下が含まれます:

Trust Agent: AIは主要なLLMプロバイダーをサポートしており、以下を含みます:

Trust Agent: AIはAI導入リスクを低減し、コミットレベルでの説明責任を強化し、AI支援開発全体にわたり強制力のあるガバナンスを実現します。静的なポリシーから測定可能なコミットレベル制御へとAIガバナンスを変革し、AI導入を証拠に基づくセキュリティ成果へと転換します。

Trust Agent: AI が、AI 支援開発全体において可視性、相関性、ポリシー制御をどのように実現するかをご覧ください。

Trust Agent: AIが、セキュアなSDLC全体でAI支援開発を可視化、測定可能、かつ強制可能な方法を実現する仕組みを学びましょう。