Govern AI-assisted development at the speed of innovation

Govern AI-assisted development at the speed of innovation

AI is transforming how software is created. SCW provides the visibility and enforceable control required to scale AI adoption without increasing enterprise risk.

AIの新世界におけるセキュアな開発のアップスキル

Secure Code Warrior AI と LLM の活用に関する認識不足から、AI 生成コードの安全性に対する過度の自信、AI コーディングに関連する新たな脆弱性の出現に至るまで、さまざまなギャップに対処するように設計された、関連性の高いスキルアップイニシアチブにより、AI 支援開発プラクティスに移行する企業をサポートします。

SDLC全体の様々な役割におけるリスク軽減に役立つ、AI/LLMに関するトピックを網羅した最高クラスのコンテンツをご用意しています。開発者やQA、アーキテクト、プロダクトマネージャーなど、あらゆる役割に対応します。

次世代セキュアソフトウェア開発

AI+開発者の世界でリスクを軽減する

より多くのコード行が、より少ない精査で、より速く作成されるようになり、隠れたバグ、セキュリティ脆弱性、技術的負債のリスクは指数関数的に増大する。このシフトにより、コードレビュー、テスト、セキュアコーディングの実践がこれまで以上に重要になり、スピードが信頼性とセキュリティを犠牲にすることがないようにする。開発者のスキルアップは、Github Copilot、Cursor AI、Amazon Q developerなどのツールが活用されている環境において、より良い成果を得るための第一歩であり、セキュアなコード教育を引き続き重視する必要性を強調している。

Learning Platform コンテンツを探る

観測可能性とガバナンスでAIリスクを管理する

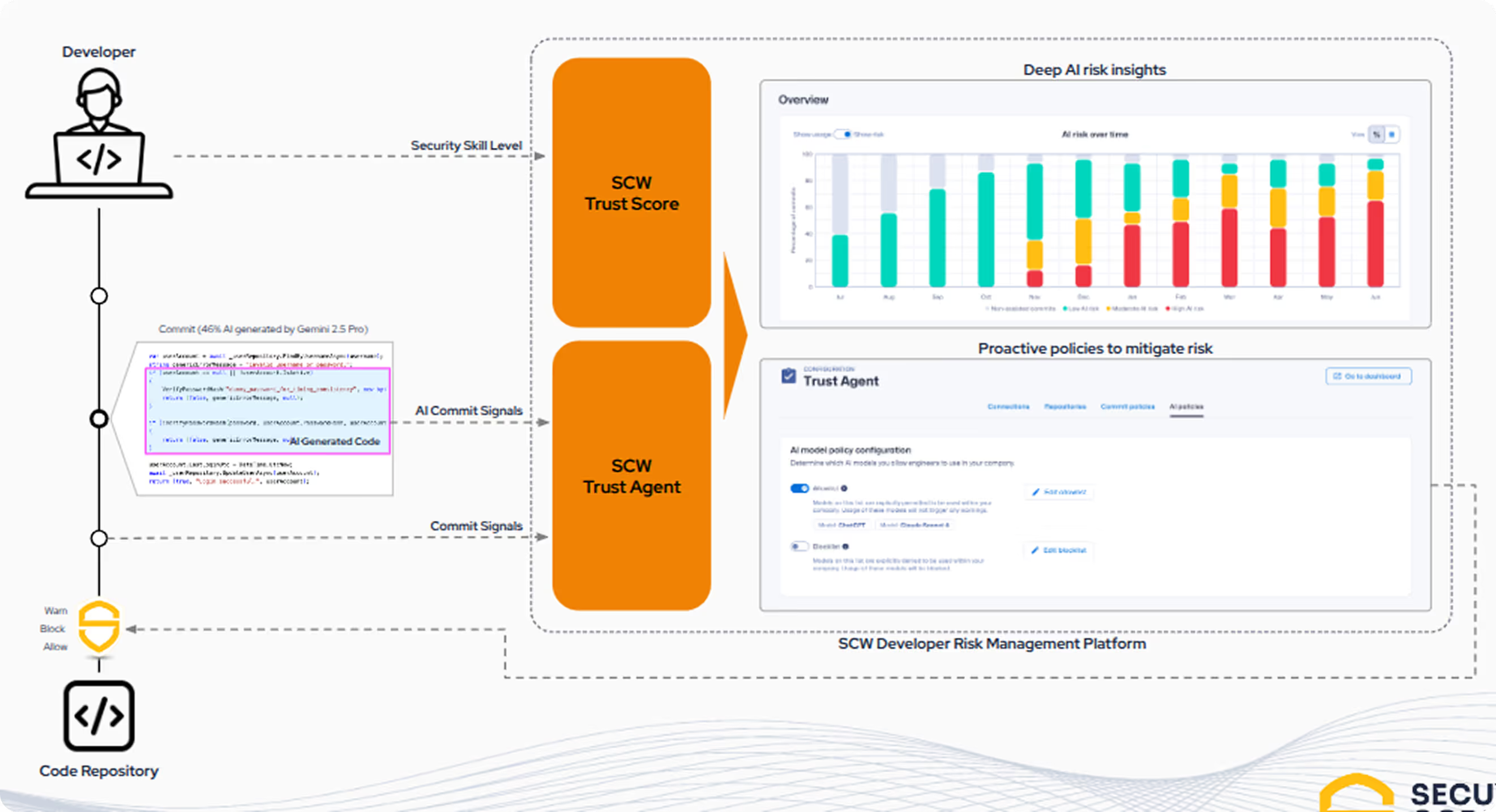

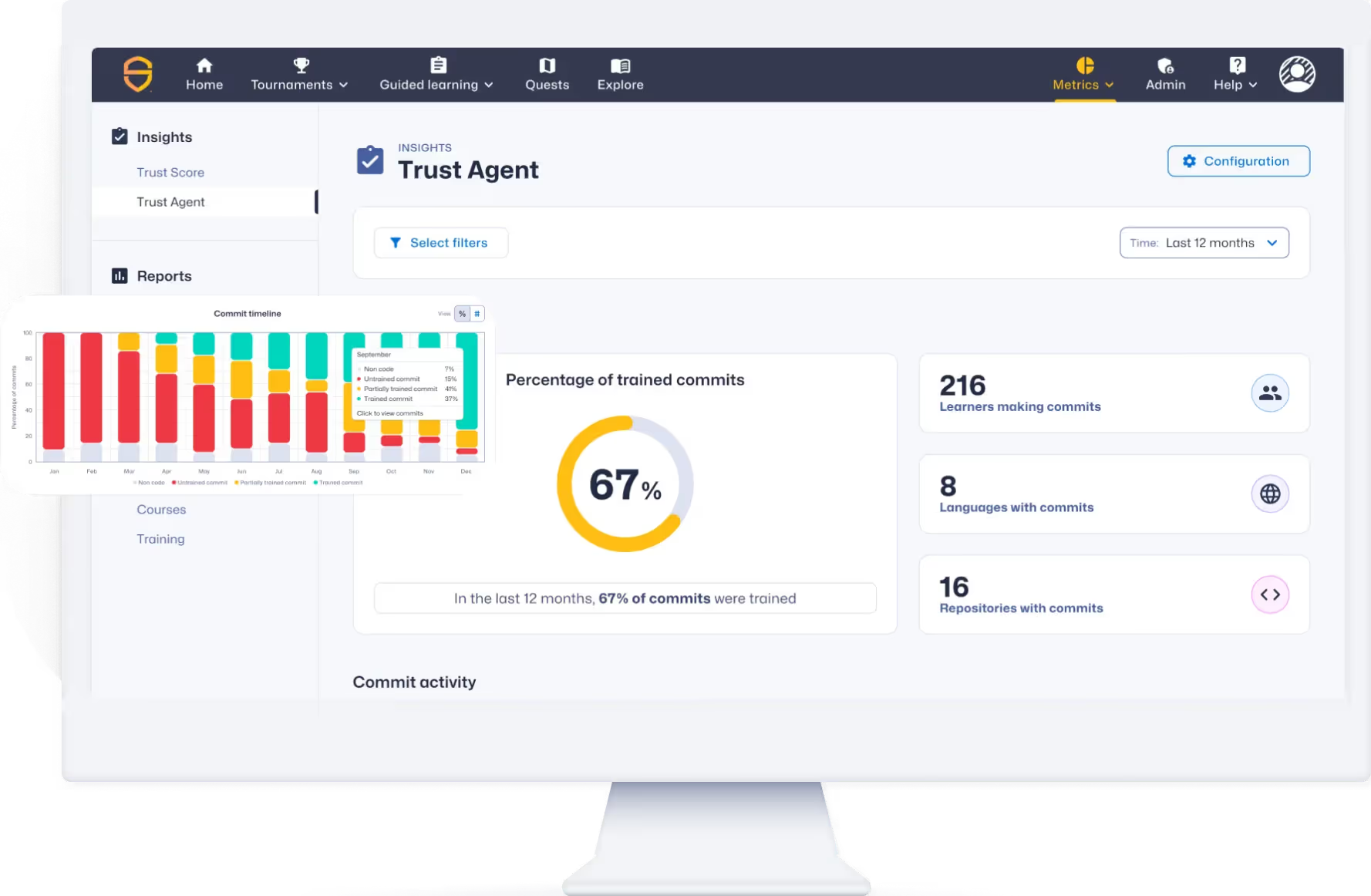

スキルの取り組みは、AI支援コーディングによってもたらされる新たなリスクに確実に対処するための第一歩に過ぎません。SCW Trust Agent™は、コードベースで作業している開発者を可視化し、セキュリティ・スキルに関する洞察を提供します。そして、コード・リポジトリに対するポリシーを設定し、プロアクティブなガバナンスを通じてセキュリティ態勢を向上させることができます。

SCW信託代理店コンプライアンスを超えた測定可能なインパクト

セキュアコードのベストプラクティスに対して、コンプライアンスを超えた積極的なアプローチを採用する組織は、目に見えるビジネス成果を上げている。なぜなら、脆弱性に対処する最も費用対効果の高い方法は、脆弱性を最初から防ぐことだからです。SCW Trust Score™は、開発者のセキュリティスキルの進捗を経時的に測定し、ベンチマークする方法を組織に提供します。これは、AI主導のコーディング環境の早期導入に関連して追跡することが特に重要です。

SCWの信頼スコアを探る

無料のセキュリティルールでより安全な AI コード生成をガイド

AI コーディング ツールは高速ですが、必ずしも安全ではありません。 Secure Code Warriorの無料AIセキュリティルールは、CopilotやCursorなどのツールがより安全なコードをデフォルトで生成できるように、シンプルで軽量なガードレールを提供します。導入、拡張、そして設定への組み込みも簡単で、SCWアカウントは必要ありません。

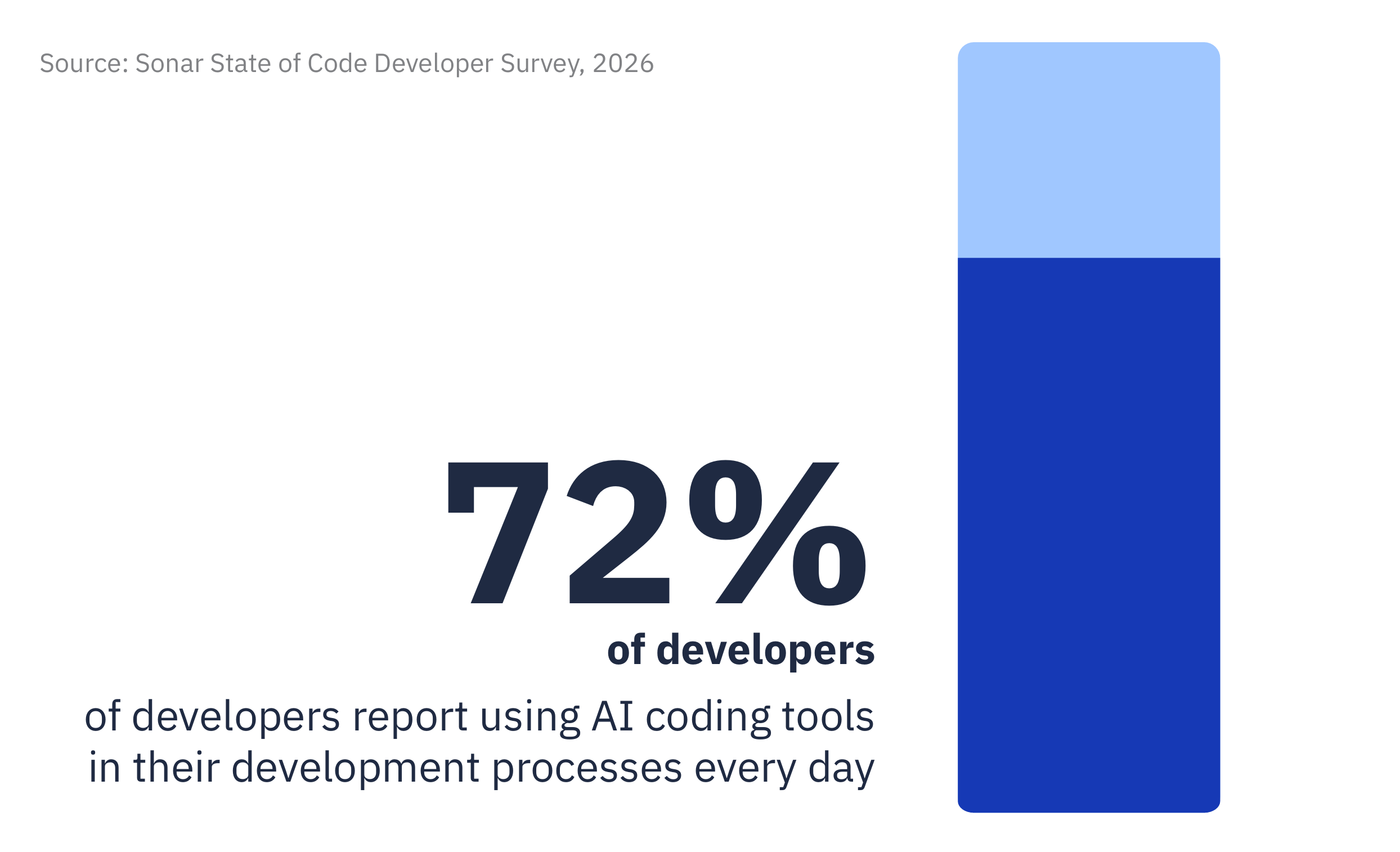

AIセキュリティルールを調べる生産性は向上したが、リスクは増大

AIコーディングツールの普及は、AIが生成したコードの可視性とガバナンスの欠如という新たな課題を提示している。

78%

- スタックオーバーフロー

30%

- arXiv

50%

- BaxBench

トラスト・エージェントのメリットAI

SCW Trust Agentの新しいAI機能は、セキュリティを犠牲にすることなく、セキュアなソフトウェア開発ライフサイクル(SDLC)においてAIの導入を自信を持って管理するために必要な、深い観測性と制御性を提供します。

SDLCにおけるAIの課題

AIの利用を管理する方法がなければ、CISO、AppSec、エンジニアリング・リーダーは、新たなリスクや答えのない疑問にさらされることになる。どの開発者がどの未承認モデルを使用しているのかが見えない。AIを使用する開発者のセキュリティ熟練度が不明確である。AIツールのリスクを管理するためのポリシーやガバナンスを実施できない。

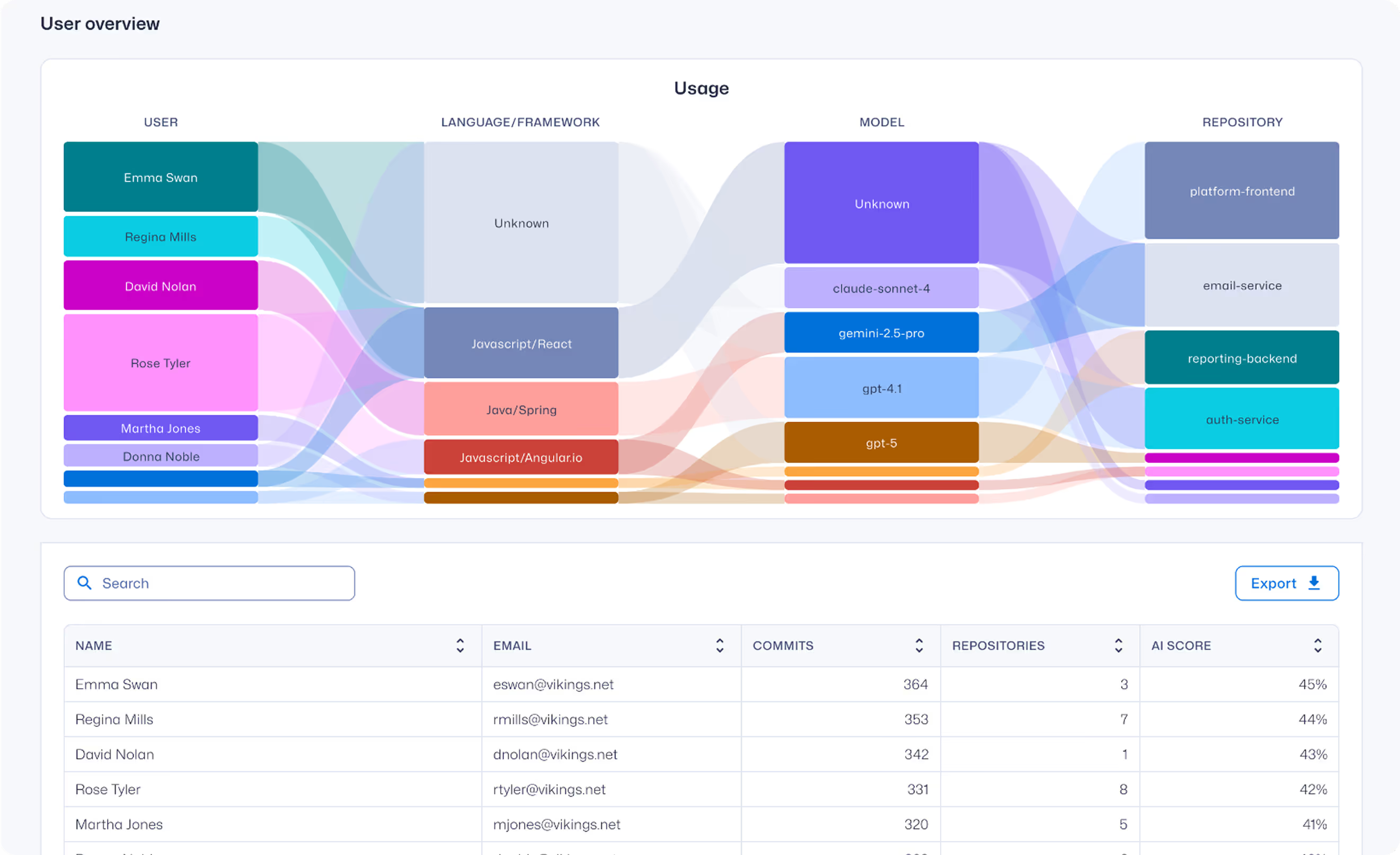

- どの開発者がどの未承認モデルを使用しているかが見えない。

- AIを使用する開発者のセキュリティ能力に関する不確実性。

- 貢献コードの何パーセントがAIによって生成されたものなのかについての洞察はない。

- AIツールのリスクを管理するためのポリシーとガバナンスを実施することができない。

シグナルのユニークな組み合わせ

SCWは、企業がセキュリティを犠牲にすることなく、AI主導の開発スピードを受け入れることを支援します。AI Signalsは、3つの重要なシグナルのユニークな組み合わせを相関させることで、可視性とガバナンスを提供する初のソリューションであり、コミットレベルでAI支援開発者のリスクを把握します。

- AIコーディングツールの使用状況:誰がどのAIツールを使っているか、どのコードベースでどのLLMモデルを使用しているかについての洞察。

- リアルタイムで捕捉トラスト・エージェント:開発者のコンピュータとIDE上でAIが生成したコードをAIが傍受する。

- 開発者のセキュアコーディングスキルAIを責任を持って使用するために必要な基礎スキルである、開発者のセキュアコーディング能力を明確に把握します。

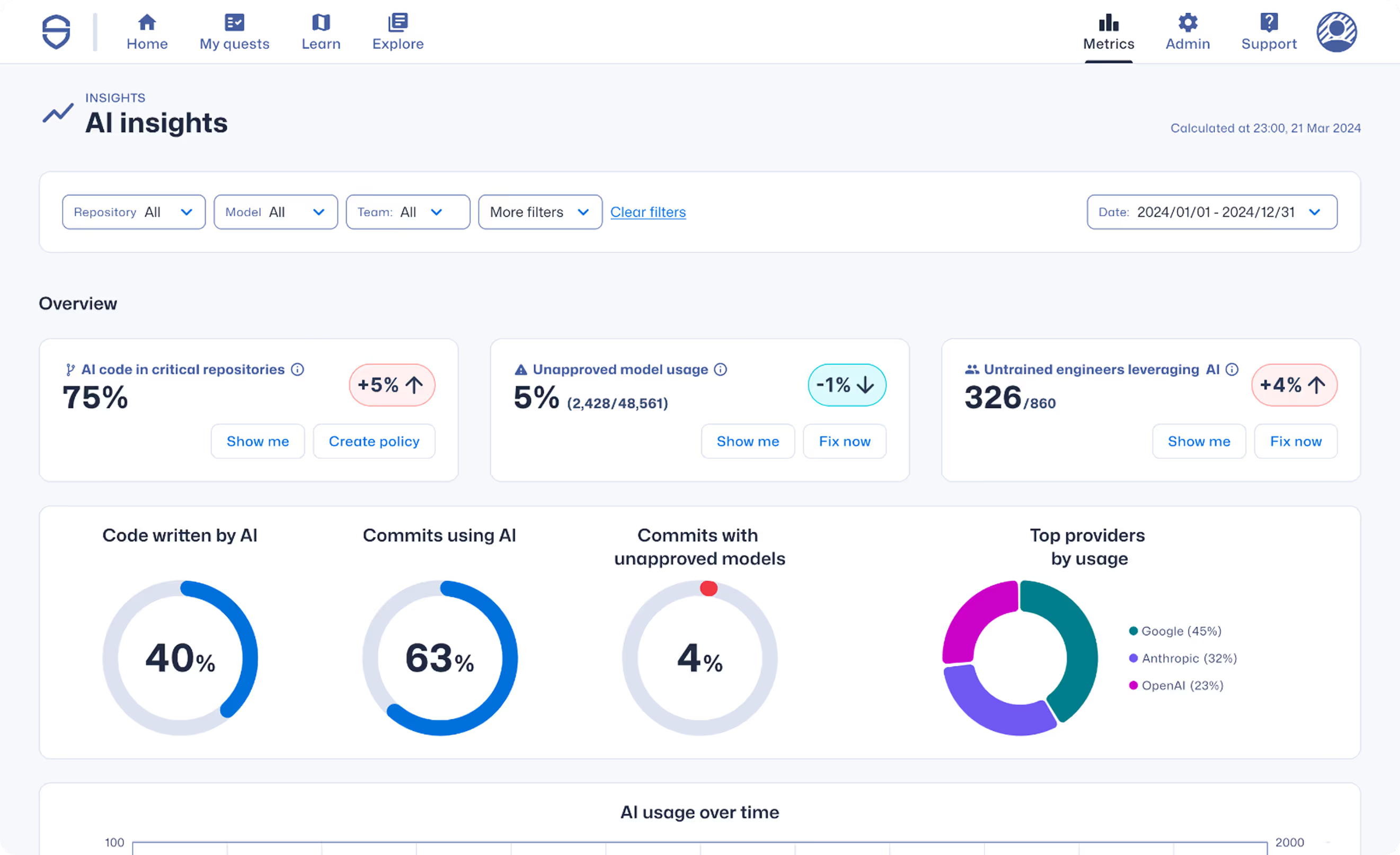

AI利用の可視化

AIコーディングアシスタントとエージェントの全体像と、それらを動かすLLMを把握する。未承認のツールやモデルを発見。"影のAI "はもういらない。

開発者とコードベースによるAI支援コミットの観測可能性

どの開発者がどのLLMモデルをどのコードベースで使用しているかなど、AIによるソフトウェア開発を深く可視化する。

統合されたガバナンスとコントロール

AIが生成したコードと実際のコミットを結びつけ、導入されている真のセキュリティリスクを把握する。ポリシーの適用を自動化し、AIを使用できる開発者が、その貢献を受け入れる前にセキュアなコーディング基準を満たしていることを確認する。

AIインサイトの発見

トラスト・エージェントAIは、LLMに裏付けされたコード生成ツールを使用する開発者によってもたらされるリスクを可視化します。このソリューションは3つのステップでこれを実現する:

- AIが生成したコードトラフィックを検査する:トラスト・エージェント:AIは、GitHub Copilot、ChatGPT、Google Gemini、CursorなどのAIコーディングツールによって生成されたコードをインターセプトして監視する、シンプルなIDEプラグインまたはエンドポイントエージェントとしてデプロイされる。

- 開発者のスキルレベルのエンリッチ: 最後のステップでは、SCW の業界をリードする Secure Code Learning 製品によって測定された、貢献した開発者のセキュアコーディングの熟練度でこのデータを強化します。

これらの重要なシグナルを相関させることで、Trust Agent:AIは、セキュリティチームとエンジニアリングチームに、未承認のLLMモデルの使用や、AIが生成したコードをコミットしているセキュアコーディングの知識が乏しい開発者の特定など、実用的な情報を提供します。

AI velocity is outpacing security oversight

As AI coding assistants and LLM APIs become embedded in your SDLC, the gap between development speed and governance creates unprecedented exposure. Leaders need data, not assumptions.

The AI software governance platform

Gain observability into your AI-Driven SDLC

- Enterprise AI observability

- Adaptive learning for human and AI

- コミットレベルのリスク相関

Increase confidence in AI-driven software delivery

AI利用状況の可視化

コンプライアンスを実現する

コミットレベルのリスク相関

ガバナンス報告

Secure Code Warrior お好みのワークフローに統合

インテグレーション

リリース速度を犠牲にすることなく、安全なソフトウェア開発を優先させたいと考えている企業は、統合されたテクノロジースタックの重要性をよく理解しています。当社の統合ソリューションは、開発者が日常的に使用するツールに安全なコードトレーニングを統合することで、開発者を支援します。

さらに詳しく