Trust Agent: AIはAI使用信号を収集し、メタデータ(ソースコードや入力プロンプトではない)を送信するため、開発者のプライバシーを保護しつつ包括的なガバナンスを実現します。これにより、安全なSDLCにおけるAI支援開発を検証・制御し、開発リスクを本番環境導入前に管理することが可能となります。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

Trust Agent: AIはコード作成の段階でAIサイバーセキュリティガバナンスを実現します。

KIコーディングアシスタント、LLM API、CLIエージェント、およびMCP連携ツールは、現在日常的に生産コードに影響を与えています。開発速度が加速した結果、ソフトウェアライフサイクル全体におけるガバナンスの新たな複雑性が生じています。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

従来のアプリケーションセキュリティツールは、コードが記述された後にセキュリティ上の脆弱性を検出します。Trust Agentはコミット時にAIモデルの制約と安全なコーディングのガイドラインを適用し、導入されたセキュリティ上の脆弱性が本番環境に展開される前に防止します。

開発者ワークフロー全体におけるAIツールおよびモデルの観測可能な利用状況を把握し、活動をリポジトリ、貢献者、ガバナンス姿勢と関連付けます。ディスカバリー&インテリジェンス

SurfaceはMCPプロバイダーを積極的に活用し、ユーザーとリポジトリリスクに影響を与え、AIツールのサプライチェーンにおけるガバナンス基盤を構築した。

AI利用シグナルを相関分析し、メタデータ、開発者向けTrust Score®、脆弱性ベンチマークを転送することで、コードが本番環境に展開される前に高リスクを検知します。

コミットリスク、AIの影響、開発者のTrust Score®に基づくターゲットを絞った学習を設定し、再発するセキュリティ上の脆弱性を削減します。

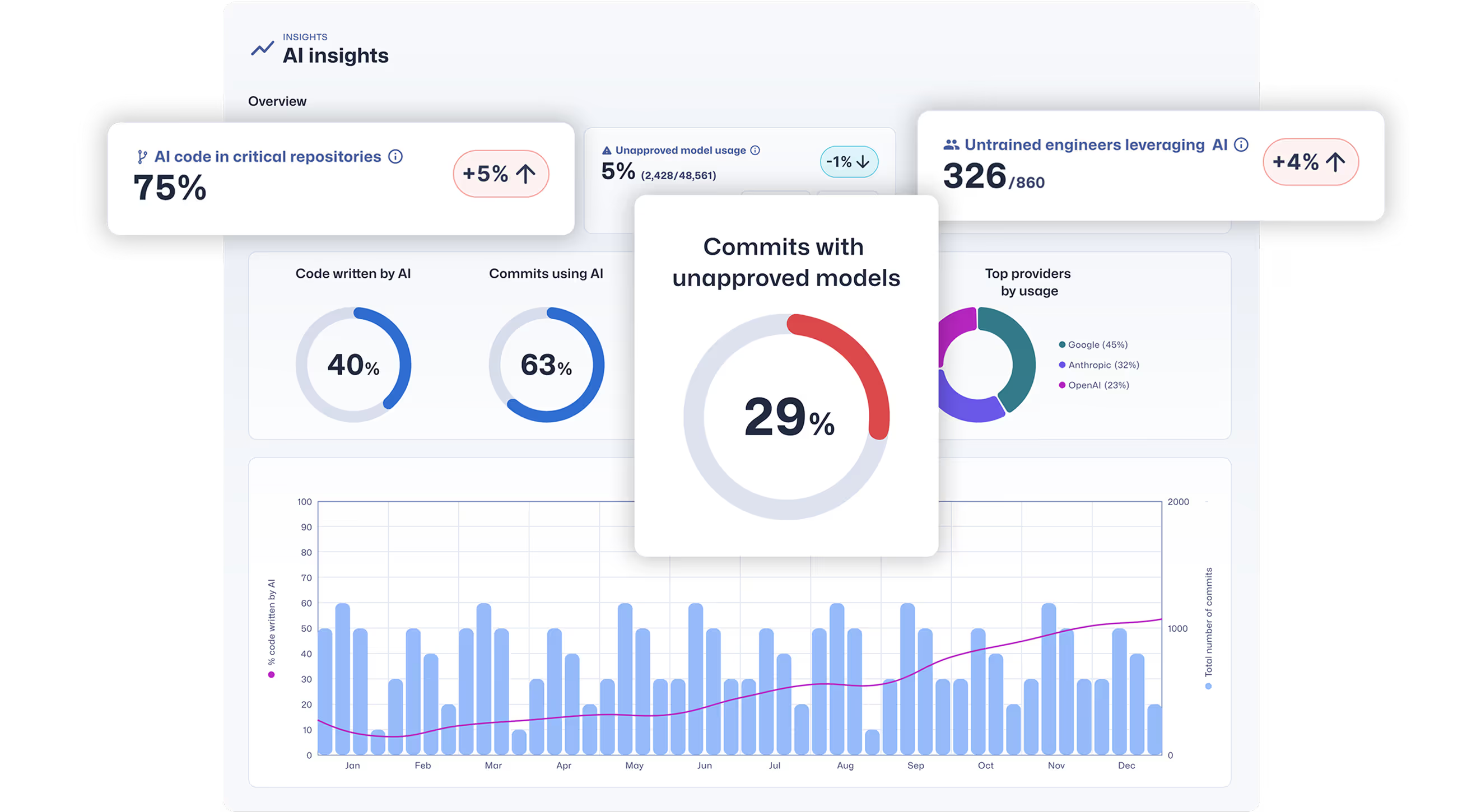

経営陣向けに、AI利用動向、MCP可視性、導入済み脆弱性指標を組み込んだダッシュボードを提供します。ソースコードや入力プロンプトを保存することなく。

Trust Agent: KIは現代のAI支援開発ワークフローに統合可能であり、エコシステム全体において既存ツールと新規ツールの両方をサポートします。

サポート対象環境には以下が含まれます:

Trust Agent: AIは主要なLLMプロバイダーを支援します。具体的には:

信頼できるエージェント:AIはAIがもたらすリスクを低減し、コミットメントレベルでの責任を強化し、AI支援開発における実行可能なガバナンスを確保します。これにより、AIガバナンスを静的なポリシーからコミットメントレベルで測定可能な管理へと変革し、AI導入を証拠に基づくセキュリティ成果へと転換します。

Trust Agent : AI が、AI 支援開発において可視性、相関性、ポリシー制御をどのように実現するかをご覧ください。

Trust Agent : AI が、セキュアな SDLC において AI 支援開発を可視化・測定可能・適用可能にする方法をご覧ください。