知恵はコードを書くが、技術がそれを守る。

当社の企業向けセキュアコーディングプラットフォームは、人間とAIの両方が生成したコードを、デプロイの速度を低下させることなく保護するために必要なスキルを提供します。

Traditionelle Sicherheitsschulungen konzentrieren sich auf — keine Fähigkeit. Statisches Scannen erkennt Probleme, nachdem sie aufgetreten sind. Um das Softwarerisiko zu reduzieren, muss das sichere Codierungsverhalten verbessert werden Sichere Codierungsfunktionen sind die Grundlage für eine effektive KI-Software-Governance.

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

大規模に安全なコーディング能力を構築する

安全なプログラミングのための実践的な実習

開発者は75以上の言語とフレームワークでインタラクティブな演習を通じて、実際のセキュリティ脆弱性を解決します。

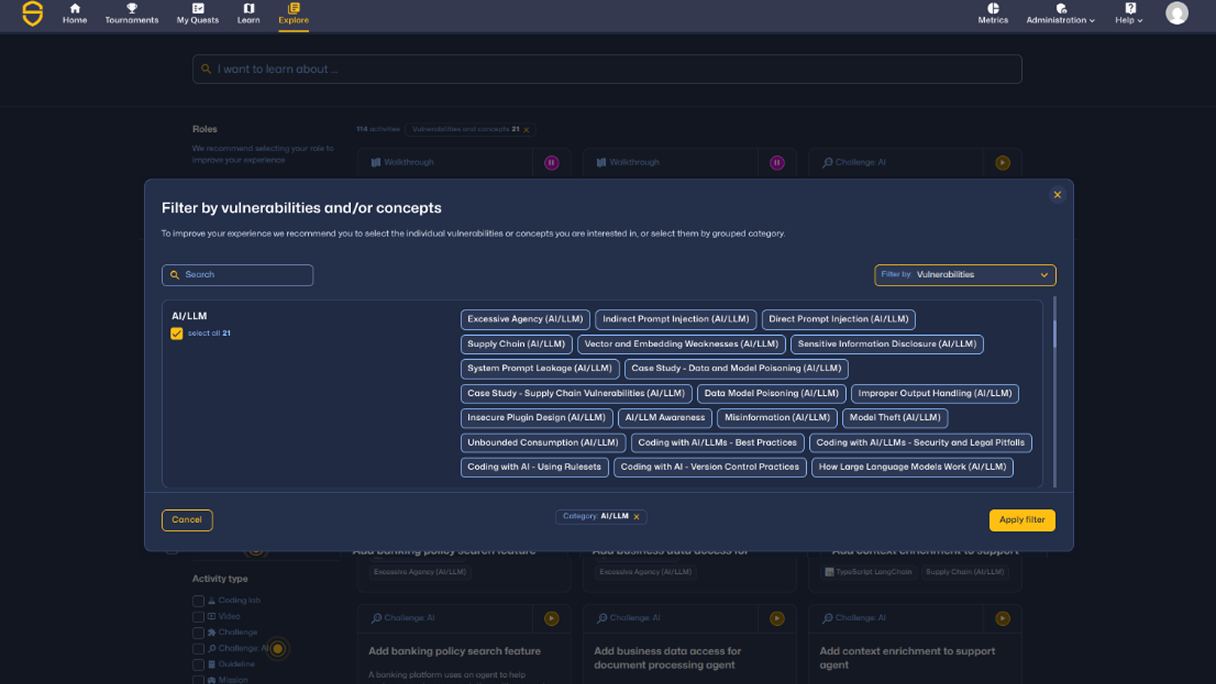

KI特化型セキュリティモジュール

AI生成コードの検証と保護、安全でないパターンの検出、AI支援ワークフローにおける安全基準の適用を行います。

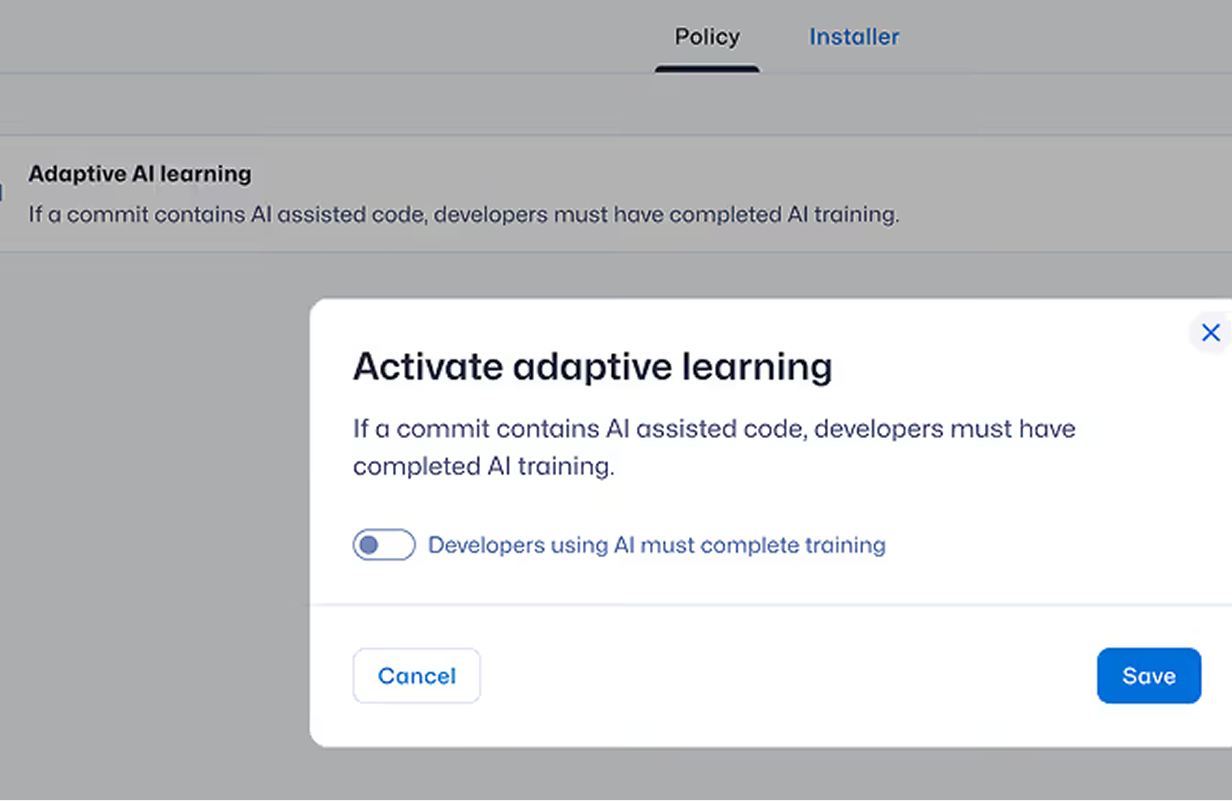

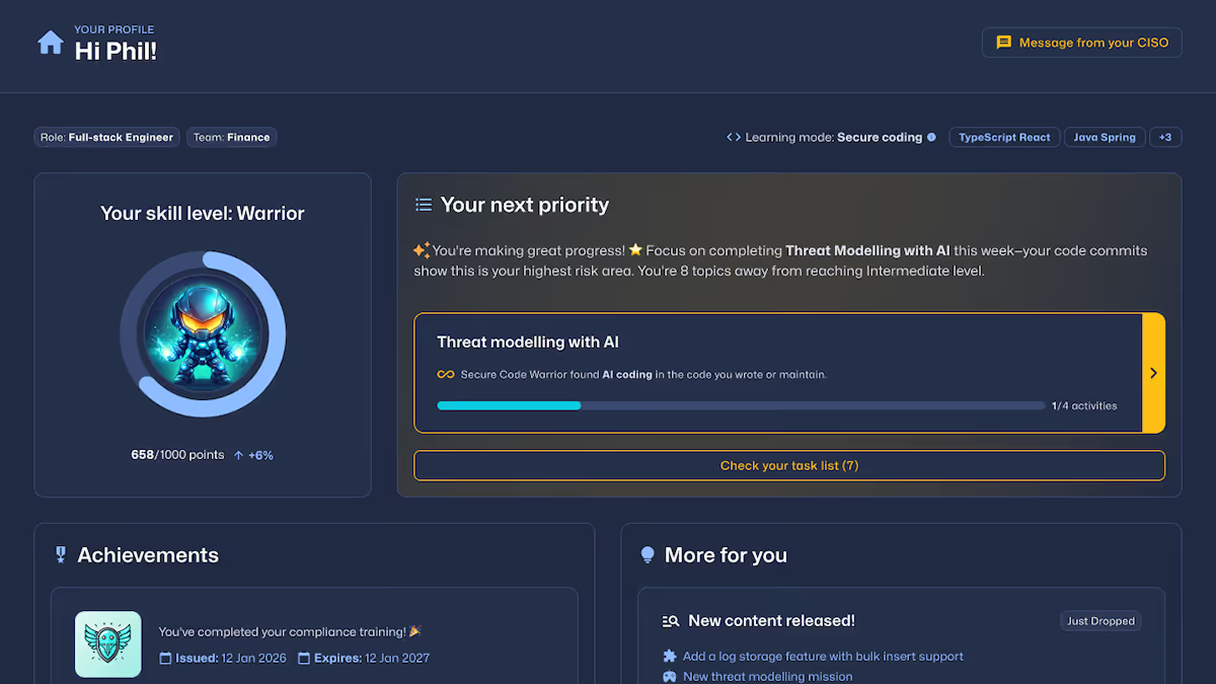

適応型学習パス

開発者の行動、リスクシグナル、またはベンチマークのギャップに基づいて、自動的にターゲットを絞ったトレーニングを割り当てます。

進捗を測定する

開発者のスキルを評価し、同僚と比較し、SCW Trust Score®で安全なコーディングにおける測定可能な進捗を追跡します。

規制遵守の達成

OWASP Top 10、NIST、PCI DSS、CRA、NIS2に準拠したトレーニングを提供し、監査対応レポートを発行します。

AI支援開発のための制御レベル

AIを活用した開発を可視化し、安全かつ強靭なものとし、生産段階以前にセキュリティ上の脆弱性を防止することで、チームが迅速かつ確信を持って行動できるようにします。

クエスト

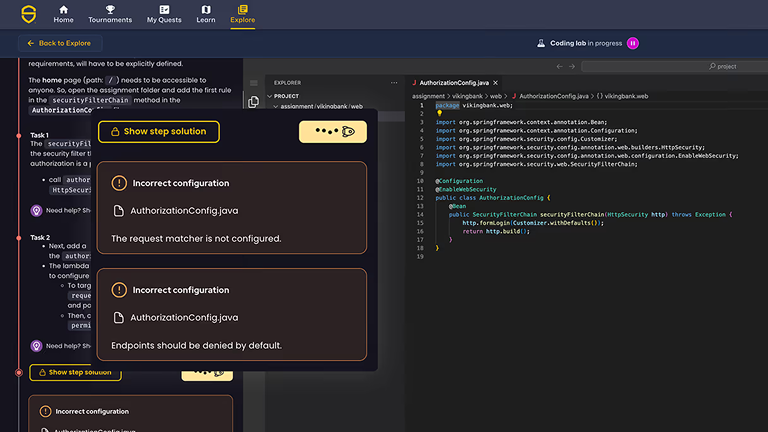

コーディング・ラボ

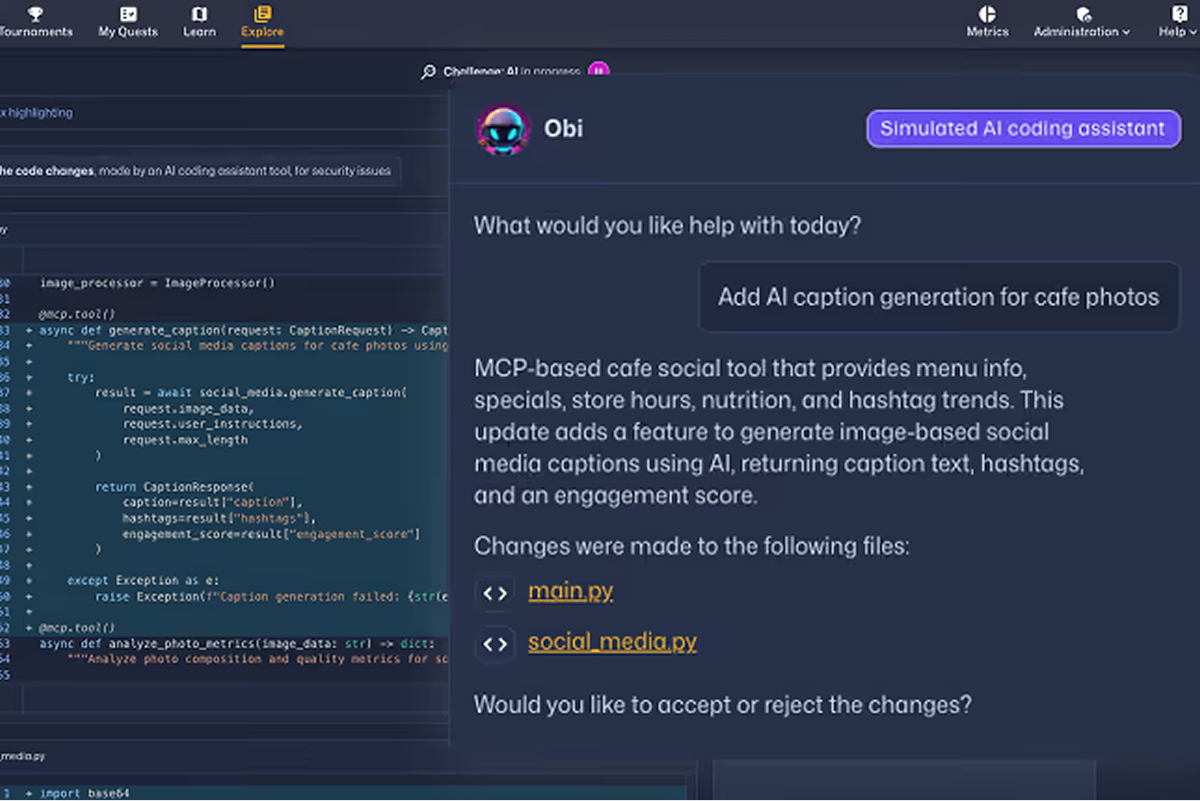

AIへの挑戦

Lorem ipsum dolor sit amet, consectetur adipiscing elit.3つの要素の中で、私はさまざまなことを中断します。Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat.Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet.Nunc ut sem vitae risus tristique posuere.

Missions

セキュリティ上の脆弱性を発生源で削減する

Secure Code Warrior 、再発するセキュリティ脆弱性を削減し、安全なプログラミング習慣を強化し、開発者にとって測定可能な改善をもたらします。これらの結果は、現代の開発環境において大規模な企業内でのセキュアプログラミング研修がもたらす測定可能な効果を実証しています。

改修の時期

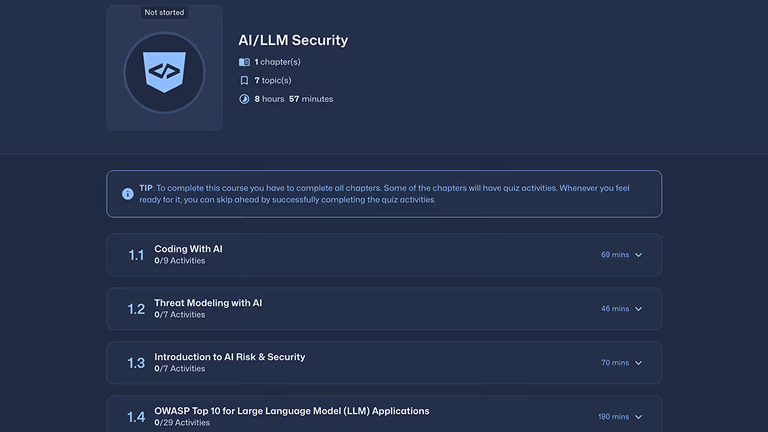

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

特にAIガバナンスチーム向けに開発

測定可能な開発者スキルを実証し、人的およびAI支援開発におけるソフトウェアリスクを低減します。

安全なコードは安全な開発者から始まる

セキュアプログラミングのスキルを強化し、導入されたセキュリティリスクを軽減し、企業全体で開発者の信頼を測定可能な形で構築します。

実践的な学習を通じて安全なプログラミングを習得し、セキュリティ上の脆弱性を削減しましょう

Secure Code Warrior 向上させ、脆弱性を削減し、測定可能なリスク低減を実現する方法をご覧ください。