L'IA peut écrire du code, mais les compétences le sécurisent.

Notre plateforme de codage sécurisée d'entreprise développe les compétences nécessaires pour sécuriser le code humain et généré par l'IA sans ralentir la livraison.

L'IA accélère le code. Les compétences en matière de codage sécurisé doivent suivre le rythme.

Les assistants de codage IA peuvent générer du code prêt pour la production en quelques secondes. Mais rapidité n'est pas synonyme de sécurité.

La formation à la sécurité traditionnelle se concentre sur — pas une capacité. L'analyse statique détecte les problèmes une fois qu'ils sont apparus. Pour réduire les risques liés aux logiciels, il faut améliorer le comportement de codage sécurisé La capacité de codage sécurisée est la base d'une gouvernance efficace des logiciels d'IA.

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

Développez des compétences de codage sécurisé à grande échelle

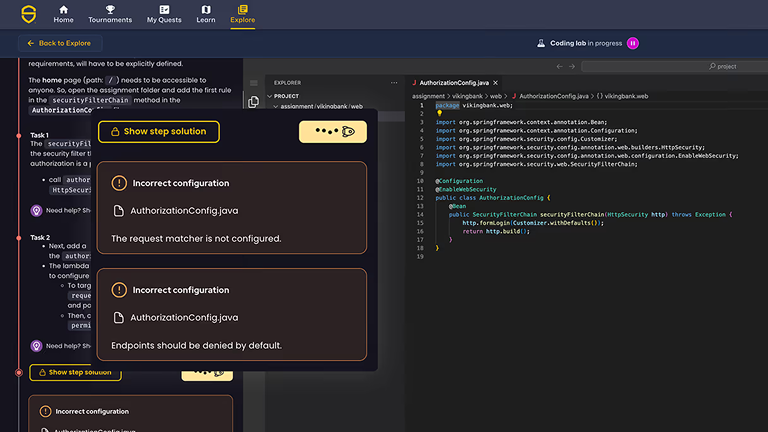

Laboratoires de codage sécurisés et pratiques

Les développeurs résolvent de véritables vulnérabilités grâce à des exercices interactifs dans plus de 75 langages et frameworks.

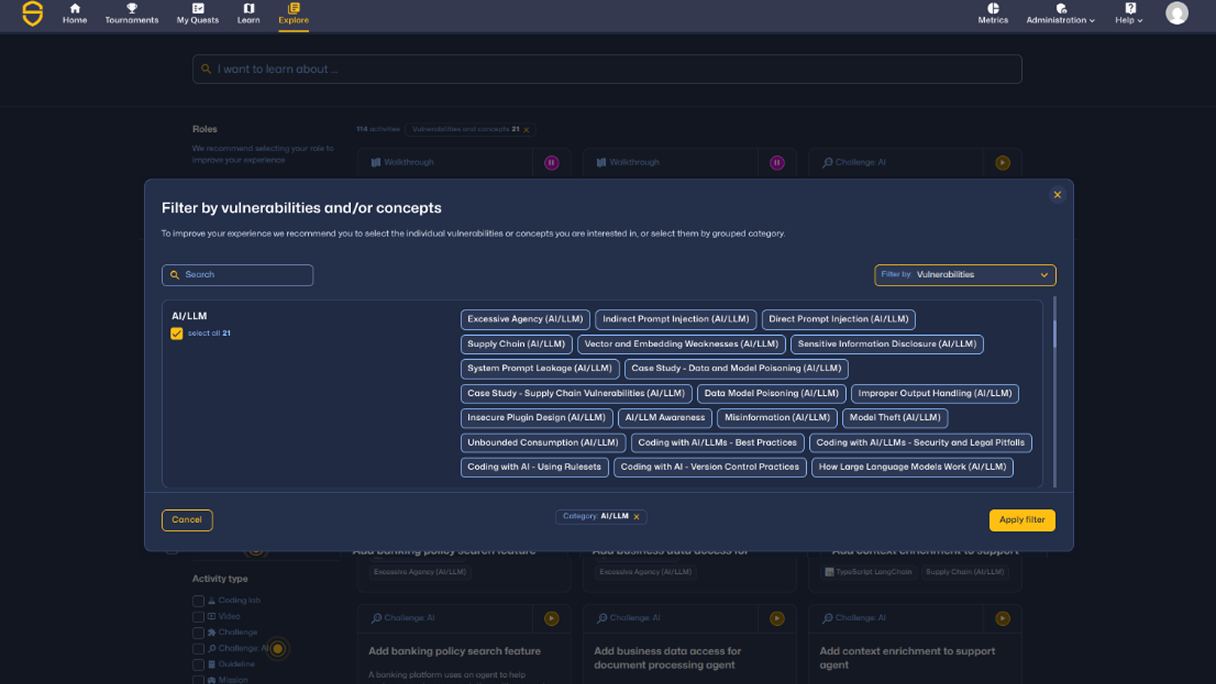

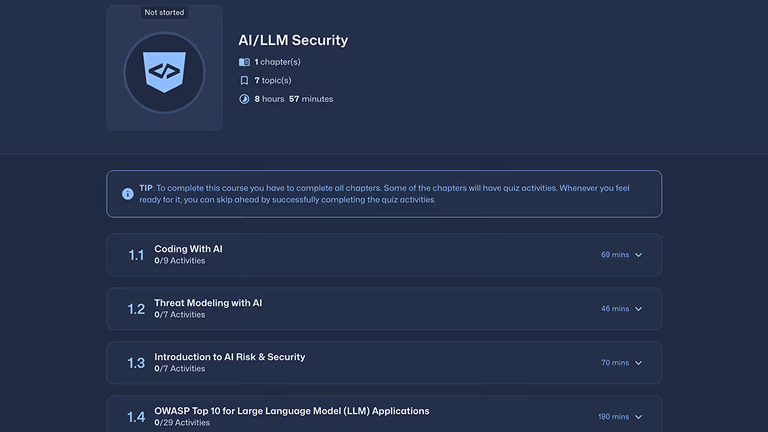

Modules de sécurité spécifiques à l'IA

Validez et sécurisez le code généré par l'IA, détectez les modèles non sécurisés et appliquez des normes de sécurité aux flux de travail assistés par l'IA.

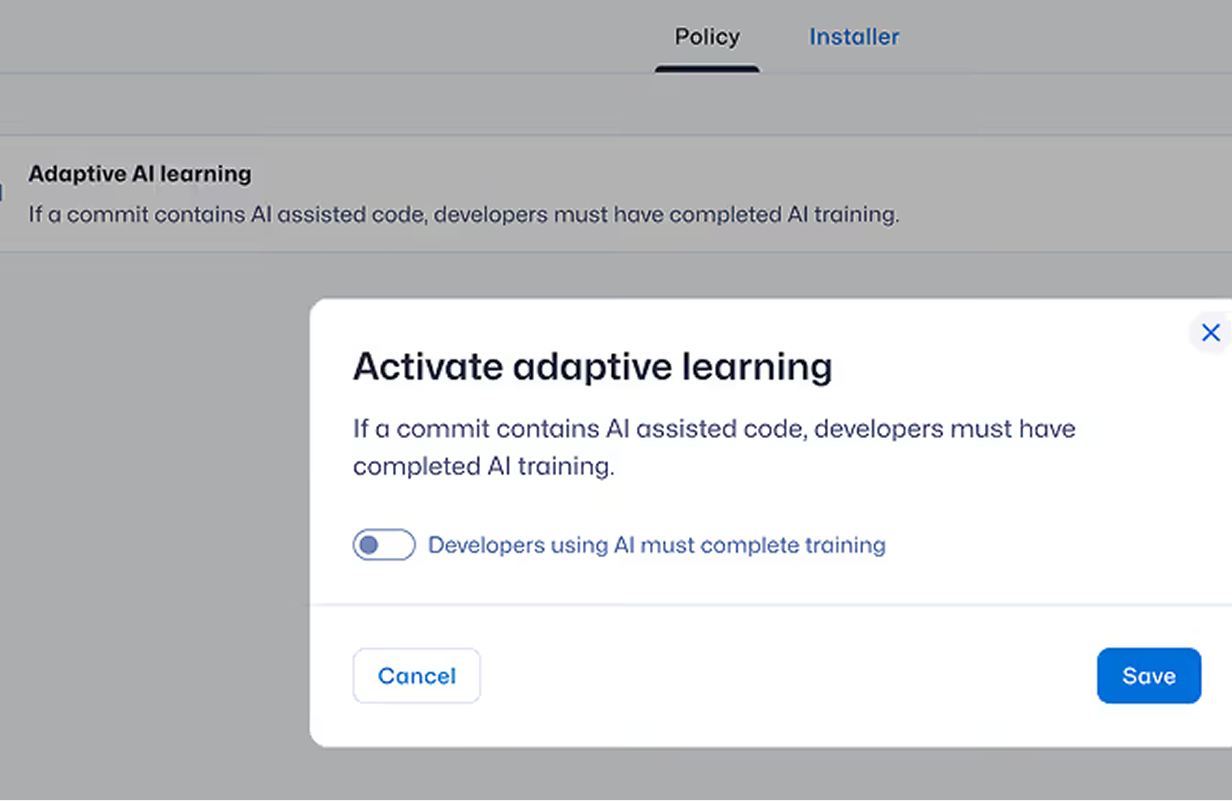

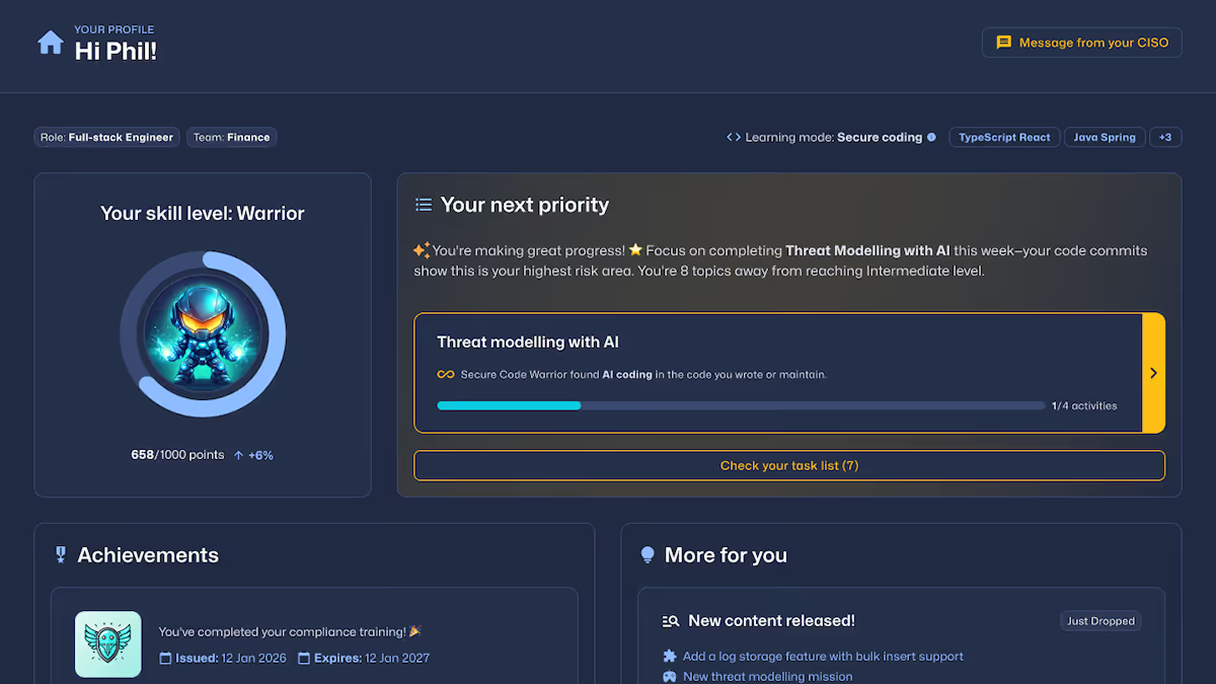

Parcours d'apprentissage adaptatifs

Attribuez automatiquement une formation ciblée en fonction du comportement des développeurs, validez des signaux de risque ou évaluez les lacunes.

Mesurez les progrès

Évaluez les compétences des développeurs, comparez-les à leurs pairs et suivez les progrès mesurables en matière de codage sécurisé grâce au SCW Trust Score®.

コンプライアンスを確保する

Alignez la formation sur les normes OWASP Top 10, NIST, PCI DSS, CRA et NIS2 grâce à des rapports prêts à être audités.

AI主導の開発のための管理計画

AI主導の開発を可視化、安全かつ回復力のあるものにし、本番環境前に脆弱性を予防することで、チームが自信を持って迅速に行動できるようにします。

クエスト

コーディング・ラボ

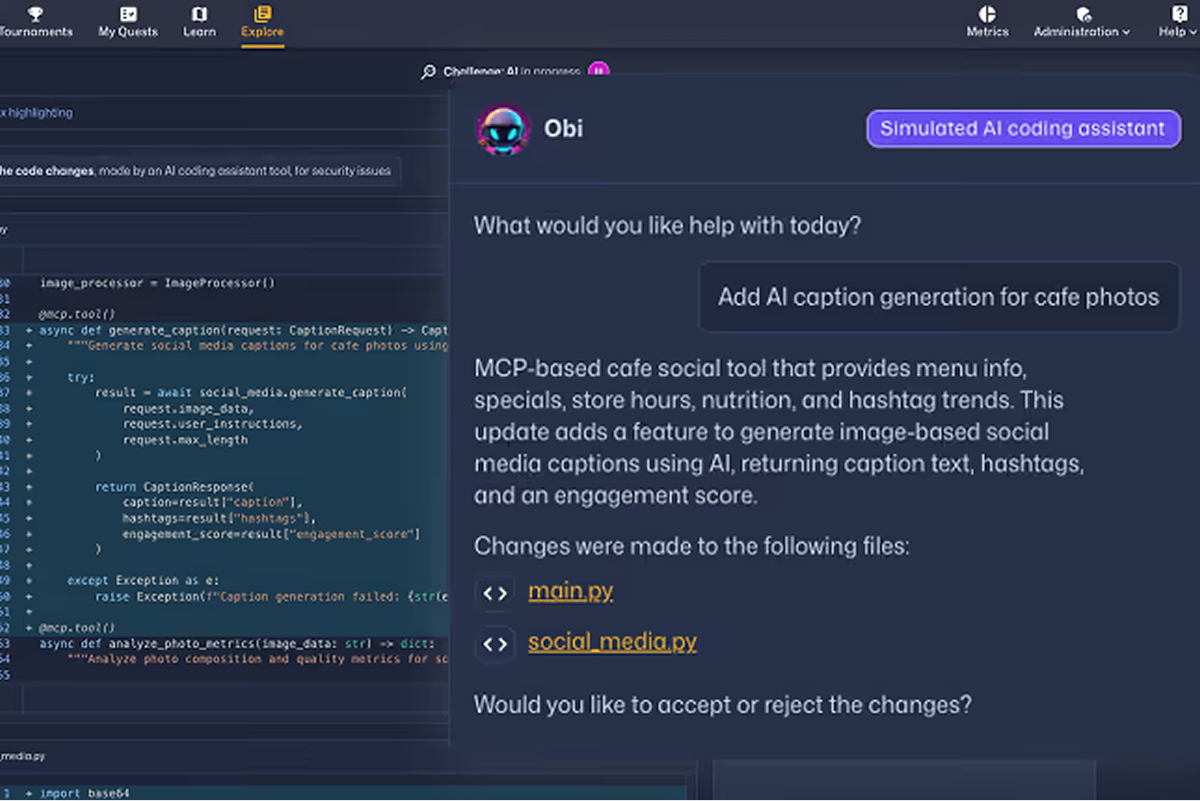

AIへの挑戦

Lorem ipsum dolor sit amet, consectetur adipiscing elit.3つの要素の中で、私はさまざまなことを中断します。Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat.Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet.Nunc ut sem vitae risus tristique posuere.

Missions

脆弱性を根源から削減する

Secure Code Warrior Learning réduit les vulnérabilités récurrentes, renforce les habitudes de codage sécurisé et démontre des améliorations mesurables pour les développeurs. Ces résultats démontrent l'impact mesurable de la formation au codage sécurisé des entreprises à grande échelle dans les environnements de développement modernes.

il est temps de remédier

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

AIガバナンスチーム向けに特別に設計された

Démontrez des compétences mesurables des développeurs et réduisez les risques logiciels dans le cadre du développement humain et assisté par l'IA.

Le code sécurisé commence par des développeurs sécurisés

Renforcez les compétences en matière de codage sécurisé, réduisez les vulnérabilités introduites et renforcez la confiance des développeurs au sein de votre organisation.

Réduisez les vulnérabilités grâce à un apprentissage pratique et sécurisé du codage

Découvrez comment Secure Code Warrior améliore les compétences des développeurs en matière de sécurité, réduit les vulnérabilités et réduit les risques de manière mesurable.