La IA puede escribir código, pero la habilidad lo asegura.

Nuestra plataforma de codificación segura empresarial desarrolla las habilidades necesarias para proteger el código generado tanto por humanos como por IA sin ralentizar la entrega.

La IA acelera el código. Las habilidades de codificación segura deben seguir el ritmo.

Los asistentes de codificación de IA pueden generar código listo para la producción en cuestión de segundos. Sin embargo, la velocidad no es sinónimo de seguridad.

La formación tradicional en seguridad se centra en — no capacidad. El análisis estático detecta los problemas una vez que se presentan. Reducir el riesgo del software requiere mejorar el comportamiento de codificación segura La capacidad de codificación segura es la base de una gobernanza eficaz del software de IA.

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

Desarrolle competencias de codificación segura a escala

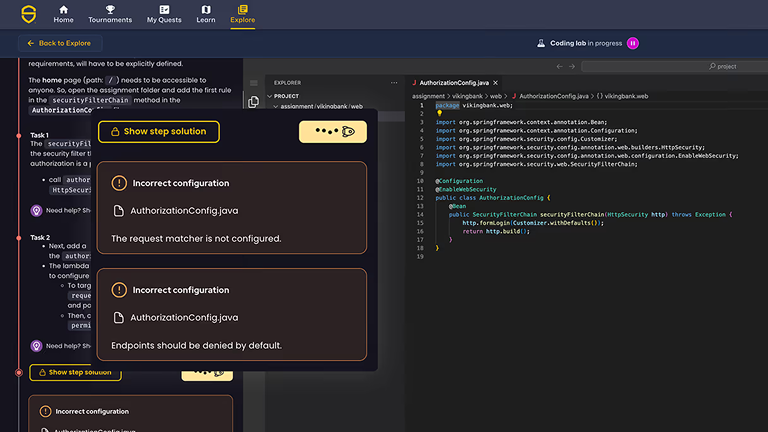

Laboratorios de codificación seguros y prácticos

Los desarrolladores resuelven las vulnerabilidades reales mediante ejercicios interactivos en más de 75 lenguajes y marcos.

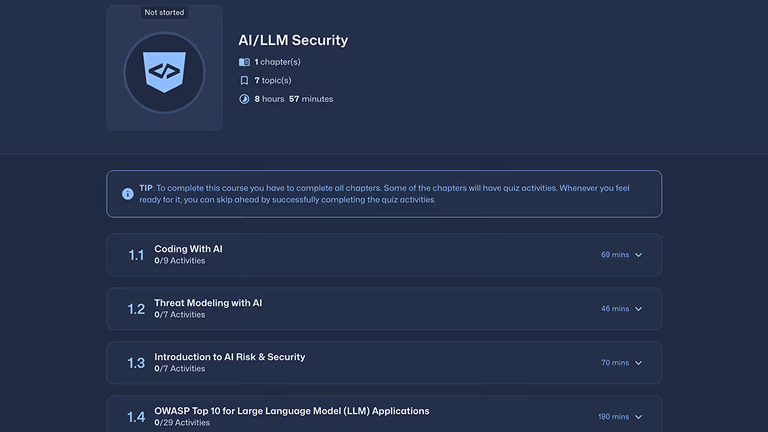

Módulos de seguridad específicos para IA

Valide y proteja el código generado por IA, detecte patrones inseguros y aplique estándares seguros en los flujos de trabajo asistidos por IA.

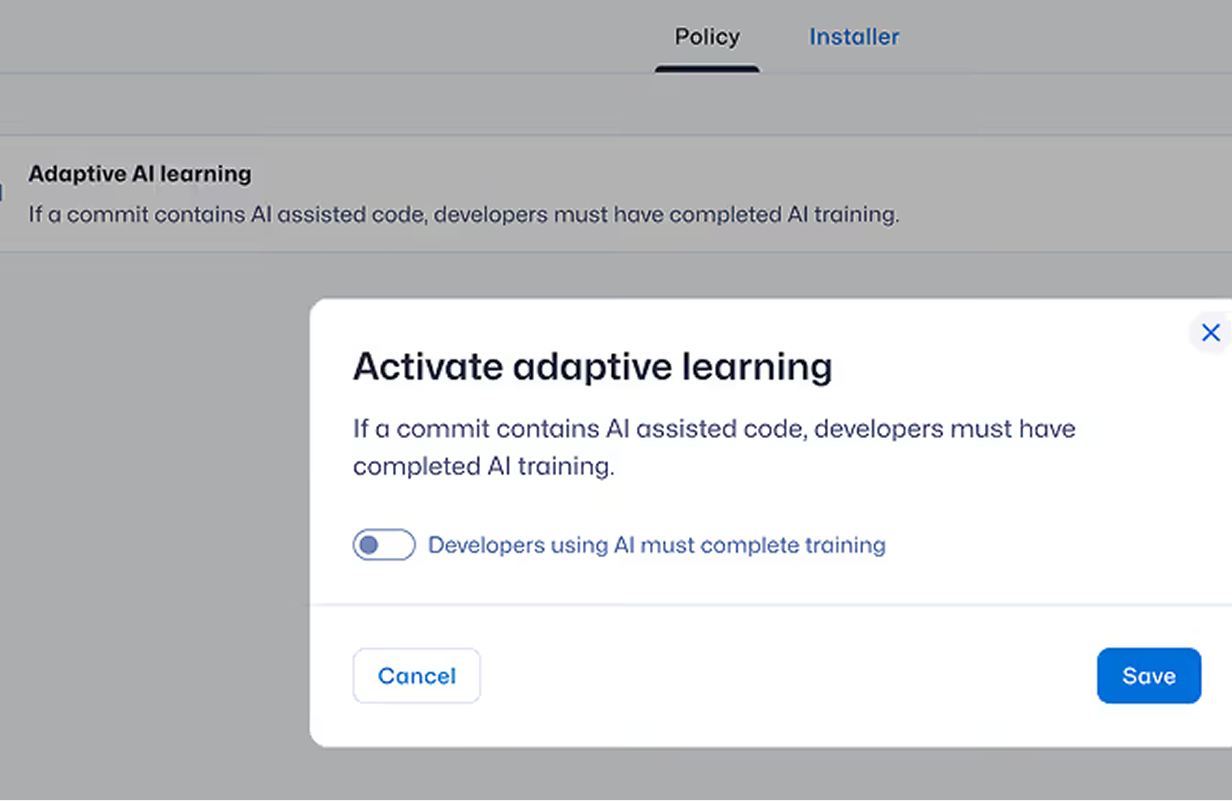

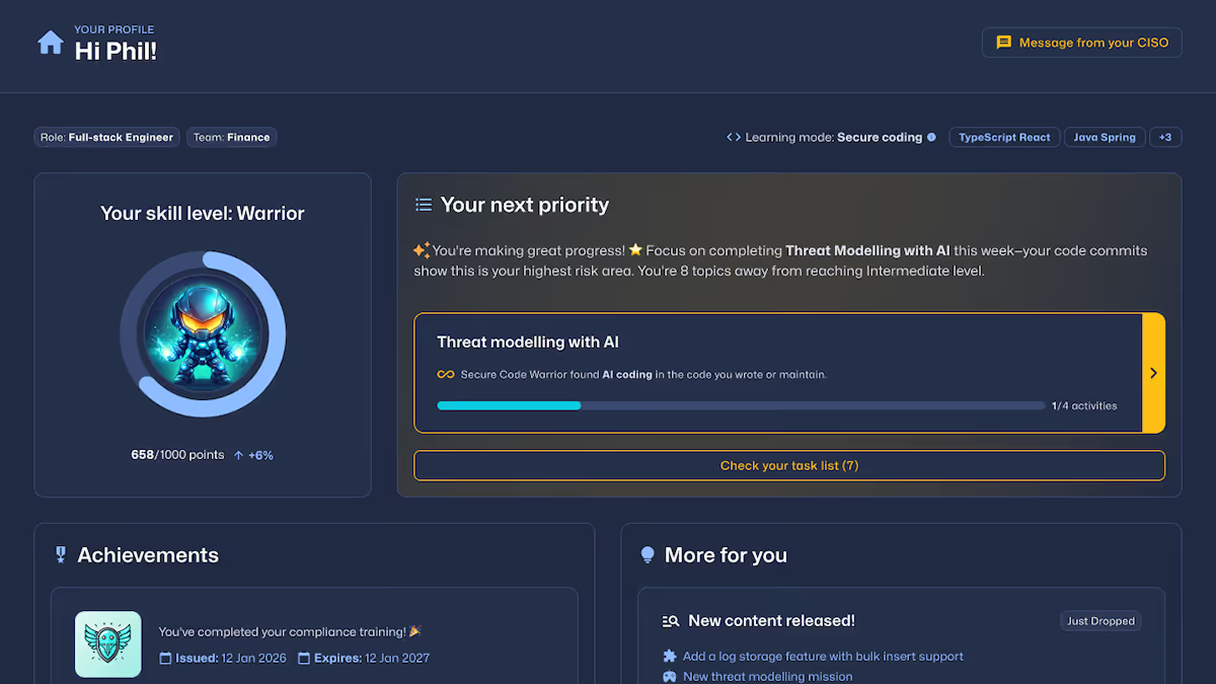

Rutas de aprendizaje adaptativo

Asigne automáticamente una formación específica en función del comportamiento de los desarrolladores, confirme las señales de riesgo o compare las brechas.

Mide el progreso

Evalúe la competencia de los desarrolladores, compárelos con los de sus pares y realice un seguimiento del progreso medible de la codificación segura con SCW Trust Score®.

達成する

Alinee la capacitación con los 10 principales de OWASP, NIST, PCI DSS, CRA y NIS2 con informes listos para la auditoría.

AI駆動型開発のための管理計画

AI駆動の開発を可視化、安全かつ強靭なものにし、本番環境導入前の脆弱性を回避することで、チームが迅速かつ自信を持って前進できるようにします。

クエスト

コーディング・ラボ

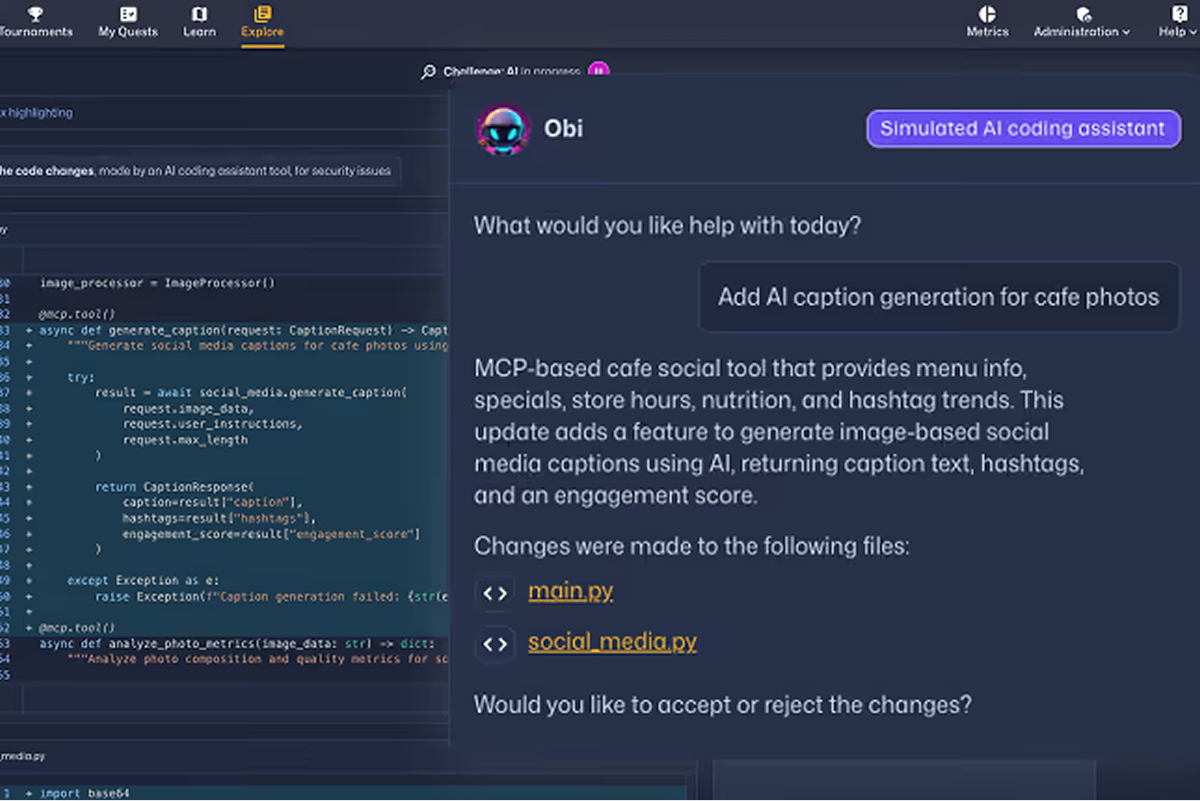

AIへの挑戦

Lorem ipsum dolor sit amet, consectetur adipiscing elit.3つの要素の中で、私はさまざまなことを中断します。Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat.Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet.Nunc ut sem vitae risus tristique posuere.

Missions

脆弱性を根源から削減する

Secure Code Warrior Learning reduce las vulnerabilidades recurrentes, refuerza los hábitos de codificación segura y demuestra una mejora apreciable para los desarrolladores. Estos resultados demuestran el impacto cuantificable de la formación empresarial en codificación segura a gran escala en los entornos de desarrollo modernos.

hora de remediar

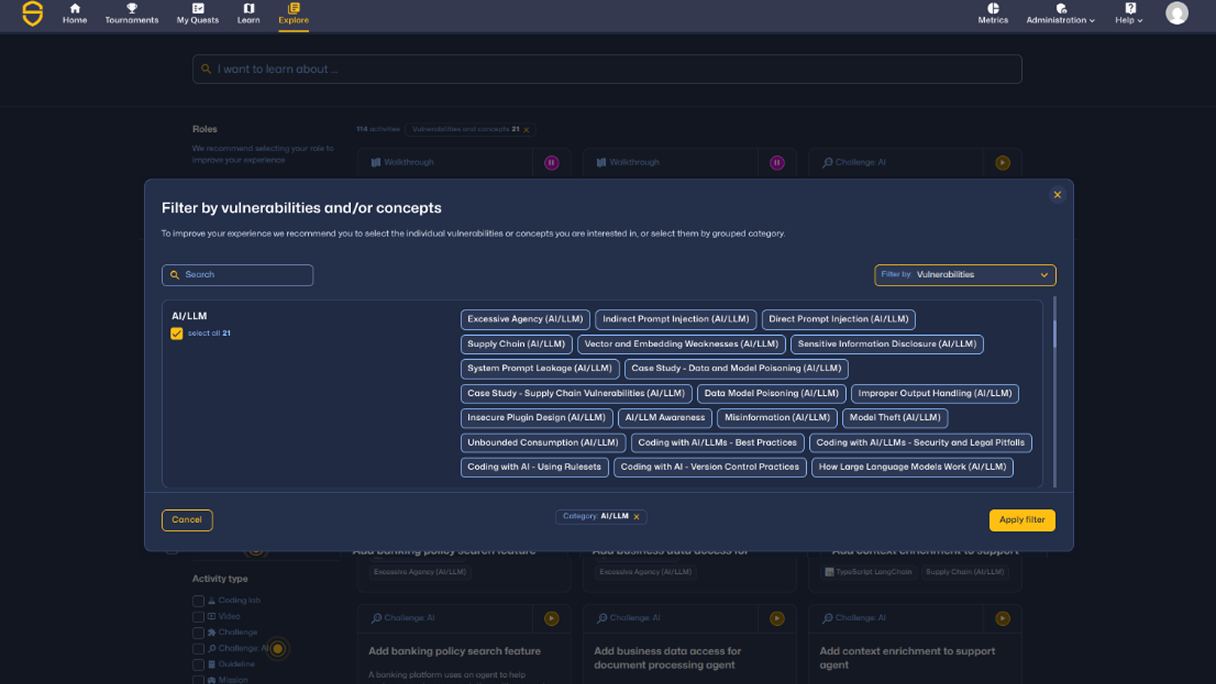

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

人工知能(AI)のガバナンスチーム向けに特別に設計された

Demuestre una competencia medible como desarrollador y reduzca el riesgo de software en el desarrollo asistido por humanos y por IA.

El código seguro comienza con desarrolladores seguros

Refuerce las habilidades de codificación segura, reduzca las vulnerabilidades introducidas y genere una confianza medible entre los desarrolladores en toda su organización.

Reduzca las vulnerabilidades con un aprendizaje práctico de codificación seguro

Descubra cómo Secure Code Warrior mejora las habilidades de seguridad de los desarrolladores, reduce las vulnerabilidades y ofrece una reducción de riesgos mensurable.