信頼できるエージェント:AIはAI使用のシグナルを捕捉し、メタデータ(ソースコードや指示ではなく)を確認します。これにより開発者のプライバシーを保護しつつ、大規模なガバナンスを実現します。AI支援開発を監査可能かつ安全なSDLCを通じて管理し、本番環境移行前の開発者リスクを管理します。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

Trust Agent: AIはコード作成の段階でAIサイバーセキュリティガバナンスを実現します。

AIコーディングアシスタント、LLM API、CLIエージェント、MCP接続ツールは、今や日常的に本番コードに影響を与えています。開発速度が加速したことで、ソフトウェアライフサイクル全体に新たなガバナンス上の複雑さが生じています。

AI支援開発をセキュアなSDLC全体で可視化・監査可能・管理可能にし、コードが本番環境に到達する前に開発者リスクを特定・低減する支援を行います。

従来のアプリケーションセキュリティツールは、コード記述後に脆弱性を検出します。Trust Agentは、AIモデルの制約と安全なコーディングポリシーをコミット時に適用し、脆弱性が本番環境に導入される前に防止します。

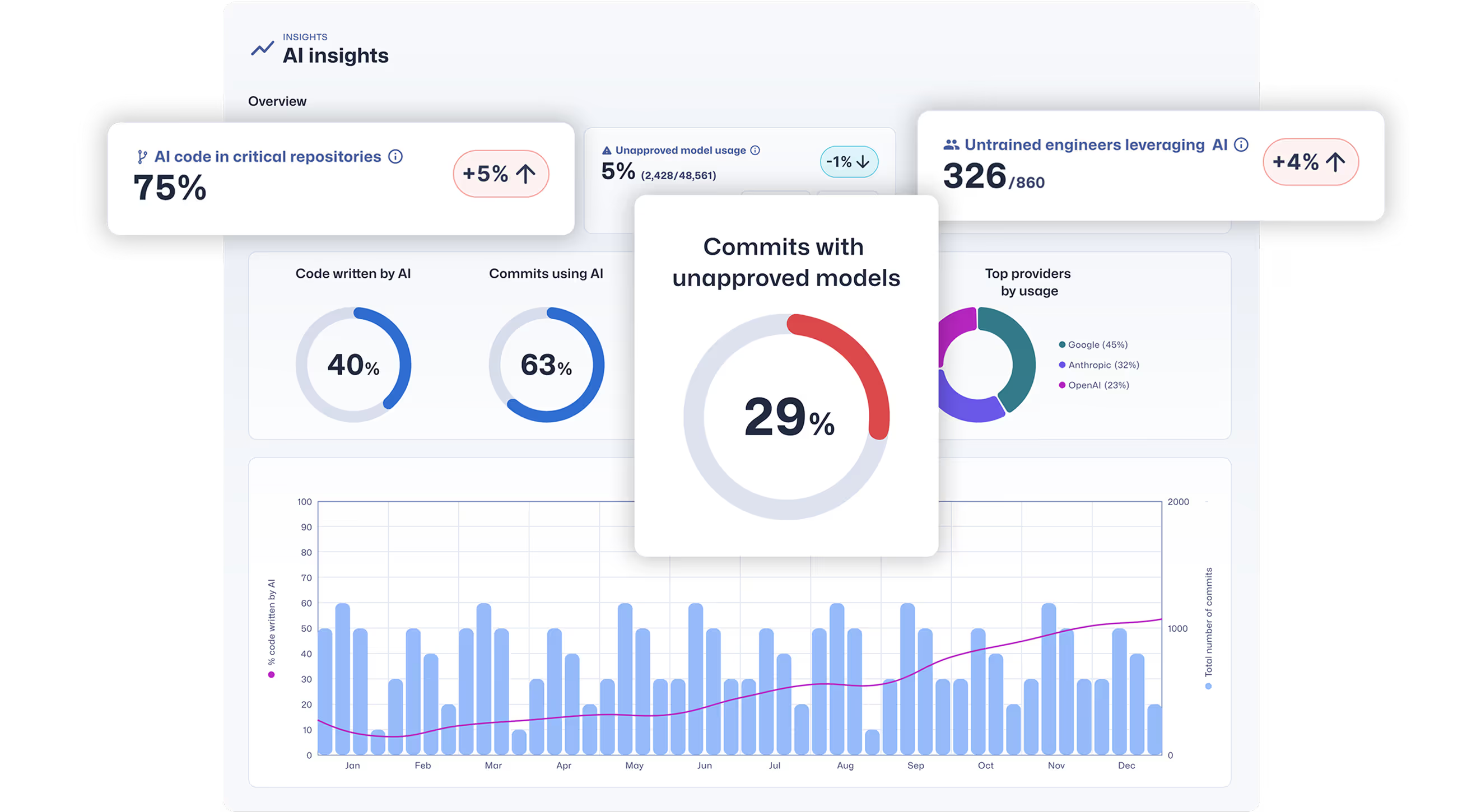

開発者のワークフローにおけるAIツールやモデルの可観測な使用状況を捕捉し、リポジトリ、協力者、ガバナンス体制との関連性を分析します。発見とインテリジェンス

SurfaceはMCPプロバイダー、影響を受けたユーザー、リポジトリへのエクスポージャーを積極的に活用し、AIツールのサプライチェーンにおけるガバナンス基盤を確立した。

AI使用の兆候を相関分析し、メタデータ、開発者のTrust Score®、脆弱性のベンチマークを確認することで、コードが本番環境に到達する前に高いリスクを特定します。

リスクベースの特定学習を促進し、AIの影響と開発者のTrust Score®を考慮することで、再発する脆弱性を低減します。

AIの利用動向、MCPの可視性、導入された脆弱性メトリクスを反映した、実行可能なパネルを提供します。ソースコードや指示を保存することはありません。

Trust Agent: AIはAI支援型モダン開発ワークフローに統合され、エコシステム全体において既存ツールと新興ツールの双方をサポートします。

対応環境には以下が含まれます:

Trust Agent: AIは主要なLLMプロバイダーと互換性があり、以下を含みます:

信頼できるエージェント:AIはAI導入に伴うリスクを低減し、コミットメントレベルでの責任を強化し、AI支援開発全体に適用可能なガバナンスを提供します。AIガバナンスを変革し、静的なポリシーから測定可能なコミットメントレベルの制御へと移行させ、AI導入を証拠に基づく安全性の成果へと転換します。

Trust Agent: AIが、AI支援開発全体における可視性、相関性、ポリシー制御をどのように実現するかをご覧ください。

Trust Agent: AIが、安全なSDLC全体においてAI支援開発を可視化、測定可能、適用可能にする方法をご覧ください。