人工知能はソフトウェアのサプライチェーンを拡大した

AIコーディングアシスタント、LLM、MCPに接続されたエージェントは、すべてのリポジトリで本番コードを生成するようになりました。開発速度は加速しましたが、ガバナンスはそれに追いついていません。AIはソフトウェア供給チェーンにおいて制御不能な要因となりつつあります。

ほとんどの組織は明確に回答できない:

- どのAIモデルが特定の確認を生成したか

- もしそれらのモデルが一貫して確実な結果を生成するなら

- どのMCPサーバーがアクティブで、何にアクセスしているか

- AI支援による確認が安全なコーディング基準を満たす場合

- AIの使用がソフトウェアの全体的なリスクに与える影響

Sin una gobernanza estructurada del software de IA, las organizaciones se enfrentan a una propiedad fragmentada, una visibilidad limitada y exposición creciente. El desarrollo asistido por IA aumenta la velocidad del código, pero sin una supervisión exigible, también aumenta el riesgo de vulnerabilidad introducido y la exposición de la cadena de suministro del modelo.

要求されるAI駆動開発の監視

組織が以下を可能にします:

- AIがどこでどのように使用されているかを可視化する

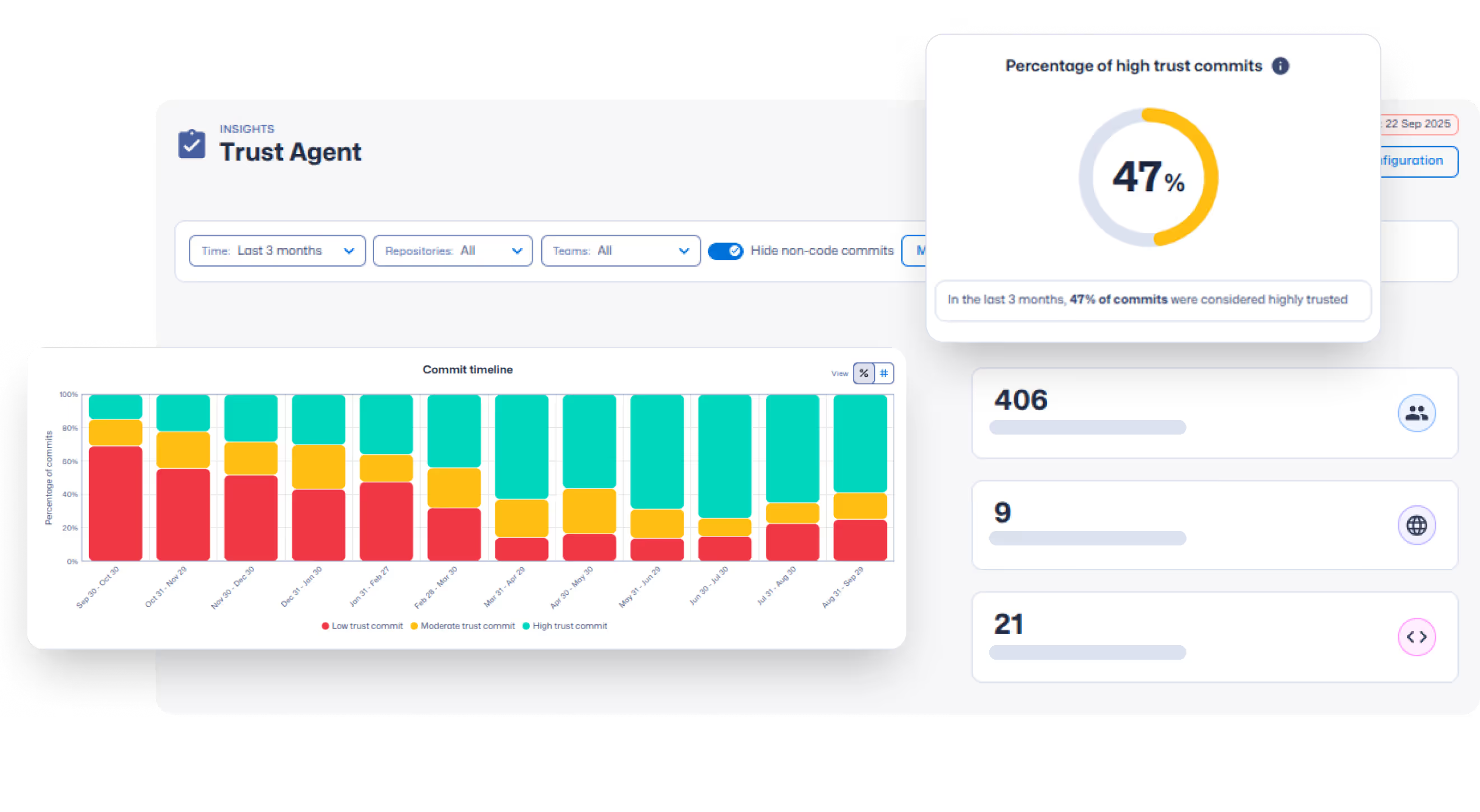

- AI支援型認証とソフトウェアリスクの相関関係

- AI利用ポリシーを定義し、確認時に適用する

- 人間開発とAI支援における説明責任の強化

Controle el ciclo de vida del software de IA

Las herramientas de seguridad de aplicaciones tradicionales detectan las vulnerabilidades después de escribir el código. La gobernanza del software de IA aplica las políticas, valida el uso de los modelos de IA y correlaciona el riesgo en el momento de la confirmación, lo que evita que se introduzcan vulnerabilidades antes de que lleguen a la fase de producción.

AIモデルおよびツールのトレーサビリティ

Obtenga visibilidad sobre qué herramientas y modelos de IA influyen en el código en todos los repositorios, creando un inventario verificable del uso de la IA.

Detección de IA en sombras

Identifique herramientas y modelos de IA no autorizados que operan fuera de los controles de gobierno aprobados.

LLMの安全性比較評価

Get real-world AI performance metrics to guide approved model usage.

リスク評価とコミットメントレベルにおけるガバナンス

Correlacione las confirmaciones asistidas por IA con las señales de riesgo y aplique políticas aplicables antes de que el código llegue a la fase de producción.

Visibilidad del servidor MCP

Identifique los servidores MCP en uso y aplique la política de nivel de confirmación para las conexiones no aprobadas.

発見と知性:開発者向け

Identifique continuamente a los desarrolladores, la actividad asistida por la IA y los patrones de compromiso para fortalecer la responsabilidad y la visibilidad de los riesgos.

AI支援開発を4つのステップで管理

接続してご覧ください

Intégralo con repositorios y sistemas de CI para monitorear los metadatos de confirmación, el uso del modelo de IA y la actividad de los colaboradores.

Audiencias a las que servimos

Diseñado para los líderes responsables de garantizar el desarrollo de software a medida que la IA se convierte en un contribuyente fundamental del código de producción.

AI駆動の開発をリリース前に管理する

Rastrea el uso del modelo de IA. Haga cumplir la política en el momento de la confirmación. Mantenga un control de su cadena de suministro de software de IA preparado para la auditoría.

Controle, mida y asegure el desarrollo de software asistido por IA

Descubra cómo Secure Code Warrior proporciona la observabilidad, la aplicación de políticas y la gobernanza de la IA en todos los flujos de trabajo de desarrollo asistidos por IA.