AIはソフトウェアのサプライチェーンを拡大しました

AIコーディングアシスタント、大規模言語モデル(LLM)、MCP接続エージェントは、SDLC全体で本番コードを生成するようになりました。開発速度は加速していますが、ガバナンスは追いついていません。AIはソフトウェア供給チェーンにおいて、管理されていない貢献者となっています。

ほとんどの組織は明確に答えられない:

- どのAIモデルが特定のコミットを生成したか

- それらのモデルが一貫して安全なコードを生成するかどうか

- どのMCPサーバーがアクティブで、それらにアクセスしているか

- AI支援によるコミットがセキュアコーディング基準を満たすかどうか

- AIの利用がソフトウェア全体のリスクに与える影響

構造化されたAIソフトウェアガバナンスがなければ、組織は所有権の断片化、可視性の制限、そして増大するリスクに直面します。

AI支援開発はコード作成速度を向上させますが、強制力のある監視がなければ、導入される脆弱性リスクとモデルのサプライチェーンリスクも増加させます。

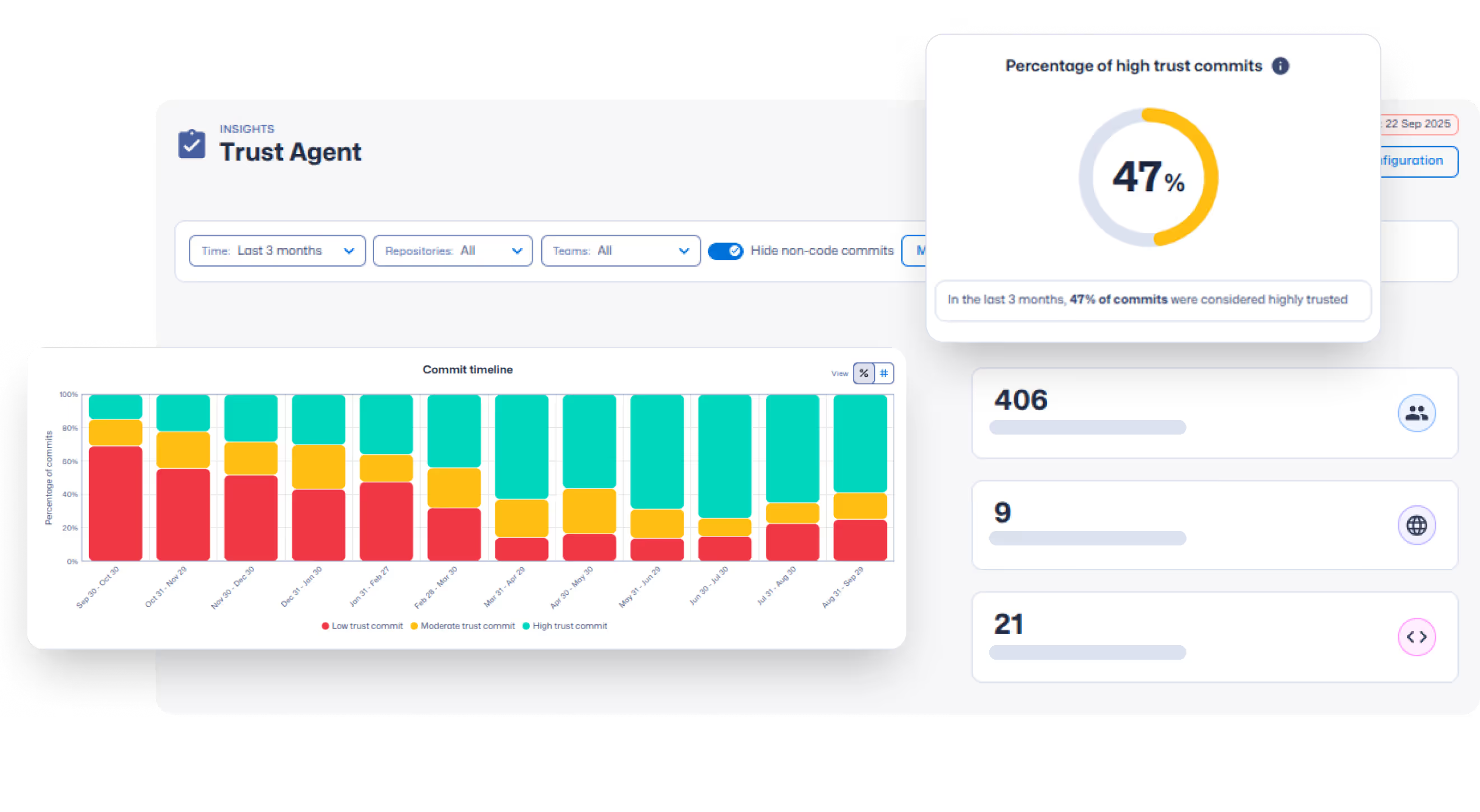

AI駆動型開発の監督

AIソフトウェアガバナンスは、AI生成コードの可視化を実現し、コミットレベルのリスクを相関分析し、AI駆動開発をセキュリティポリシーに整合させます。ソフトウェア開発ライフサイクル全体において、AI利用状況の可視化、リスクインテリジェンス、開発者能力の洞察を結びつけます。

これにより組織は以下が可能となります:

- AIがコード生成にどのように、どこで使用されているかを可視化する

- AI支援によるコミットとソフトウェアリスクを関連付ける

- AI利用方針とガバナンス基準を定義する

- 人間とAIが生成したコード全体に責任体制を構築する

AI駆動型ソフトウェア開発を管理し、安全に拡張する

従来のアプリケーションセキュリティツールは、コードが記述された後に脆弱性を検出します。AIソフトウェアガバナンスは、AIモデルの使用状況を可視化し、コミット時のリスクシグナルを相関分析し、組織が開発をセキュアコーディングポリシーに整合させることを支援します。

AIツールおよびモデルのトレーサビリティ

どのAIツールがコードに貢献しているかを可視化し、検証可能なAI SBOMを作成します。

シャドウAI検知

承認されたガバナンス方針の枠外で動作する非認可のAIツールを特定する。

LLMセキュリティベンチマーキング

承認済みモデルの活用を導くため、実世界のAIパフォーマンス指標を取得する。

リスクスコアリング

AI支援によるコミットをリスクシグナルと関連付け、脆弱性を低減するための的を絞った学習をトリガーする。

MCPサーバーの可視性

モデルコンテキストプロトコルサーバーを特定し、AIエージェントが内部システムとどのように相互作用するかを理解する。

開発者発見

開発者とコミットパターンを継続的に特定し、説明責任とリスク可視性を強化する。

AIガバナンスチーム向けに特別に設計された

AIが生産コードの中核的貢献者となる中、ソフトウェア開発の安全確保を担うリーダー向けに設計されています。

AI駆動開発をリリース前に管理する

AIツールがコードを生成する箇所を確認し、コミットとリスクシグナルを関連付け、AIソフトウェアサプライチェーン全体を見通せる状態を維持します。

AI支援ソフトウェア開発の制御、測定、および保護

Secure Code Warrior 、AI支援開発ワークフロー全体でAIの可観測性、ポリシー適用、ガバナンスをどのようにSecure Code Warrior をご覧ください。