AIソフトウェアのリスクを未然に防ぐ

コミットごとに安全で高品質なコードを確実に提供します。誰が(あるいは何が)書いたものであっても。

.svg)

.svg)

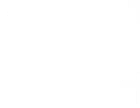

AI駆動開発のための制御面

AI駆動の開発を可視化し、安全かつ強靭に——本番環境導入前の脆弱性を防止し、チームが自信を持って迅速に動けるようにする。

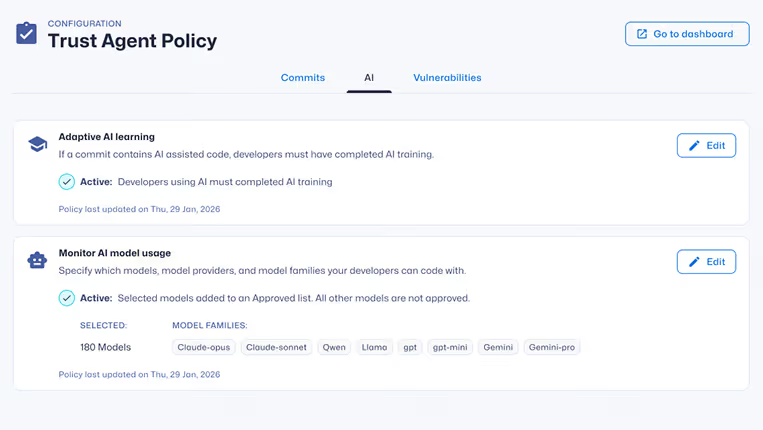

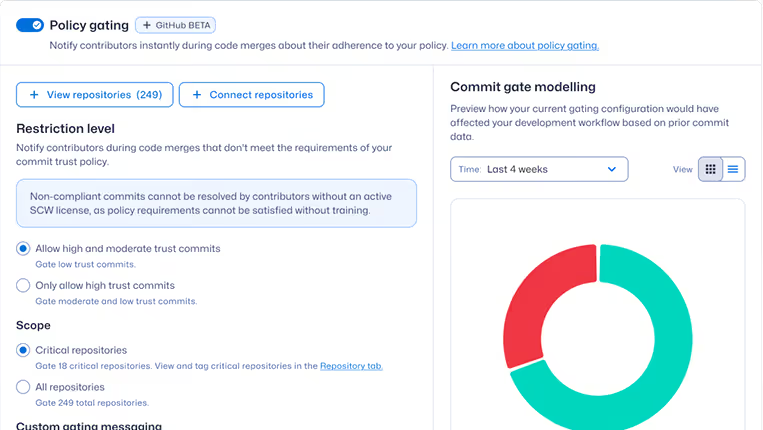

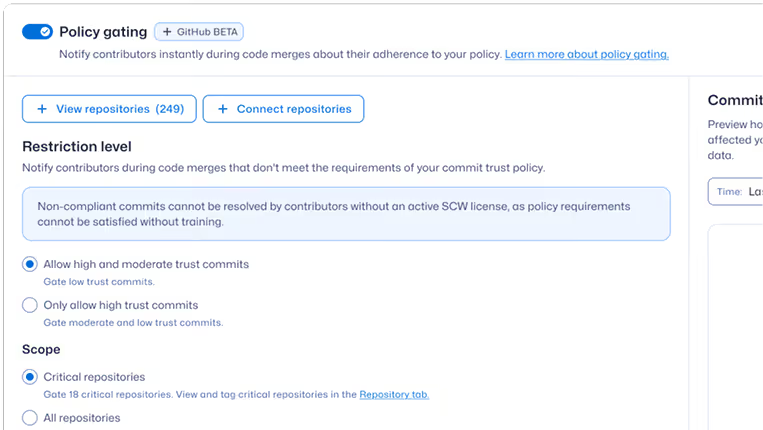

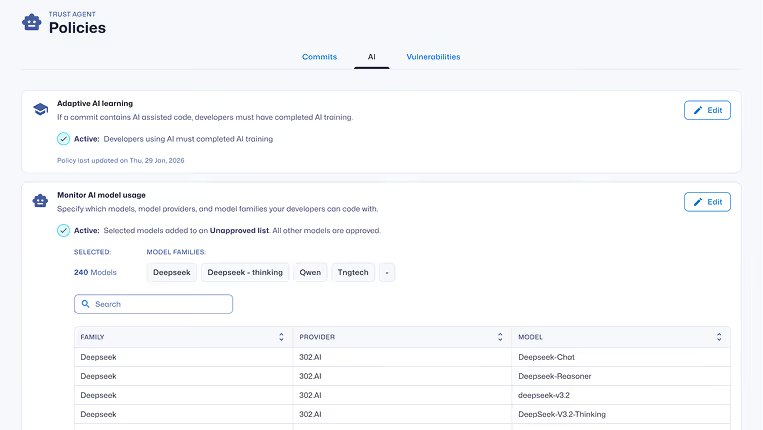

ソフトウェア開発全体でAIガバナンスを運用化する。

セキュリティ監視を維持しながらAI支援開発を可能にします。AI使用状況の可視化を実現し、コミット時にガバナンスワークフローを適用し、開発慣行を企業のリスク許容度と整合させます。

AIソフトウェア開発を安全に拡張する

- AI支援開発における全社的な可視性を獲得する

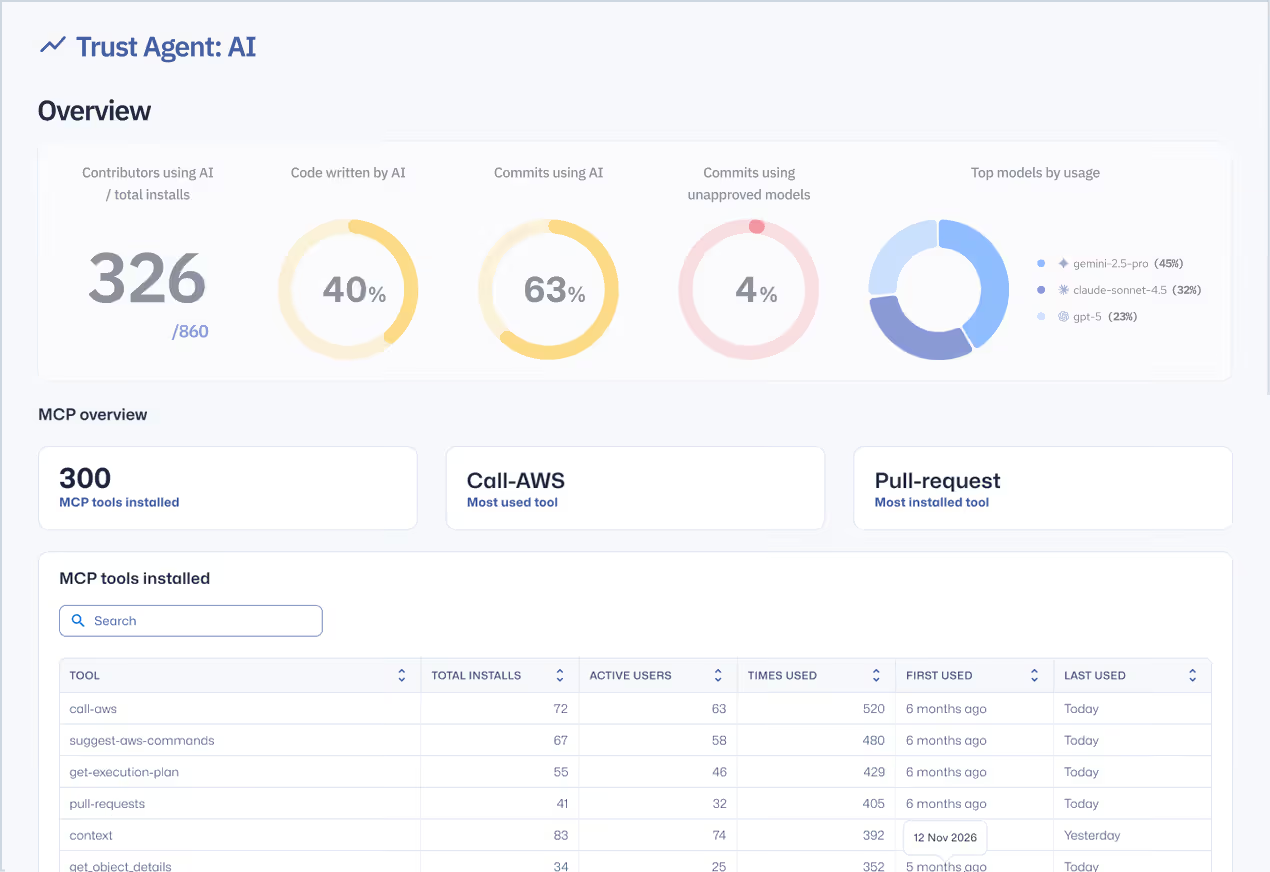

- エンジニアリングチーム全体でセキュアコーディング能力を強化する

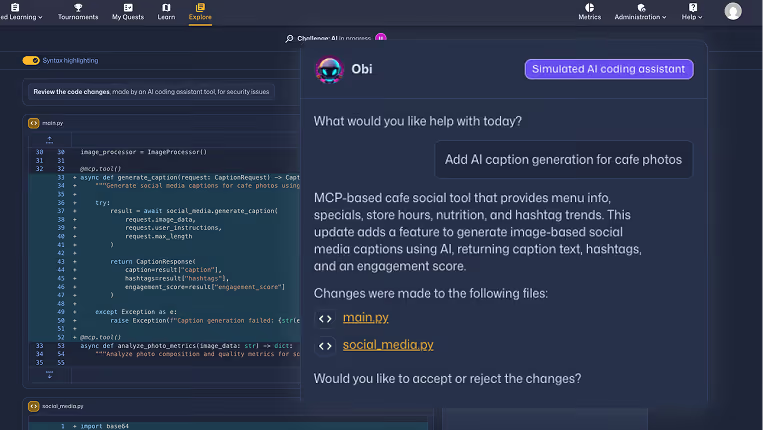

- 開発者を訓練し、AIが生成したコードを安全にレビューできるようにする

コミット時にAI導入による脆弱性を防止する。

AIの使用状況を可視化し、コミット時にセキュアコーディングのガードレールを適用し、AI支援開発をセキュリティ基準に整合させることで、人間とAIが生成したコード全体にわたる脆弱性を防止する。

導入された脆弱性を53%以上削減

- 開発チーム全体でセキュアコーディング能力を構築する

- ポリシーに沿ったガイダンスを開発者ツール内で直接提供

- AI生成コードがソフトウェアリスクに与える影響を確認する

AI開発を拡大しながら、提供速度を落とさない。

AI支援開発を安全かつ測定可能に——手戻りを削減し、セキュリティレビューのボトルネックを回避し、チームが自信を持って迅速にリリースできるようにします。

平均復旧時間(MTTR)を最大82%短縮

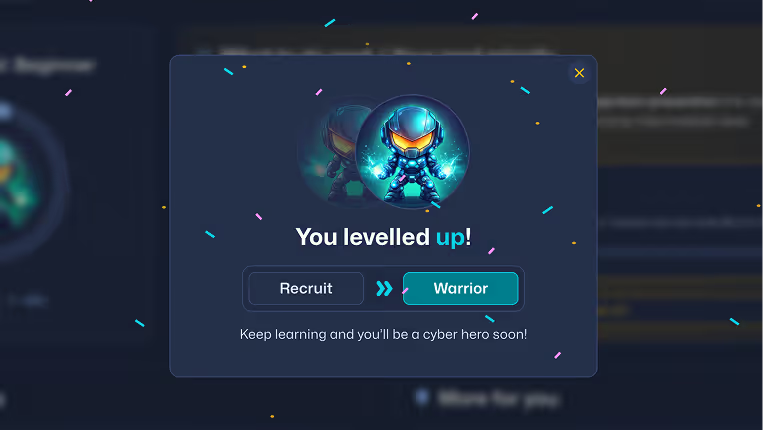

- 適応型学習で開発者のセキュリティスキルを向上させる

- 開発者ツール内でリアルタイムガイダンスを提供

- 脆弱性を早期に修正し、手戻りのコストを削減する

既存のツールに合わせて構築された、安全な環境

AI駆動型開発のリスクを可視化する

AIコーディングの活用方法、それが生み出すリスク、そしてその背後にある行動原理を理解し、脆弱性が製品に組み込まれる前に阻止しましょう。

脆弱性を発生源で低減する

実践的なセキュアコーディングとAIセキュリティ学習を、実際の開発ワークフローで提供。組織の脆弱性を53%以上削減します。

Scale AI-driven development with confidence

Gain visibility into how AI contributes to your code, connect activity to real risk, and align development to enterprise standards — so you can reduce risk and prove trust before code reaches production.

AI駆動の開発を出荷前に管理する

開発リスクを把握し、ポリシーを適用し、ソフトウェア開発ライフサイクル全体で脆弱性を防止します。

始めるためのリソース

AIソフトウェアガバナンスを理解し、AI駆動型ソフトウェアリスクを低減する方法

AIソフトウェアガバナンスとは何か、その重要性、Secure Code Warrior 組織がAI支援開発を安全に導入Secure Code Warrior 学びましょう。

.png)