AIはソフトウェアのサプライチェーンを拡張します

AIコーディングアシスタント、LLM、MCP連携のエージェントが、リポジトリ内で本番コードを生成できるようになりました。開発速度は加速していますが、ガバナンスは追いついていません。AIはソフトウェアサプライチェーンにおいて制御不能な貢献者となっています。

ほとんどの組織は明確に答えられない:

- どのAIモデルが特定のコミットを生成したか

- これらのモデルは安全な出力を継続的に生成しているか

- どのMCPサーバーがアクティブ状態で、そのサーバーがアクセスしているコンテンツ

- 人工知能による補助提出は安全なコーディング基準に適合しているか

- 人工知能の使用はソフトウェアリスク全体にどのような影響を与えるか

構造化されたAIソフトウェアガバナンスがなければ、組織は所有権の分散、認知度の低さ、そして増大するリスクに直面する。AI支援開発はコード作成速度を向上させるが、強制的な監視がなければ、導入される脆弱性のリスクとモデルサプライチェーンのリスクも増加させる。

人工知能駆動型開発に対する強制的な監督

それは組織が以下を可能にします:

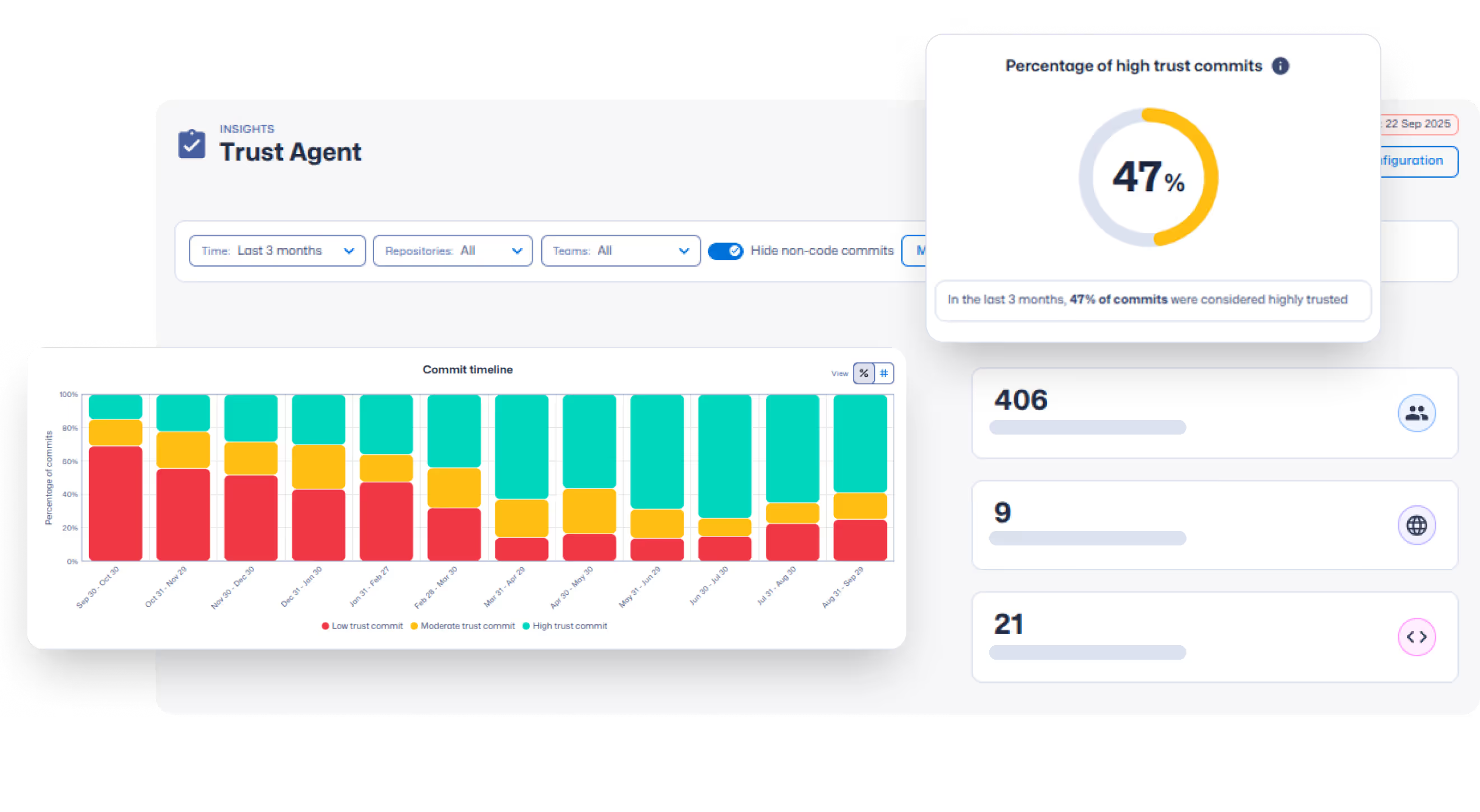

- 人工知能の使用場所と方法について深く理解する

- AIによる補助的提出とソフトウェアリスクの関連付け

- AI利用ポリシーの定義と実行を提出時に実施する

- 人間と人工知能による補助開発に対する説明責任の強化

管理 AI ソフトウェアのライフサイクル

従来のアプリケーションセキュリティツールは、コード作成後に脆弱性を検出します。AIソフトウェアガバナンスはポリシーを強制し、AIモデルの使用状況を検証し、リスクを関連付けます——脆弱性が本番環境に投入される前にこれを防ぎます。

AIツールとモデルのトレーサビリティ

リポジトリ内のコードに影響を与えるAIツールやモデルを把握し、検証可能なAI使用状況のリストを作成する。

影 AI 検出

承認されたガバナンス管理の範囲外で動作する不正なAIツールおよびモデルを識別する。

LLM セキュリティベンチマーク

実際の脆弱性パターンに基づいてAIモデルの性能を評価し、承認済みモデルの使用を強制する。

委員会レベルのリスク評価とガバナンス

AIによる自動提出をリスクシグナルと関連付け、コードが本番環境にデプロイされる前に実行可能なポリシーを適用する。

MCP サーバー可視性

使用中のMCPサーバーを識別し、承認されていない接続に対してコミットレベルのポリシーを適用する。

開発者発見と情報

開発者、人工知能支援活動、および提出パターンの継続的な識別により、説明責任とリスク可視性を強化する。

私たちのサービスの対象者

ロレム・イッスム・ディアム・クイ・エイム・レブティス・エイム・セレリスケ・ロボルティス・セピティス・ベエルリスケ・ロボルティス・セピティス・セレリスケ・ロボルティス・セレリスケ・フィメンティス・セレリスケ・フィメンティス・セレリスケ・ディアム

人工知能駆動の開発リリースを事前に管理する

AIモデルの使用状況を追跡する。提出時にポリシーを強制する。AIソフトウェアのサプライチェーンに対する監査対応可能な管理を維持する。

制御、計測、保護 AI 支援ソフトウェア開発

Secure Code Warrior AI 支援開発ワークフローにおいて、AI の可観測性、ポリシー実施、ガバナンスをSecure Code Warrior をご覧ください。