KIはお客様のソフトウェア供給網を拡大しました

KIコーディングアシスタント、LLM、MCP連携エージェントが、リポジトリ内で生産コードを生成するようになりました。開発速度は加速しましたが、経営陣は追いついていません。AIはソフトウェア供給チェーンにおける制御不能な要素となっています。

ほとんどの組織は、以下の質問に明確に答えられない:

- どのAIモデルが特定のコミットを生成したのか

- これらのモデルが一貫して安全な出力を提供するかどうか

- どのMCPサーバーがアクティブで、それらは何にアクセスしているのか

- AI支援型コミットが安全なコーディング基準を満たす

- AIの利用が一般的なソフトウェアリスクに与える影響

構造化されたAIソフトウェアガバナンスが欠如している場合、企業は所有権の断片化、可視性の制限、そして増大するリスクに直面します。AIを活用した開発はコード作成速度を向上させますが、強制力のある監督がなければ、セキュリティ上の脆弱性のリスクを高め、サプライチェーンをモデル化することにもなります。

AI主導の開発に対する強制力のある監視

組織が以下を実現することを可能にします:

- AIがどこでどのように活用されているかについて、概要を把握してください

- AIを活用したコミットをソフトウェアリスクと相関させる

- コミット時にAI利用ポリシーを定義し、適用する

- 人間とAIを活用した開発における説明責任の強化

AIソフトウェアのライフサイクルを管理する

従来のアプリケーションセキュリティツールは、コードが記述された後にセキュリティ上の脆弱性を検出します。AIソフトウェアガバナンスは、ポリシーを適用し、AIモデルの使用を検証し、移行時のリスクを相関させることで、導入された脆弱性が本番環境に到達する前に防止します。

AIツールおよびモデルの追跡可能性

すべてのリポジトリ内のコードに影響を与えるAIツールとモデルを把握し、AI利用状況の検証可能なインベントリを作成します。

影の中のKI検知

承認された管理メカニズムの外で動作する不正なAIツールおよびモデルを特定してください。

LLMセキュリティベンチマーク

AIモデルの性能を実際の脆弱性パターンに基づいて評価し、承認済みモデルを規定してください。

コミットレベルにおけるリスク評価と経営管理

AIを活用したコミットをリスクシグナルと相関分析し、コードが本番環境にデプロイされる前に強制可能なポリシーを適用します。

MCPサーバーの可視性

使用されているMCPサーバーを特定し、承認されていない接続に対してコミットレベルでのポリシーを適用してください。

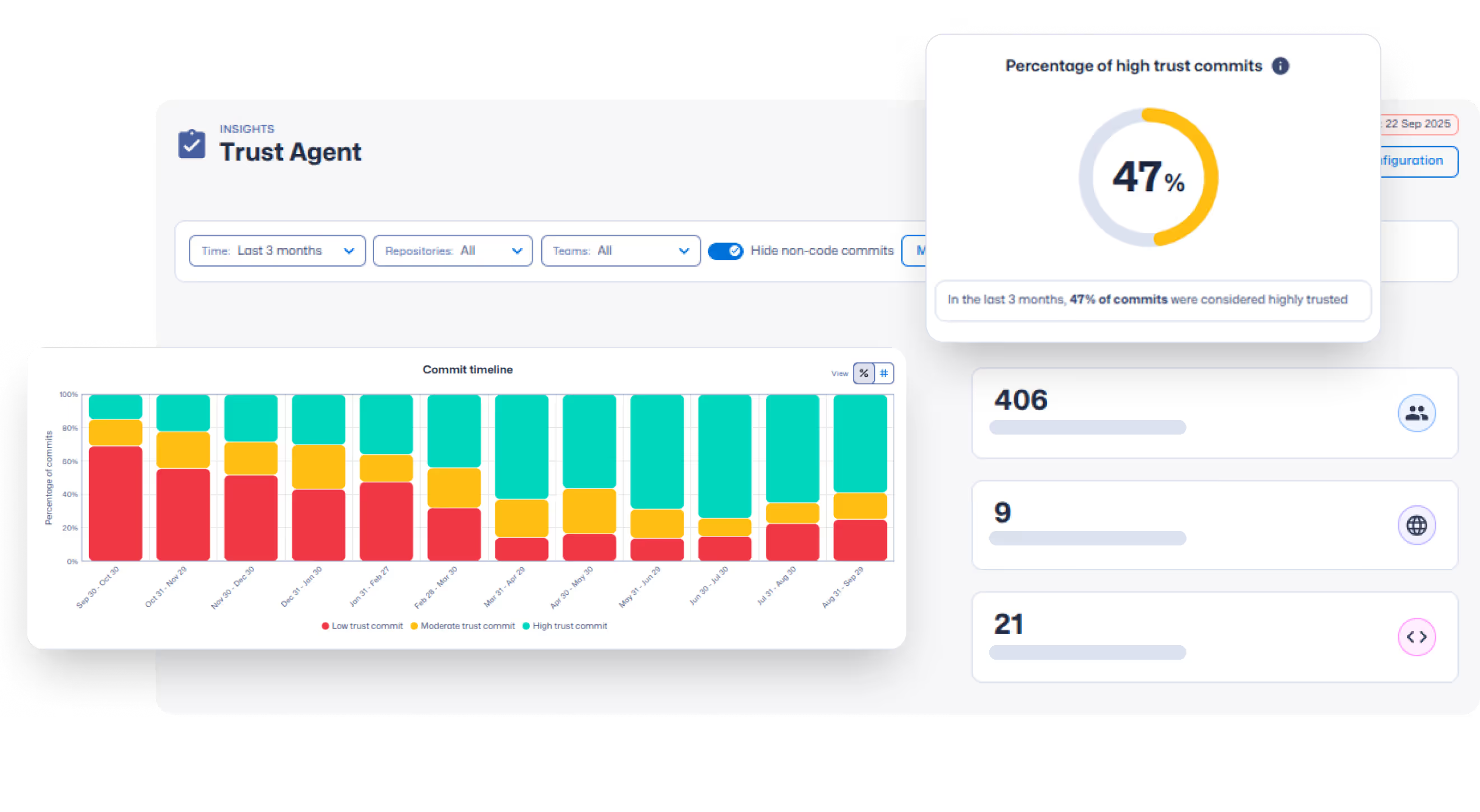

開発者ディスカバリー&インテリジェンス

開発者、AIを活用した活動、およびコミットパターンを継続的に特定し、説明責任とリスクの可視性を向上させます。

当社がサービスを提供する対象グループ

AIが生産コードへの重要な貢献要素となる中、ソフトウェア開発の安全確保を担う管理職向けに開発されました。

AI支援開発を、提供される前に制御してください

AIモデルの使用状況を追跡してください。コミット時にポリシーを適用してください。AIソフトウェアのサプライチェーンを監査可能な形で管理し続けてください。

KIを活用したソフトウェア開発の管理、測定、保証

Secure Code Warrior 開発ワークフローにおいてSecure Code Warrior 、ポリシー適用、制御をどのように実現するかをご覧ください。