人工知能はコードを書くことができるが、スキルはコードを守ることができる。

当社の企業向けセキュアコーディングプラットフォームは、人工知能生成コードと人間が作成したコードを保護するために必要なスキルを、デリバリー速度を低下させることなく育成します。

传统的安全培训侧重于 — 不是能力。静态扫描会在问题出现后检测到问题。 降低软件风险需要改善安全编码行为 安全编码能力是有效的人工智能软件治理的基础。

Build developer capability for secure AI development

Secure Code Warrior Learning provides AI security training that builds the skills behind every commit. Developers learn to secure AI-generated code through hands-on practice across real-world AI workflows, reducing risk at the source.

大規模な安全なコーディング能力の構築

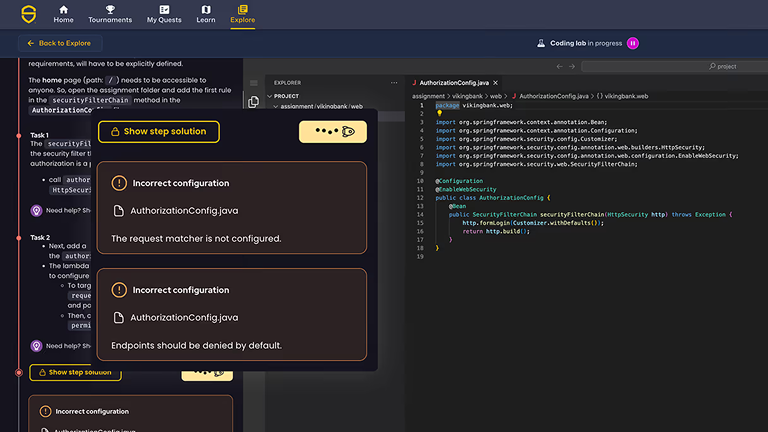

安全コーディング実践ラボ

開発者は75以上の言語とフレームワークを網羅したインタラクティブな演習を通じて、実際の脆弱性を解決します。

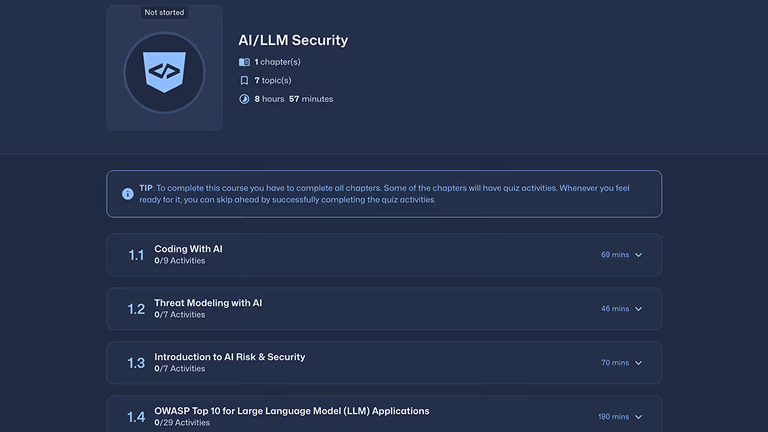

AI 専用のセキュリティモジュール

AIが生成したコードの検証と保護、安全でないパターンの検出、およびAI支援ワークフローにおけるセキュリティ基準の適用。

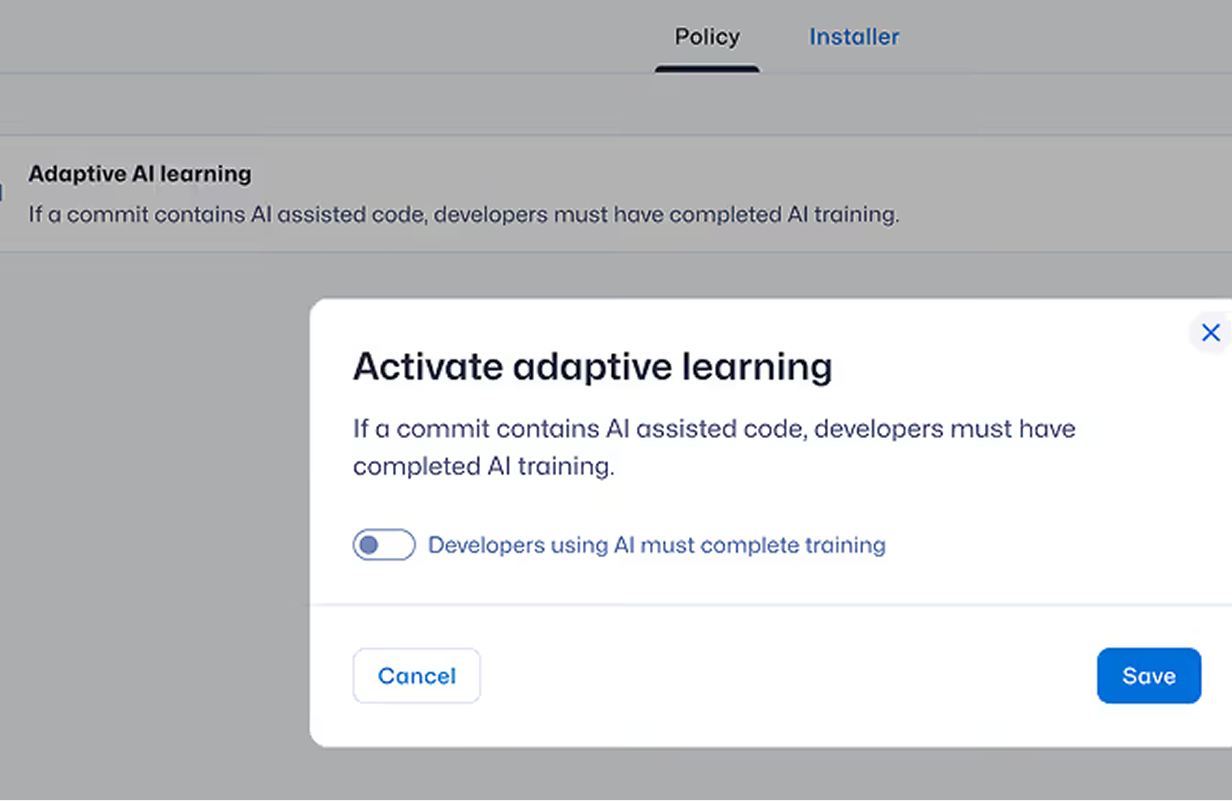

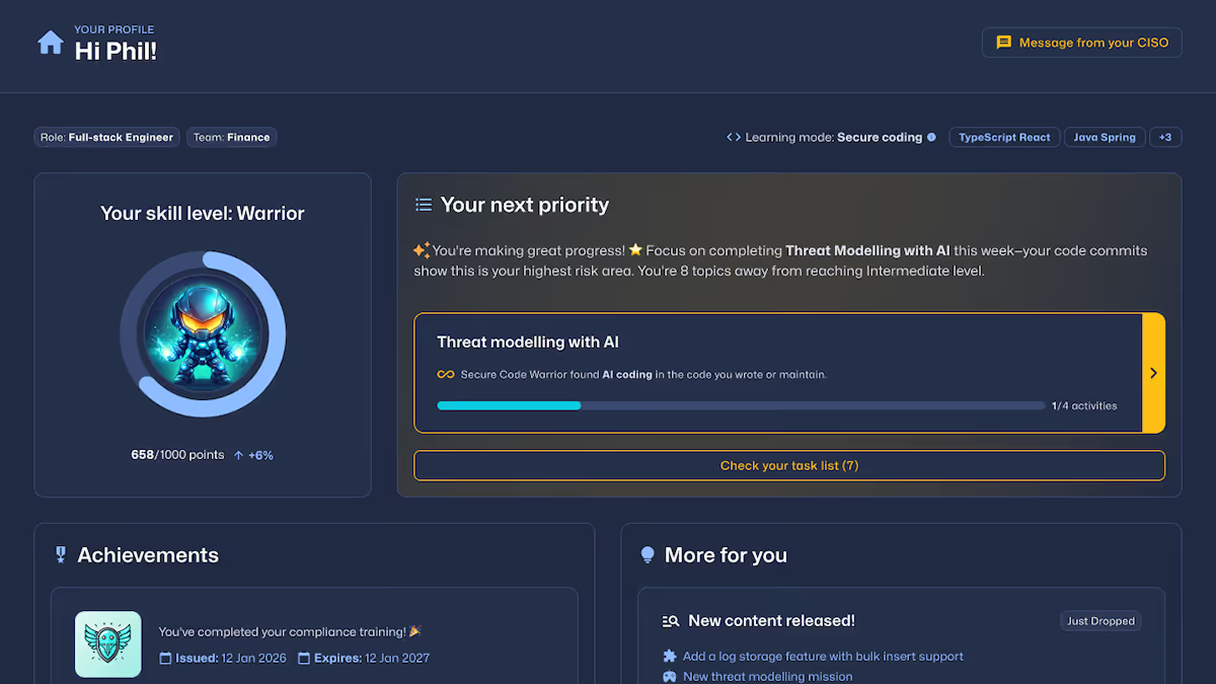

適応型学習パス

開発者の行動、提出されたリスクシグナル、またはベンチマークテストのギャップに基づいて、自動的にターゲットを絞ったトレーニングを割り当てます。

進捗を測る

SCW Trust Score®を使用して開発者の熟練度を評価し、同業者とのベンチマークテストを実施し、測定可能な安全なコーディングの進捗を追跡します。

コンプライアンスを実現する

トレーニングをOWASPトップ10、NIST、PCI DSS、CRA、NIS2と統合し、監査可能なレポートを提供します。

人工知能駆動開発の制御プレーン

人工知能駆動の開発を可視化、安全かつ弾力的にし、本番環境導入前に脆弱性を防止することで、チームは自信を持って迅速に行動できます。

クエスト

コーディング・ラボ

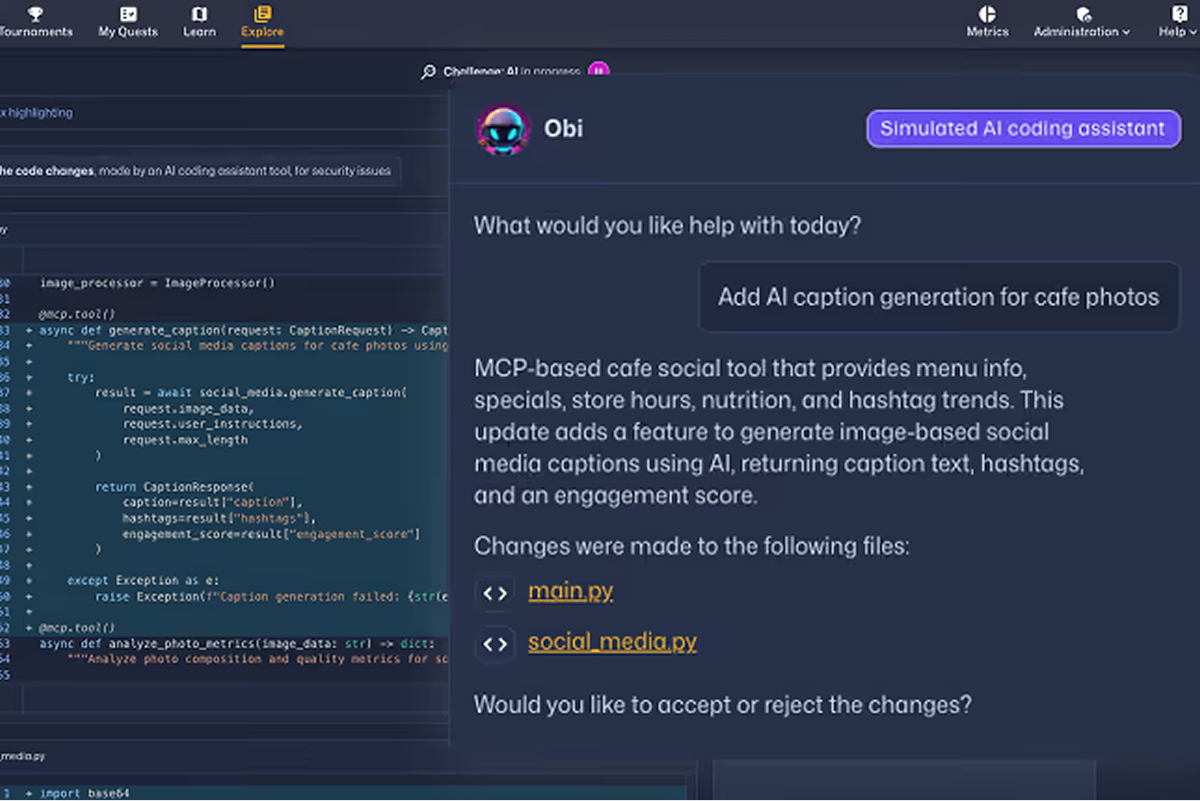

AIへの挑戦

Lorem ipsum dolor sit amet, consectetur adipiscing elit.3つの要素の中で、私はさまざまなことを中断します。Duis cursus, mi quis viverra ornare, eros dolor interdum nulla, ut commodo diam libero vitae erat.Aenean faucibus nibh et justo cursus id rutrum lorem imperdiet.Nunc ut sem vitae risus tristique posuere.

Missions

根本的な原因から脆弱性を減らす

Secure Code Warrior 、繰り返し発生する脆弱性を減らし、安全なコーディング習慣を強化し、測定可能な開発成果を示しました。これらの結果は、企業向け安全なコーディング研修が現代の開発環境において大規模に測定可能な影響をもたらしていることを示しています。

修正すべき時が来た

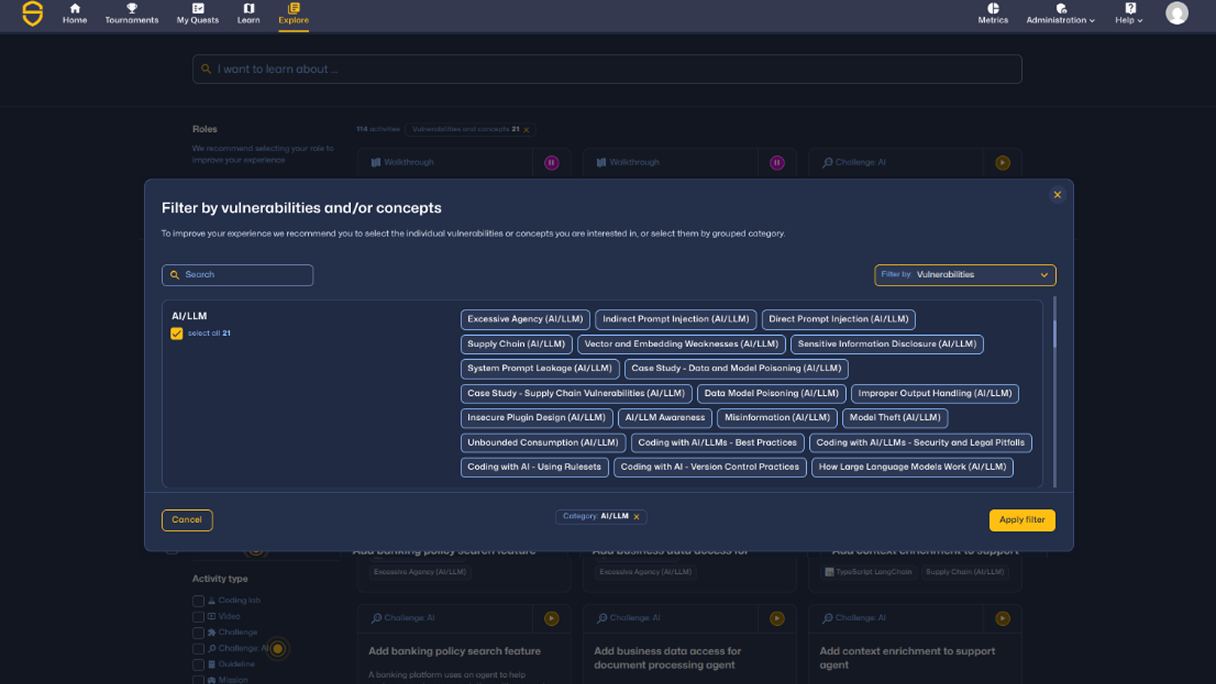

What developers learn in AI security training

Coverage spans LLM vulnerabilities, agent protocols, infrastructure security, and foundational AI security design — mapped to real developer workflows.

Practice real-world AI and LLM security risks.

AI security training teaches developers how to identify, prevent, and remediate vulnerabilities in AI-generated code and modern AI systems, including:

Build foundational AI security knowledge

Developers learn how to securely design and review AI systems through:

Secure AI agents, protocols, and cloud AI environments

Understand and mitigate risks across agent-based systems and AI infrastructure, including MCP and cloud AI services:

Secure AI services and model integrations

Model Context Protocol — Secure AI agents and protocol interactions

AIガバナンスチーム専用に設計

開発者の能力を測定可能に示し、人的および人工知能による補助開発におけるソフトウェアリスクを低減する。

安全コードは安全な開発者から始まる

セキュリティコーディングスキルを強化し、導入される脆弱性を減らし、組織全体で測定可能な開発者信頼を構築する。

実践的な安全なコーディング学習による脆弱性の削減

Secure Code Warrior 、脆弱性を減らし、測定可能なリスク低減を実現する方法を理解しましょう。