開発者の生産性を向上させましょう

開発者の生産性を向上させましょう

開発者の67%は、意図的に欠陥のあるコードをリリースしており、これにより時間の3分の1を無駄にしている。

AIの新世界における安全な開発に関するスキルアップ

Secure Code Warrior 、AIを活用した開発手法への移行をSecure Code Warrior 。高度に関連性の高いトレーニングプログラムを通じて、AIやLLM(大規模言語モデル)の取り扱いに関する認識不足から、AI生成コードの安全性への過度な信頼、さらにはAIコーディングに関連する新たなセキュリティリスクの発生に至るまでのギャップを埋めることを目的としています。

SDLCの多様な役割に向けたAI/LLMテーマの最高品質コンテンツを入手し、リスクを最小化しましょう。開発者やQAからアーキテクト、プロダクトマネージャーまで、あらゆるニーズに対応します。

次世代の安全なソフトウェア開発

AI+開発者が溢れる世界でリスクを軽減しましょう

コード行がより速く、より少ない管理下で生産されるにつれ、隠れたバグ、セキュリティホール、技術的負債のリスクが指数関数的に増加しています。この変化により、信頼性と安全性を犠牲にすることなく速度を確保するため、検証、テスト、安全なコーディングがこれまで以上に重要になっています。 開発者の継続的なスキル向上は、GitHub Copilot、Cursor AI、Amazon Q Developerなどのツールが活用される環境においてより良い成果を得るための第一歩であり、安全なコードの重要性を教育し続ける必要性を強調しています。

学習プラットフォームのコンテンツを探索してください

AIリスクを可観測性とガバナンスで管理する

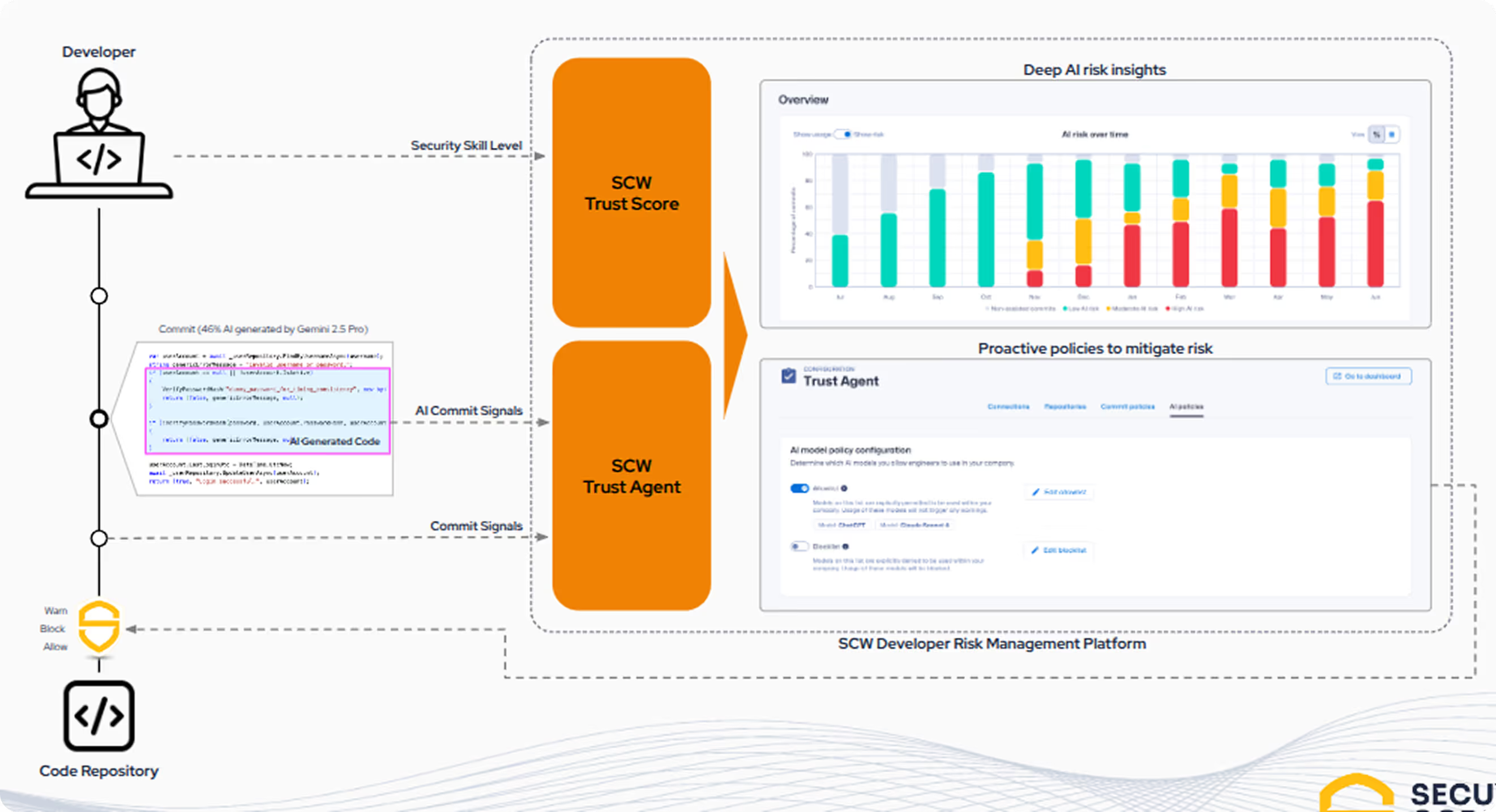

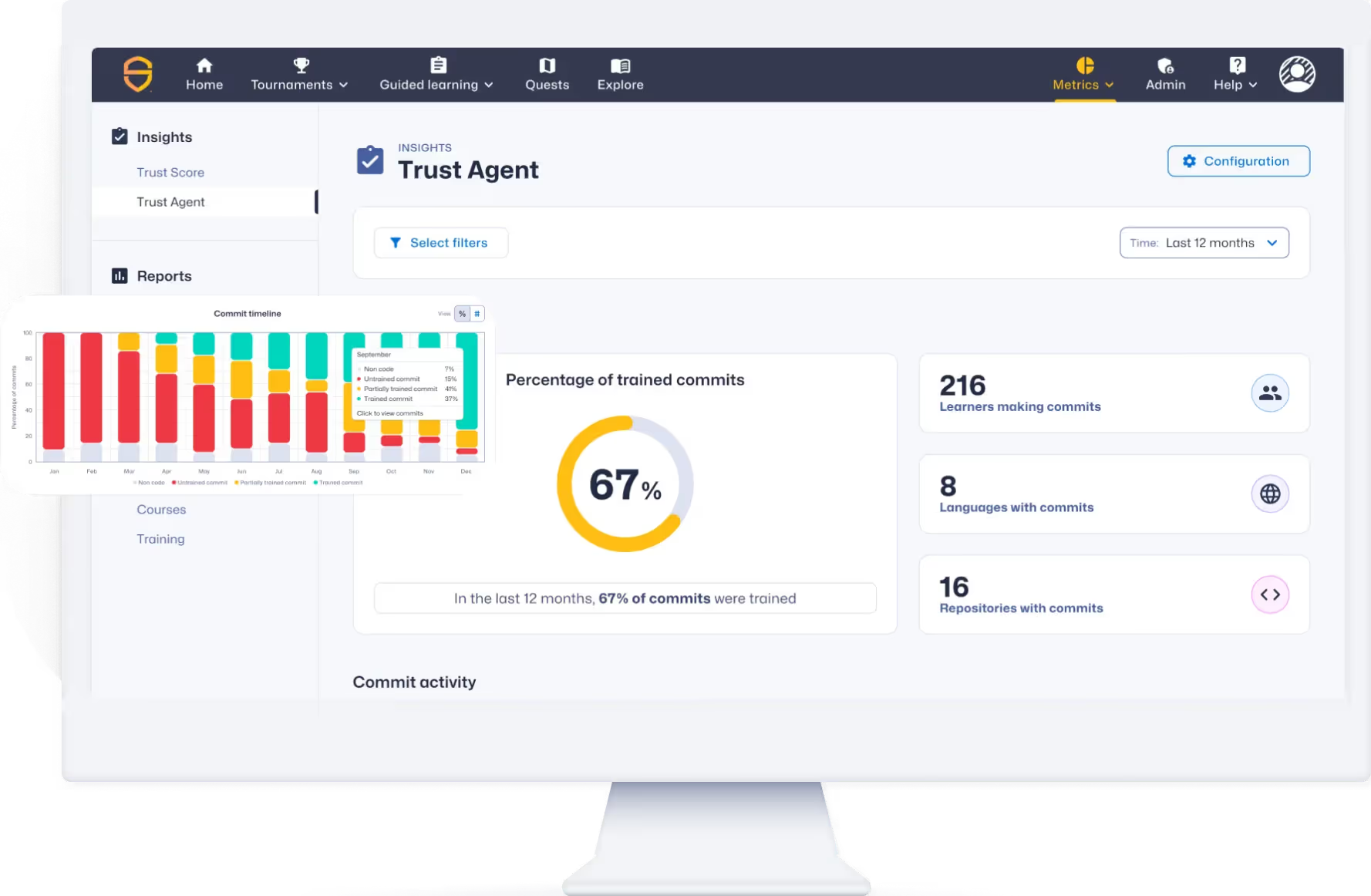

資格認定イニシアチブは、AI支援プログラミングによって生じる追加リスクに対処するための第一歩に過ぎません。SCW Treuhandagent™は、コードベースを扱う開発者に関する可視性と、そのセキュリティスキルに関する洞察を提供します。その後、コードリポジトリ向けのポリシーを設定し、積極的なガバナンスを通じてセキュリティ態勢を強化できます。

SCW Trust Agentを発見してください規制遵守を超えた測定可能な効果

コードのセキュリティ確保において、規制遵守を超えた積極的なアプローチを採用する企業は、具体的なビジネス成果を上げています。なぜなら、セキュリティ上の脆弱性を修正する最も費用対効果の高い方法は、最初からそれらを防止することだからです。SCW-Vertrauenswert™は、開発者のセキュリティスキル向上の進捗を時間軸で測定・比較する手段を企業に提供します。これは特に、AI駆動型プログラミング環境の早期導入において重要です。

SCWトラストスコアを探求する

無料のセキュリティルールを用いた安全なAIコード生成ガイド

AIコーディングツールは高速ですが、常に安全とは限りません。Secure Code Warrior セキュリティルールは、CopilotやCursorなどのツールがデフォルトでより安全なコードを生成できるようにする、シンプルで軽量なガイドラインSecure Code Warrior 。SCWアカウントなしで簡単に導入・拡張・設定に組み込めます。

AIセキュリティルールを探求する生産性の向上、しかしリスクの増加

AIコーディングツールの広範な導入は新たな課題をもたらしている:AI生成コードに対する透明性と制御の欠如である。

78%

- スタックオーバーフロー

30%

- arXiv

50%

- BAX-銀行

Trust Agentの利点:AI

SCW Trust Agentの新たなAI機能は、安全なソフトウェア開発ライフサイクル(SDLC)におけるAI導入を確実に管理するために必要な包括的な監視性と制御を提供し、セキュリティを犠牲にすることなく実現します。

SDLCにおけるAIの課題

AIの利用を管理する手段がなければ、CISO、アプリケーションセキュリティ担当者、技術リーダーは、対応できない新たなリスクや疑問に直面することになる。 懸念事項には以下が含まれる:- どの開発者がどの未承認モデルを使用しているか把握できないこと- AIを利用する開発者のセキュリティ能力に関する不確実性- 貢献されたコードのうち何パーセントがAIによって生成されたかに関する知見の欠如- AIツールのリスクを管理するためのポリシーやガイドラインを施行できないこと

- どの開発者がどの未承認モデルを使用しているかについての透明性の欠如。

- 開発者がAIを利用する際に生じるセキュリティ能力に関する不安。

- 投稿コードの何パーセントがAI生成であるかについての知見はない

- AIツールのリスクを管理するためのガイドラインや方針を徹底できないこと。

ユニークな信号の組み合わせ

SCWは、企業がセキュリティを犠牲にすることなくAI駆動開発のスピードを活用することを可能にします。AI Signalsは、3つの主要シグナルを独自に組み合わせ相関分析することで、コミットレベルにおけるAI駆動開発リスクを可視化し制御する初のソリューションです。

- AIコーディングツールの使用状況:誰がどのAIツールを使用しているか、どのLLMモデルがどのコードベースで利用されているかの洞察。

- リアルタイムで捕捉:Trust Agent:AIが開発者のコンピューターとIDE上で生成したコードをAIが捕捉する。

- 開発者のセキュアコーディング能力:開発者のセキュアプログラミングスキルに対する明確な理解を提供します。これはAIを責任を持って扱うために必要な基礎的な能力です。

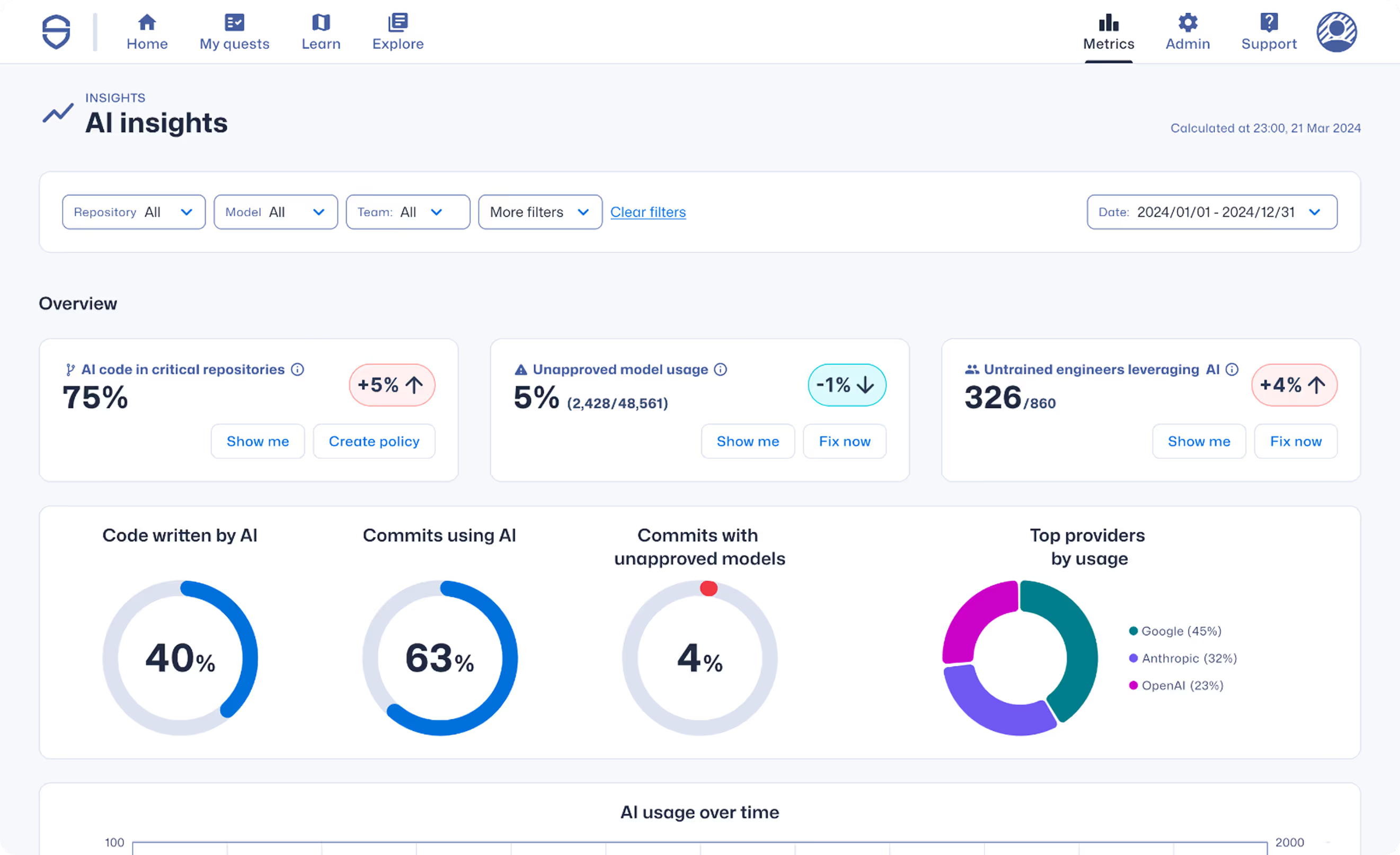

AI利用の可視性

AIプログラミングアシスタントとエージェント、そしてそれらを駆動するLLM(大規模言語モデル)について包括的な概要を把握しましょう。非承認ツールやモデルを発見してください。「シャドウAI」はもう終わりです。

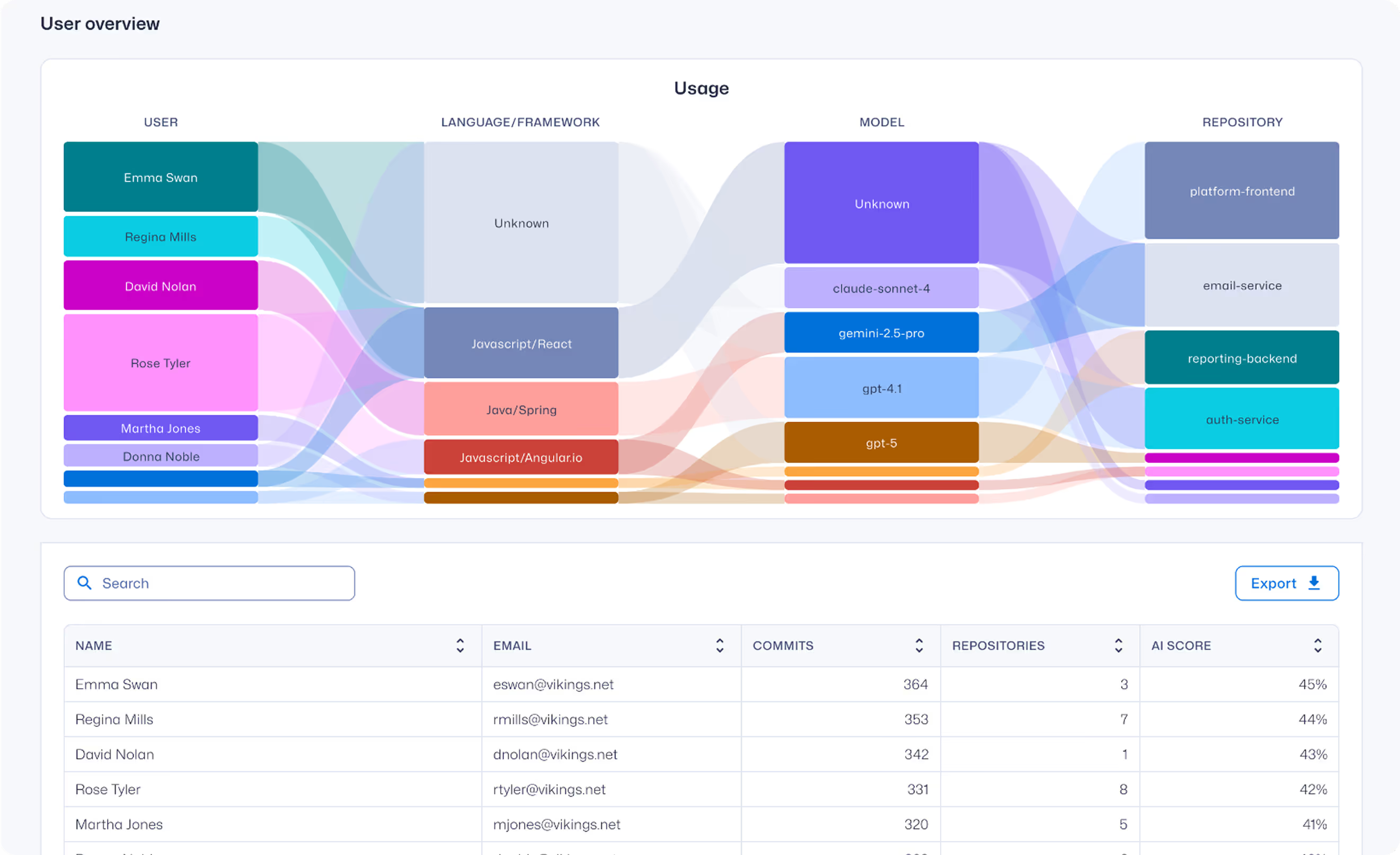

開発者およびコードベースによるAI支援コミットの可視性

AIを活用したソフトウェア開発に関する包括的な知見を得て、どの開発者がどのLLMモデルをどのコードベースで使用しているかを学びましょう。

統合制御と監視

AI生成コードを実際のコミットと関連付け、生じる真のセキュリティリスクを理解します。ポリシーの適用を自動化し、AIを活用した開発者が安全なコーディング基準を遵守していることを確認してから、その貢献を受け入れるようにします。

AIインサイトを発見する

Trust Agent: KIは、LLMベースのコード生成ツールを使用する開発者がもたらすリスクを企業が把握できるようにします。このソリューションは3つのステップでこれを実現します:

- AI生成コードのトラフィックを調査する:Trust Agent:AIはシンプルなIDEプラグインまたはエンドポイントエージェントとして提供され、GitHub Copilot、ChatGPT、Google Gemini、CursorなどのAIコーディングツールが生成するコードを捕捉・監視します。

- 開発者のスキルで強化する:最終段階では 、業界をリードするSCWのSecure Code Learning製品で測定された、関与する開発者の安全なコーディング知識を用いて、これらのデータを強化します。

これらの主要なシグナルを相関分析することで、Trust Agent: AIはセキュリティおよび技術チームに実用的な情報を提供します。これには、承認されていないLLMモデルの使用や、安全なコーディングに関する知識が限られている開発者の特定が含まれ、AI生成コードを公開する開発者を特定します。

手直し作業を回避し、リリース速度を向上させましょう

67%の開発者は、セキュリティ上の脆弱性を含むコードを意図的に送信していることを認めている。しかし彼らはコードの書き直しを嫌う。それは作業フローを中断させ、開発者の生産性を深刻に損なう。ソフトウェア開発プロセス初期段階から安全なコードを書く能力を開発者に提供しよう。これにより修正作業が減り、生産性が向上し、機能の迅速な提供が可能になる。

開発者を最新の状態に保ち、コードの安全性を優先してください。

安全なコードのための魅力的な学習環境を構築しましょう

生産性が急上昇すると、これらも同様に上昇する:

Entwickler einbeziehen

Fähigkeiten verbessern

Verbessern Sie die Zufriedenheit

Sparen Sie Geld

Secure Code Warrior 、お好みのワークフローに統合Secure Code Warrior

統合

チームが高品質で安全なソフトウェアを提供しつつ、リリース速度を損なわないことを保証します。Warrior Connectの統合により、開発者は安全にプログラミングできます。学習は、彼らが愛用し日常的に使用するツールに組み込むことが可能です。

さらに詳しく