AIソフトウェアのリスクが発生する前に阻止する

誰が(または何が)書いたものであれ、毎回コミット時には安全で高品質なコードを納品すること。

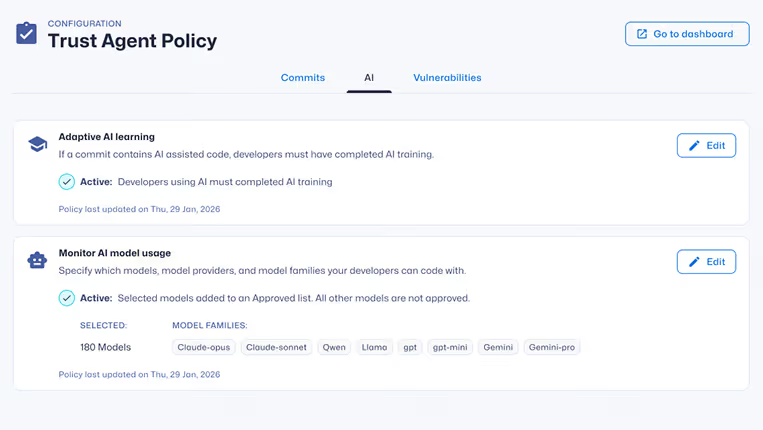

AIソフトウェアガバナンス

人工知能駆動開発の制御プレーン

人工知能駆動の開発を可視化、安全かつ弾力的にし、本番環境導入前に脆弱性を防止することで、チームは自信を持って迅速に行動できます。

大規模企業ガバナンス、自信を持ってAIを開発する。

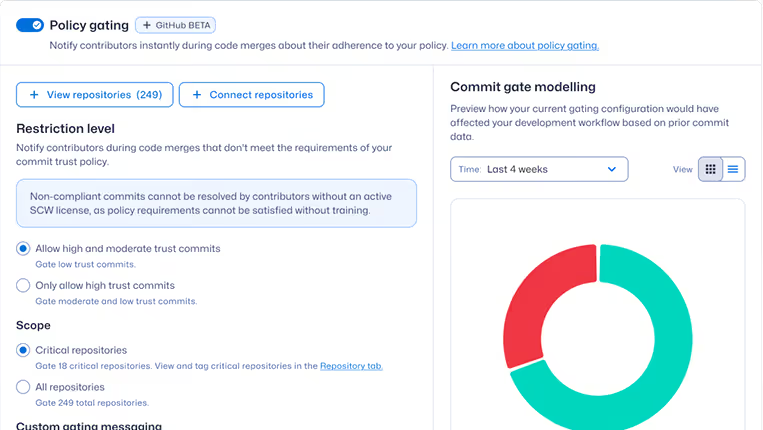

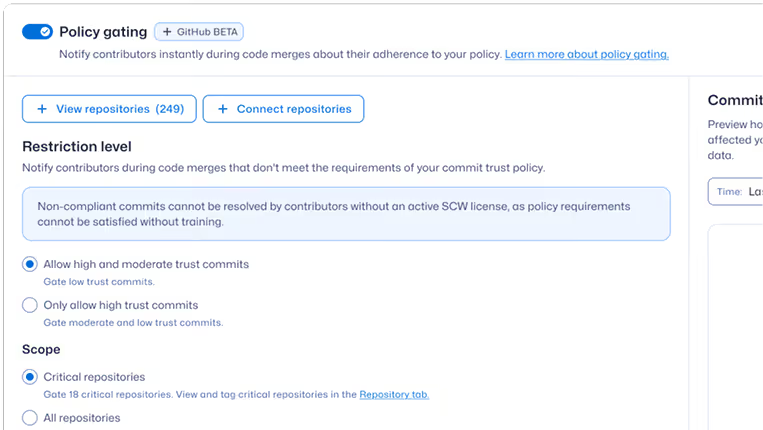

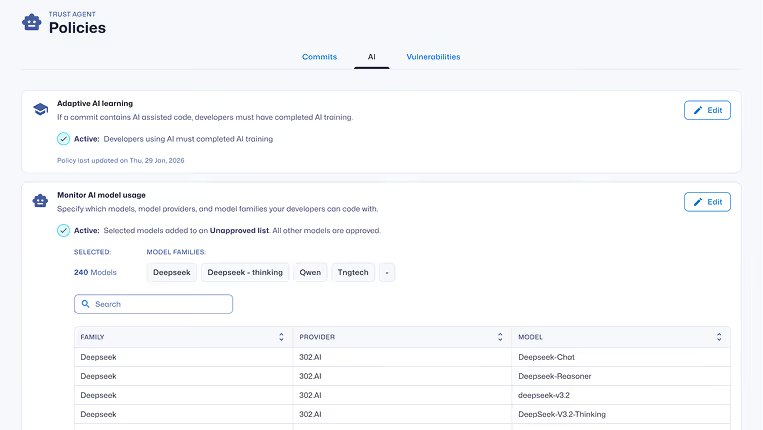

ポリシーを策定し、企業全体での可視性を確保し、開発ライフサイクル全体を通じてAIが生み出す制御不能なリスクを防止する。

AIが作成したコードの量を把握する

- AIワークフローにおけるセキュア開発戦略の定義と実行

- エンジニアリングチーム全体でセキュアコーディング能力を強化する

- クロス言語および脆弱性に関する実践トレーニングへの参加

AIが導入する脆弱性を提出時に防止する

導入される脆弱性を53%以上削減する

- 開発者とAI駆動のワークフローにおける安全なコーディング能力の構築

- ポリシーに沿ったガイダンスを開発者ツール内で直接提供

- AI生成コードがソフトウェアリスクに与える影響を確認する

速度を落とさずにAI開発を拡大する

最大82%のMTTR削減が可能

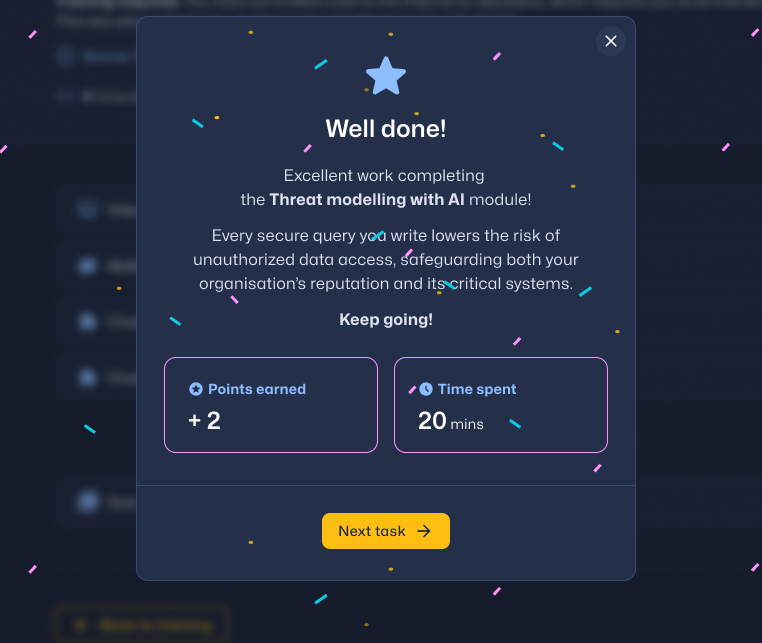

- 適応学習と実践的な実験を通じて、測定可能なスキル向上を促進する

- 開発者ツール内でリアルタイムガイダンスを提供

- 脆弱性を早期に修正し、手戻りのコストを削減する

なぜ私たちは素晴らしいのか

安全で、あなたが既に使用しているツールのために構築されています

*近日公開

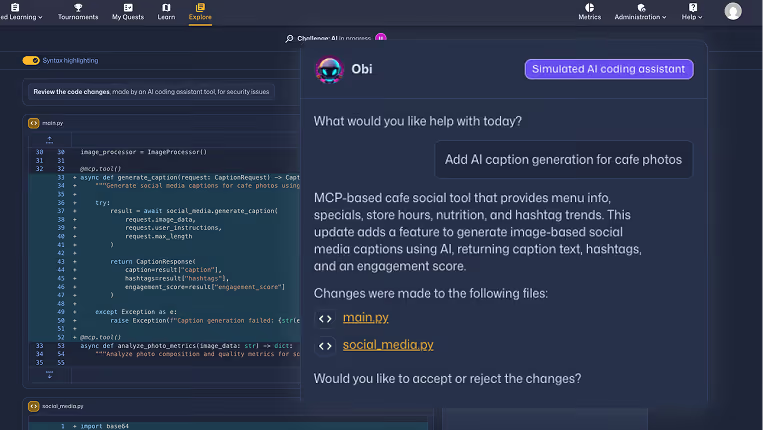

概念的かつインタラクティブな学習活動

11k+

脆弱性テーマとセキュリティ概念

650+

15種類のプログラミング言語におけるAIの課題

800+

コーディング言語とフレームワーク

75

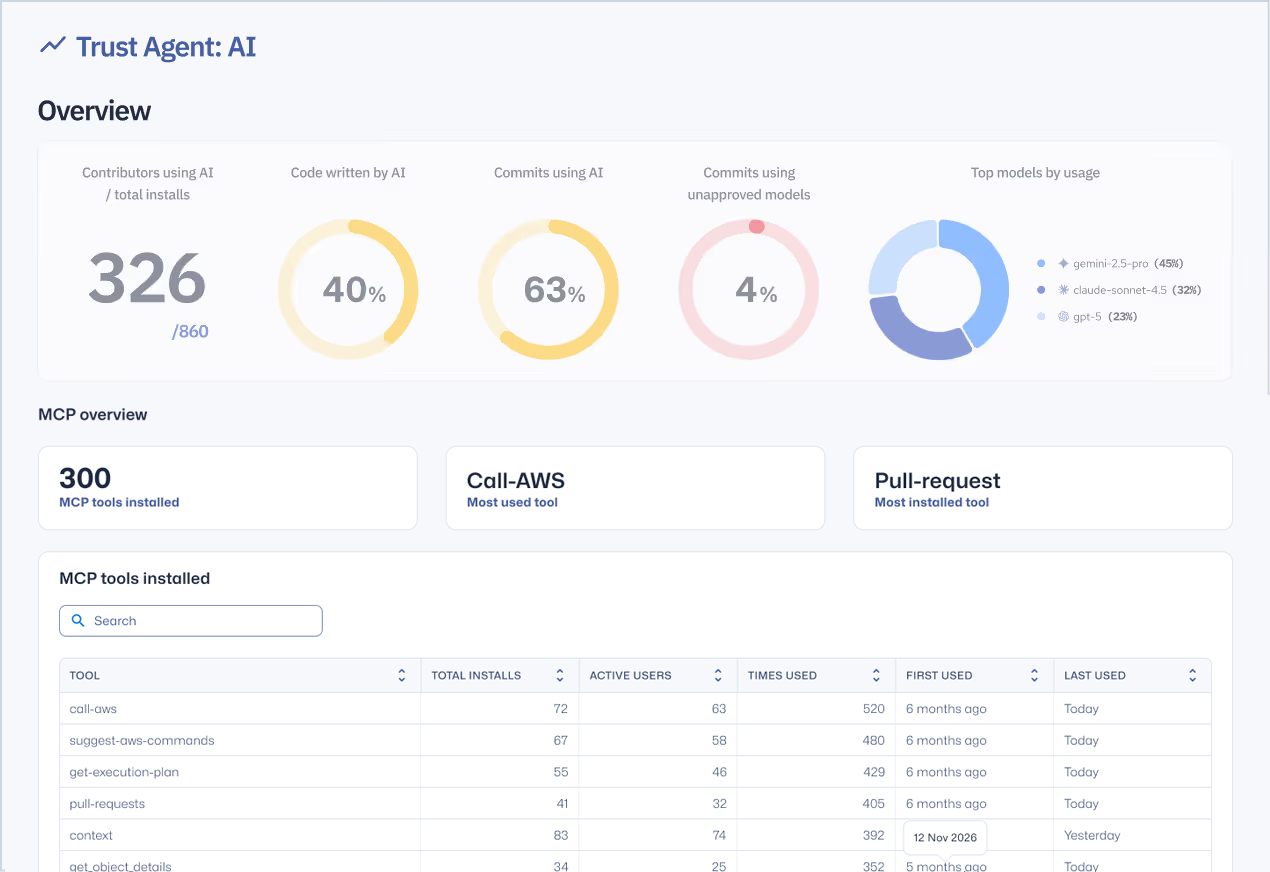

観測可能性

人工知能による開発リスクを可視化する

AIコーディングの使用方法、それが生み出すリスク、およびその背後にある動作を確認することで、脆弱性が公開される前にそれを阻止できます。

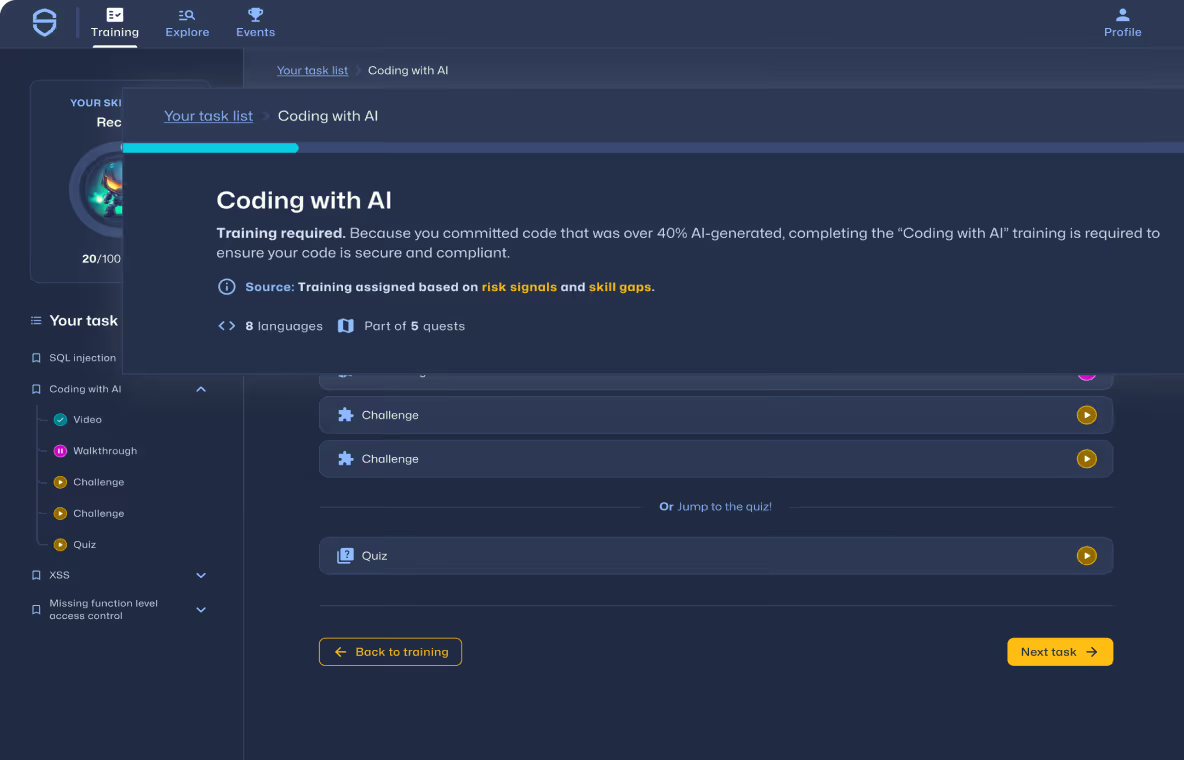

学習

根本的な原因から脆弱性を減らす

現実世界の開発者ワークフローに組み込まれたセキュアコーディングとAIセキュリティ学習——組織の脆弱性を53%以上削減。

ガバナンス

大規模な開発者および AI ポリシー管理の実施

AI駆動のソフトウェア開発ライフサイクルを有効化し制御すると同時に、コードが本番環境に投入される前にリスクを予防し、ポリシーを実行し、信頼性を証明します。

リリース前にAI駆動開発の安全性を確保する

開発者リスクを確認し、ポリシーを実施し、ソフトウェア開発ライフサイクルにおける脆弱性を防止します。

リソースセンター

入門に役立つリソース

AIソフトウェアガバナンスに関するよくある質問

AIソフトウェアガバナンスの理解と、AI駆動型ソフトウェアリスクの低減方法

人工知能ソフトウェアガバナンスとは何か、その重要性、Secure Code Warrior 人工知能支援開発Secure Code Warrior 理解する。

.svg)

%20(1).avif)

.avif)