AIソフトウェアに関連するリスクが発生する前に阻止する

誰が(あるいは何が)書いたものであれ、検証のたびに安全で高品質なコードを送信してください。

AIソフトウェアのガバナンス

AI主導の開発のための管理計画

AI主導の開発を可視化、安全かつ回復力のあるものにし、本番環境前に脆弱性を予防することで、チームが自信を持って迅速に行動できるようにします。

大規模な企業ガバナンス、信頼性のあるAI開発。

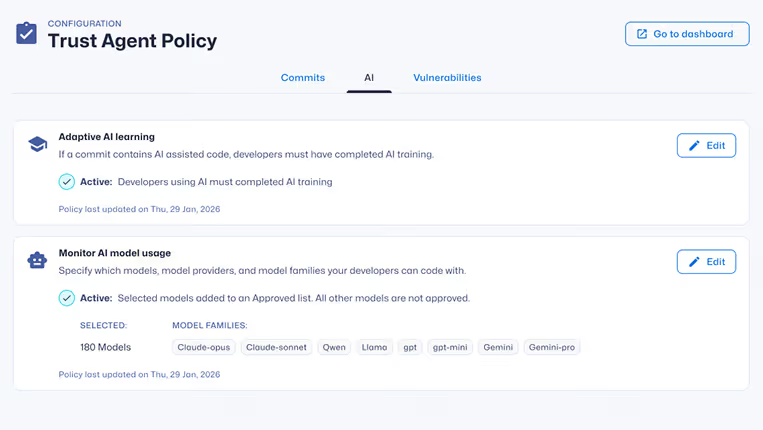

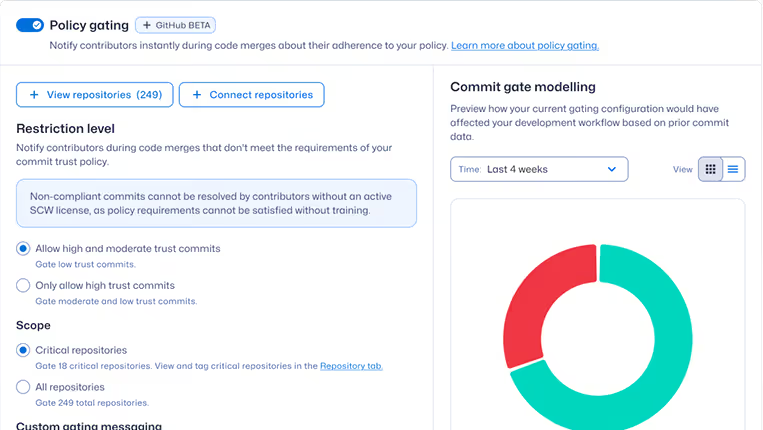

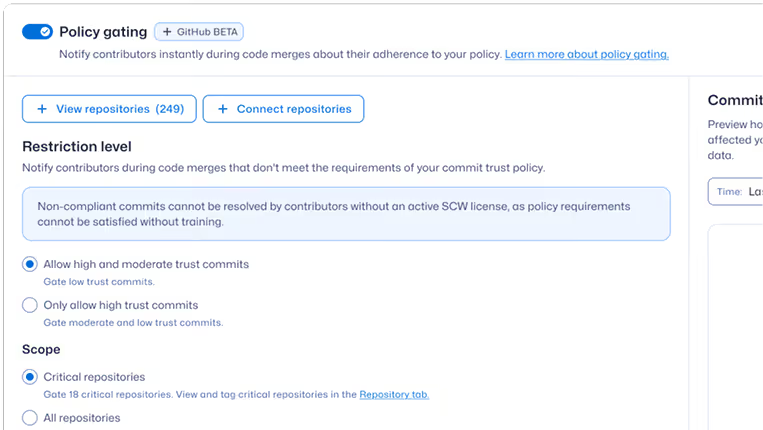

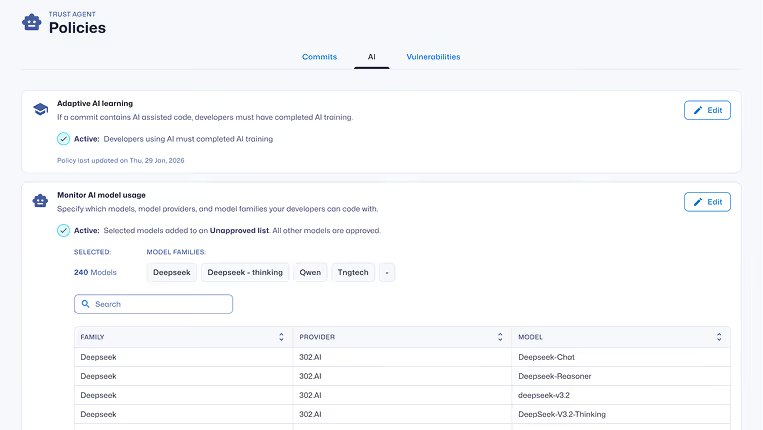

ポリシーを確立し、企業全体の可視性を確保し、開発サイクル全体を通じてAIによって引き起こされる制御不能なリスクを防止します。

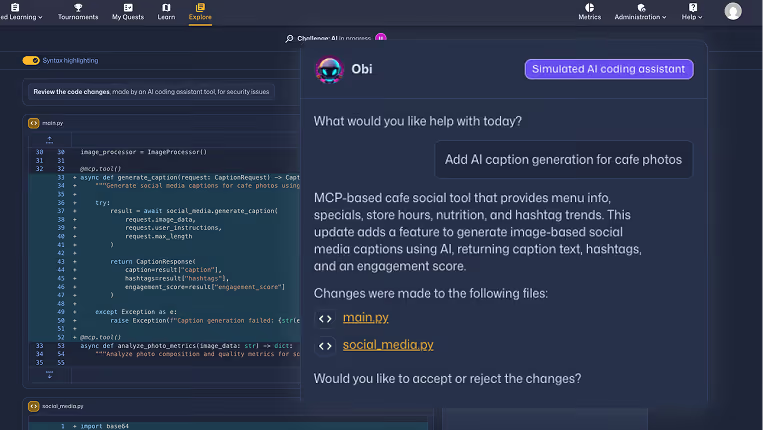

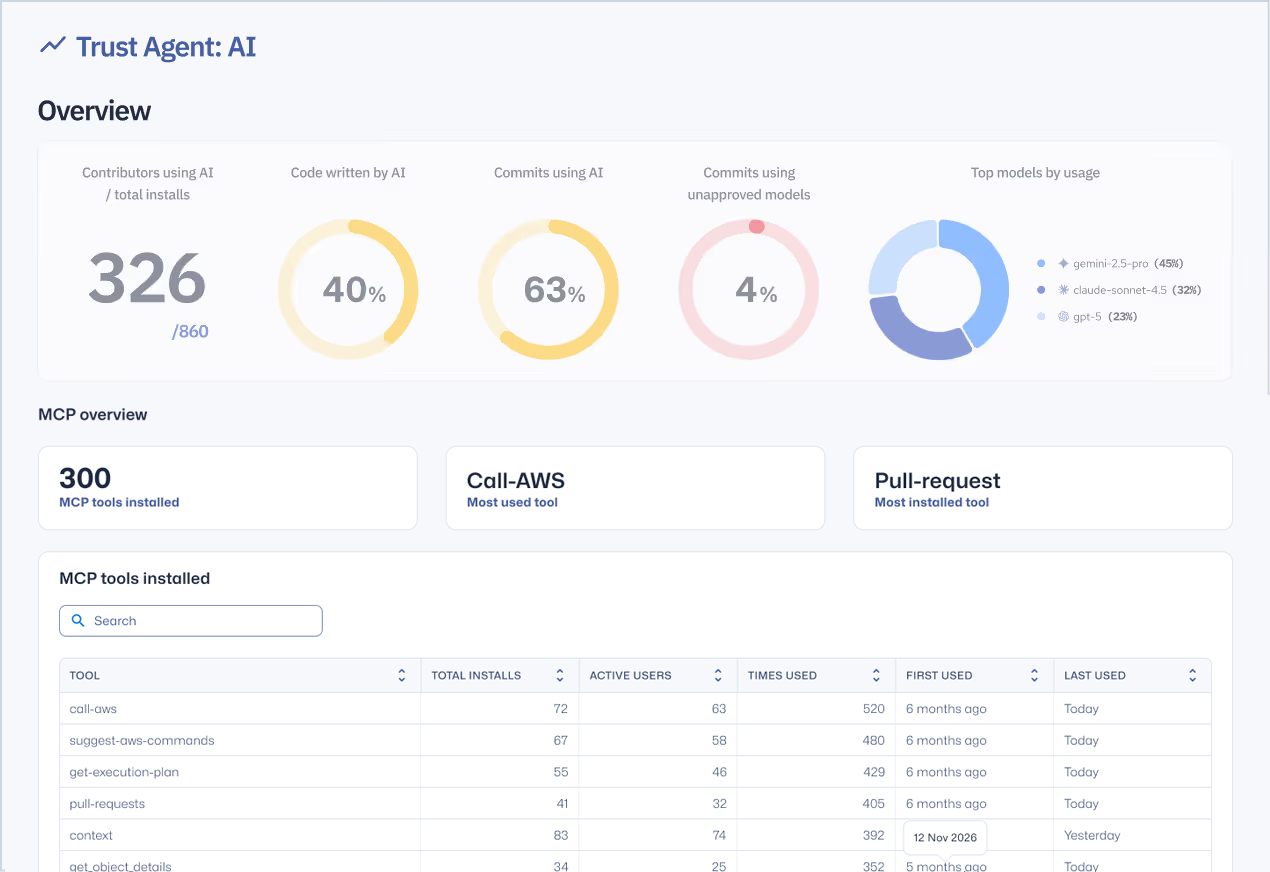

AIが生成したコードの量を可視化する

- AIワークフローにおける安全な開発ポリシーを定義し適用する

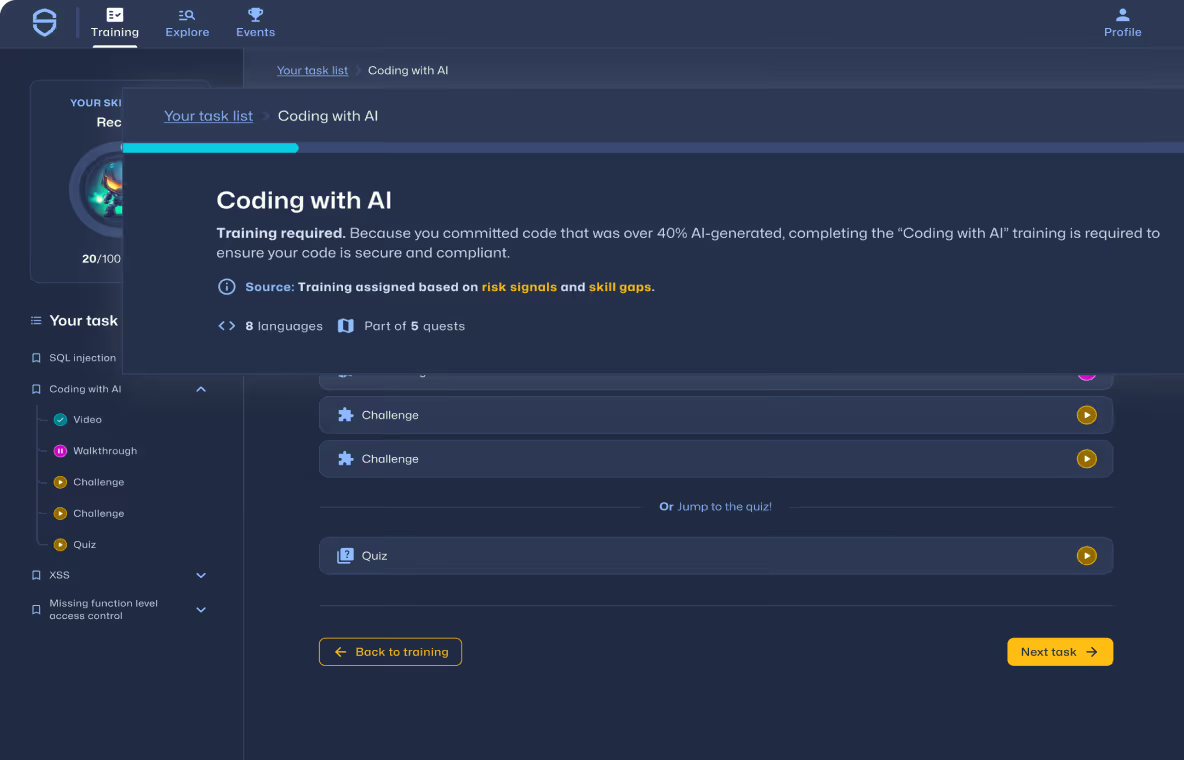

- エンジニアリングチーム全体でセキュアコーディング能力を強化する

- あらゆる言語と脆弱性に関する実践的なトレーニングにアクセス

AI導入時に生じる脆弱性を検証段階で防止する

導入された脆弱性を53%以上削減する

- 開発者向けセキュアなコーディング能力とAI主導のワークフローを開発する

- ポリシーに沿ったガイダンスを開発者ツール内で直接提供

- AI生成コードがソフトウェアリスクに与える影響を確認する

AI開発を拡大しつつ、速度を落とさない

MTTRを最大82%削減

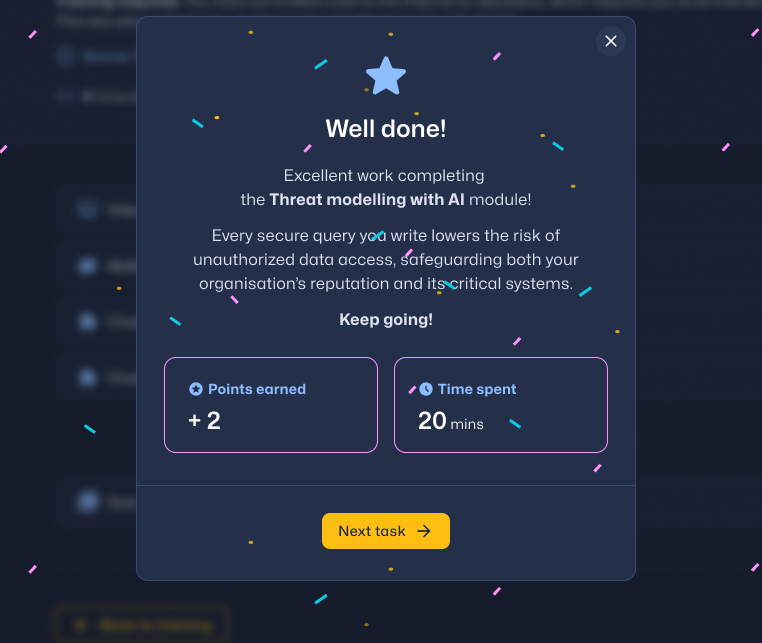

- 適応型学習と実践的なワークショップを通じて、測定可能なスキル向上を促進する

- 開発者ツール内でリアルタイムガイダンスを提供

- 脆弱性を早期に修正し、手戻りのコストを削減する

なぜ私たちは素晴らしいのか

安全で、既に使用しているツールに合わせて設計されています

*近日公開

概念的かつ双方向的な学習活動

11k+

脆弱性とセキュリティ概念に関するトピック

650+

15のコーディング言語におけるAIの課題

800+

プログラミング言語とフレームワーク

75

可観測性

人工知能(AI)開発に伴うリスクの可視化

AIのコーディングがどのように利用されているか、それが生み出すリスク、そしてその背後にある行動様式を理解し、脆弱性が検出される前に阻止できるようにしましょう。

学習

脆弱性を根源から削減する

現実の開発者のワークフローで実践的に学ぶセキュアコーディングとAIセキュリティ。企業の脆弱性を53%以上削減します。

ガバナンス

開発者およびAIポリシーの管理を大規模に適用する

AI主導のソフトウェア開発ライフサイクルを活性化し管理しながら、コードが本番環境に入る前にリスクを予防し、ポリシーを適用し、信頼性を実証します。

AI主導のセキュア開発(納品前)

開発者向けのリスクを特定し、ポリシーを適用し、ソフトウェア開発ライフサイクル全体を通じて脆弱性を回避します。

リソースセンター

はじめの一歩を踏み出すためのリソース

AIソフトウェアガバナンスに関するよくある質問

AIソフトウェアのガバナンスを理解し、AI関連ソフトウェアのリスクを軽減する方法

AIソフトウェアガバナンスとは何か、その重要性、Secure Code Warrior 組織が安全にAI支援開発を導入するのをどのようにSecure Code Warrior をご覧ください。

.svg)

%20(1).avif)

.avif)